LSTM之父:我也是注意力之父!1991年就发表线性复杂度,遥遥领先Transformer 26年

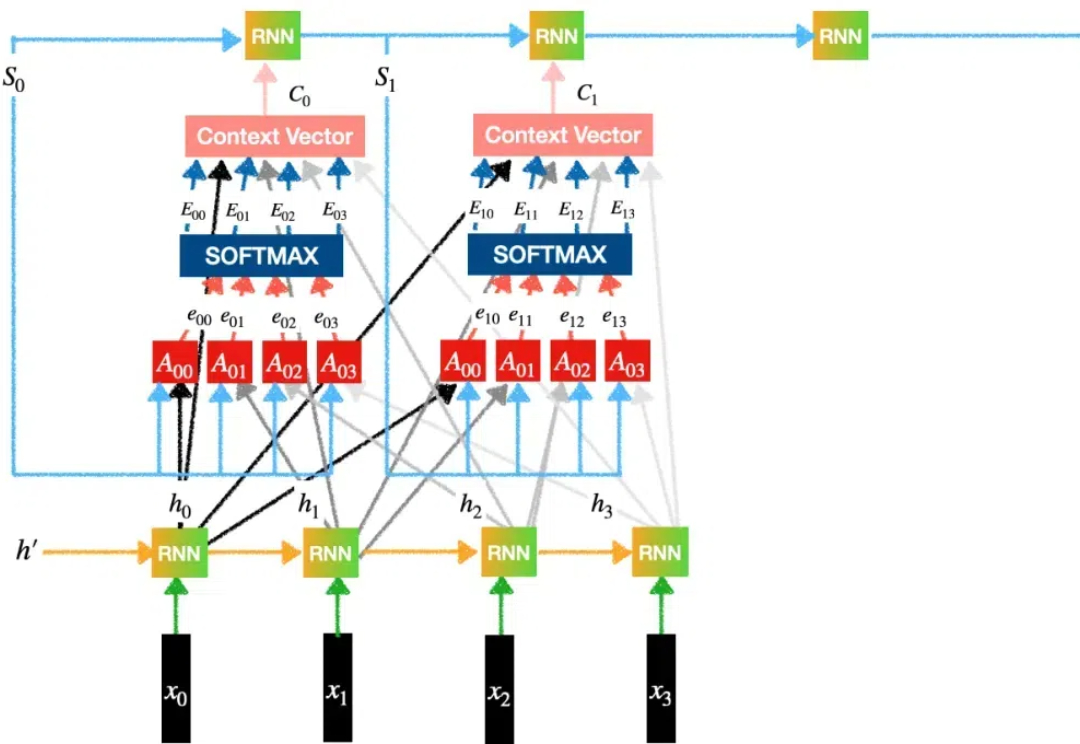

LSTM之父:我也是注意力之父!1991年就发表线性复杂度,遥遥领先Transformer 26年Transformer模型自2017年问世以来,已成为AI领域的核心技术,尤其在自然语言处理中占据主导地位。然而,关于其核心机制“注意力”的起源,学界存在争议,一些学者如Jürgen Schmidhuber主张自己更早提出了相关概念。

Transformer模型自2017年问世以来,已成为AI领域的核心技术,尤其在自然语言处理中占据主导地位。然而,关于其核心机制“注意力”的起源,学界存在争议,一些学者如Jürgen Schmidhuber主张自己更早提出了相关概念。

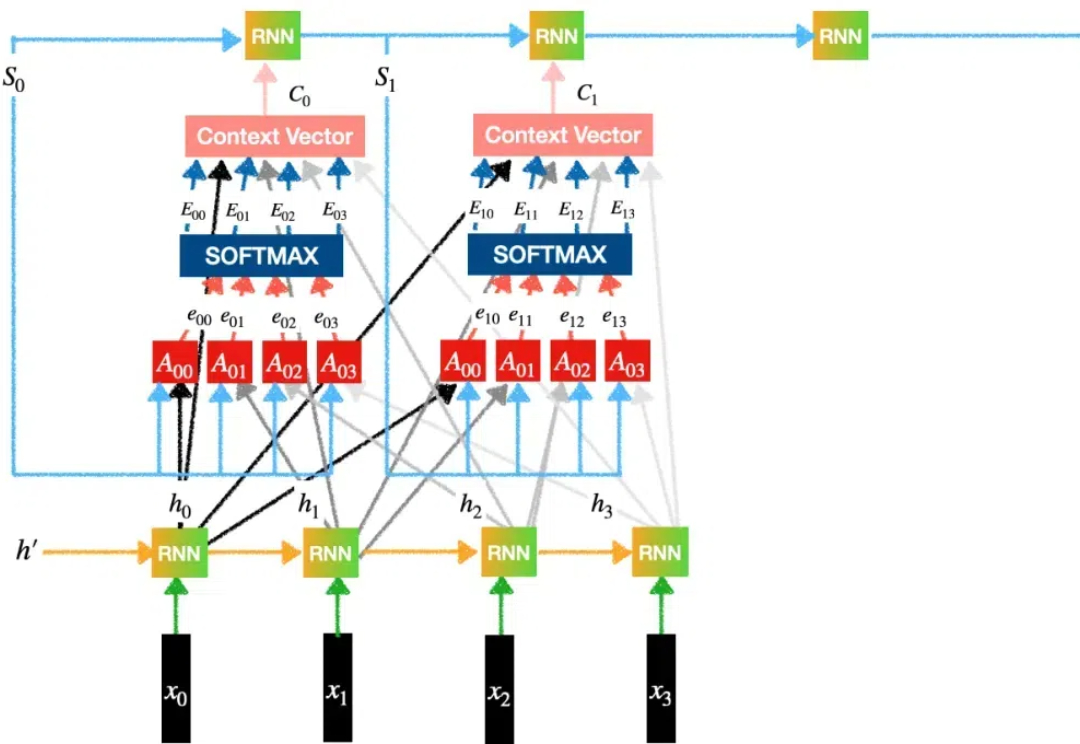

大模型“套壳”事件防不胜防,有没有方法可以检测套壳行为呢? 来自上海AI实验室、中科院、人大和上交大的学者们,提出了一种大模型的“指纹识别”方法——REEF(Representation Encoding Fingerprints)。

谷歌Gemini 2.0昨晚鲨疯了!仅过去不到24小时,一大波网友试玩已新鲜出炉~

Apple MM1Team 再发新作,这次是苹果视频生成大模型,关于模型架构、训练和数据的全面报告,87 亿参数、支持多模态条件、VBench 超 PIKA,KLING,GEN-3。

一家日本初创公司Orange正在使用Anthropic公司的旗舰大语言模型Claude帮助将漫画翻译成英文,使该公司能够在短短几天内为西方受众推出一部新作,而不是人工团队需要两到三个月的时间。

昨天深夜,OpenAI彻底被谷歌狙击,震撼亮相的Gemini 2.0掀起智能体革命,原生多模态的多项惊人demo预示着:智能体时代,谷歌已经走在了最前面。

薛复昭博士宣布即将加入Google DeepMind,分享了他在博士生涯中的七点心得,包括工程能力的重要性、与优秀人才合作、专注于重要论文、研究趋势的演变、换位思考以及博士学位的价值。

谷歌放大招推出 Gemini 2.0 Flash 模型,抢跑外加狙击OpenAI,正式开启Agent时代,诚意十足,全部免费使用

开发AI应用的朋友们都有深刻的感受,在实际应用开发中,如何让LLM高效地使用外部工具,一直是困扰Prompt工程师的一个关键问题。最近,来自Faculty Science Ltd的研究团队提出的Language Hooks框架,为这个问题提供了一个令人耳目一新的解决方案。

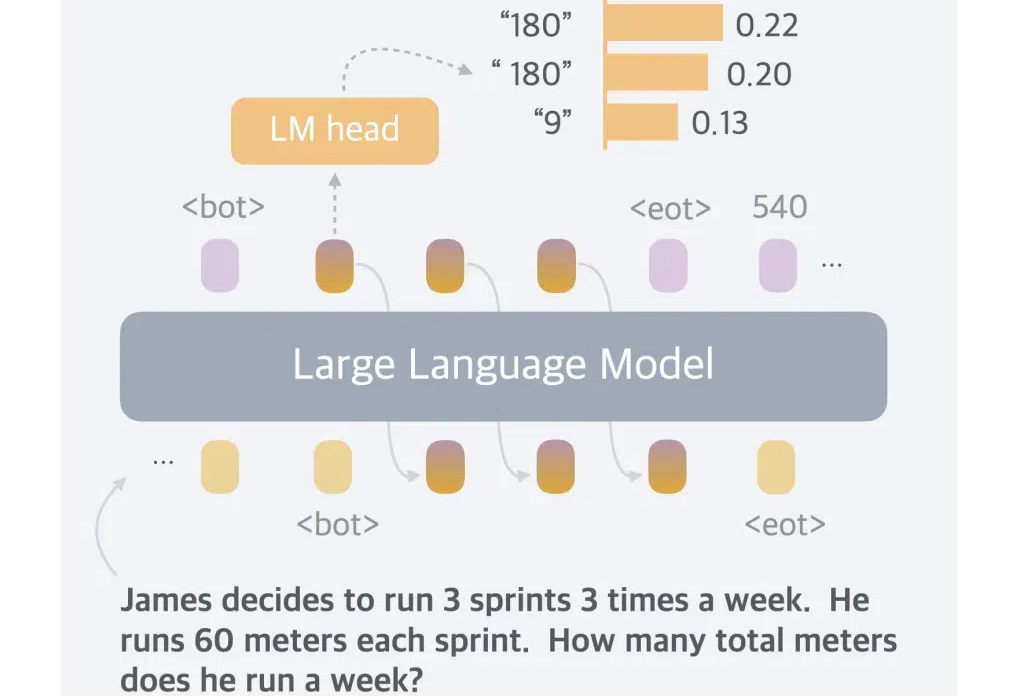

一般而言,LLM 被限制在语言空间(language space)内进行推理,并通过思维链(CoT)来表达推理过程,从而解决复杂的推理问题。