Seedance 2.0让字节元神启动

Seedance 2.0让字节元神启动Seedance 2.0用了两天,个人感想是,以下几类人群或即将失业:一、把「学好提示词」奉为圭臬,并开班传授佶屈聱牙反逻辑长难句prompt的AI导师。二、成本只有一个自拍杆的所谓短视频博主。三、刚开始做AI社交的小创业者。

Seedance 2.0用了两天,个人感想是,以下几类人群或即将失业:一、把「学好提示词」奉为圭臬,并开班传授佶屈聱牙反逻辑长难句prompt的AI导师。二、成本只有一个自拍杆的所谓短视频博主。三、刚开始做AI社交的小创业者。

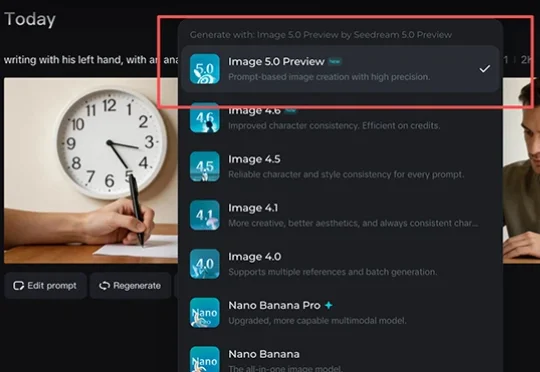

新模型对标Nano Banana Pro,能免费体验。Seedance 2.0的热度还没下去,字节新模型又来了!今日,字节图像生成模型Seedream 5.0 Preview在视频编辑应用剪映、剪映海外版Capcut、字节AI创作平台小云雀均已上线,在即梦AI平台开启灰度测试,图片生成可限时免费体验。

创新需要适当的灰度和混乱,但应对竞争需要秩序和纪律。 上千人的研究团队、投入上百亿元追赶两年,终于研发出能排在中国第一梯队的基础模型,迅速被只有上百人的团队用更少资源研发的模型超过,部门负责人承认失误,公司 CEO 在全员会上点名,本可以做得更好。

这两天,AI 视频圈被偷摸摸上线的 Seedance 2.0 刷屏了。在 AI 视频领域颇有影响力的博主海辛,在即刻分享了自己对它的观点:「Seedance 2.0 是我 26 年来最大的震撼」、「我觉得它碾压 Sora2」。

2月7日,字节跳动AI视频生成模型Seedance2.0开启灰度测试,该模型支持文本、图片、视频、音频素材输入,可以完成自分镜和自运镜,镜头移动后人物特征能够保持一致。

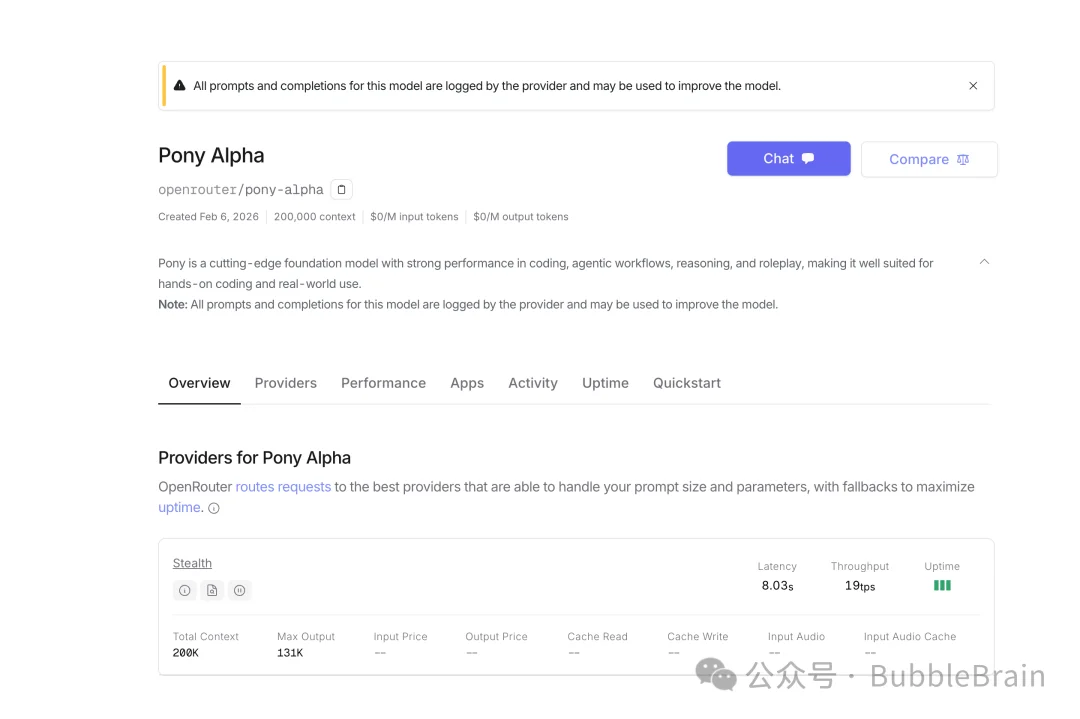

这周真的特别期待,应该可以看到各路厂商神仙打架。这股战火,从周末就开始了。 除了字节发布的Seedance2.0以外,还有个神秘的模型Pony Alpha 也上线到OpenRouter了,已经看到很多网友们纷纷猜测到底是谁家的模型。

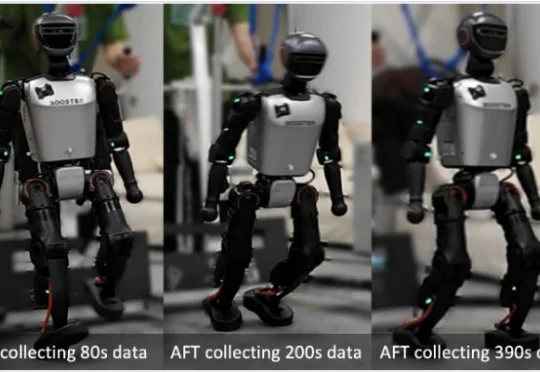

目前,人形机器人已经能在现实中跳舞、奔跑、甚至完成后空翻。但接下来更关键的问题是:这些系统能否在部署之后持续地进行强化学习 —— 在真实世界的反馈中变得更稳定、更可靠,并在分布不断变化的新环境里持续适应与改进?

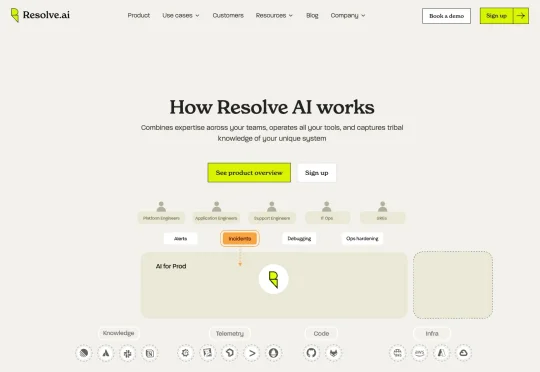

专注于系统可靠性工程(SRE)工作自动化的初创公司 Resolve AI,即自动化排查系统故障的 AI 公司,日前宣布完成 1.25 亿美元 A 轮融资, 估值达到 10 亿美元 。

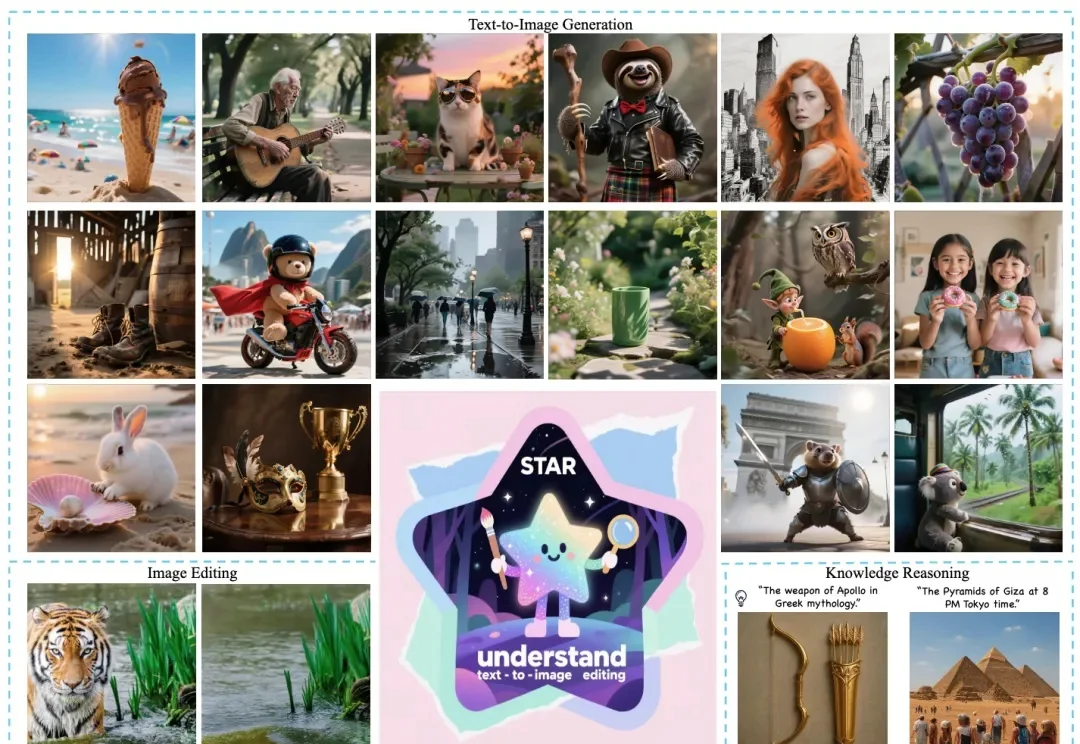

近日,美团推出全新多模态统一大模型方案 STAR(STacked AutoRegressive Scheme for Unified Multimodal Learning),凭借创新的 "堆叠自回归架构 + 任务递进训练" 双核心设计,实现了 "理解能力不打折、生成能力达顶尖" 的双重突破。

个人电脑也能跑出顶级编程智能体?今日凌晨,阿里开源了一款小型混合专家模型Qwen3-Coder-Next,专为编程智能体(Agent)和本地开发打造。该模型总参数80B,激活参数仅3B,在权威基准SWE-Bench Verified上实现了超70%的问题解决率,性能媲美激活参数规模大10-20倍的稠密模型。