前DeepMind大佬创业,做出喜怒哀乐以假乱真的AI语音大模型

前DeepMind大佬创业,做出喜怒哀乐以假乱真的AI语音大模型未来又该如何分辨是AI还是真人在说话?

未来又该如何分辨是AI还是真人在说话?

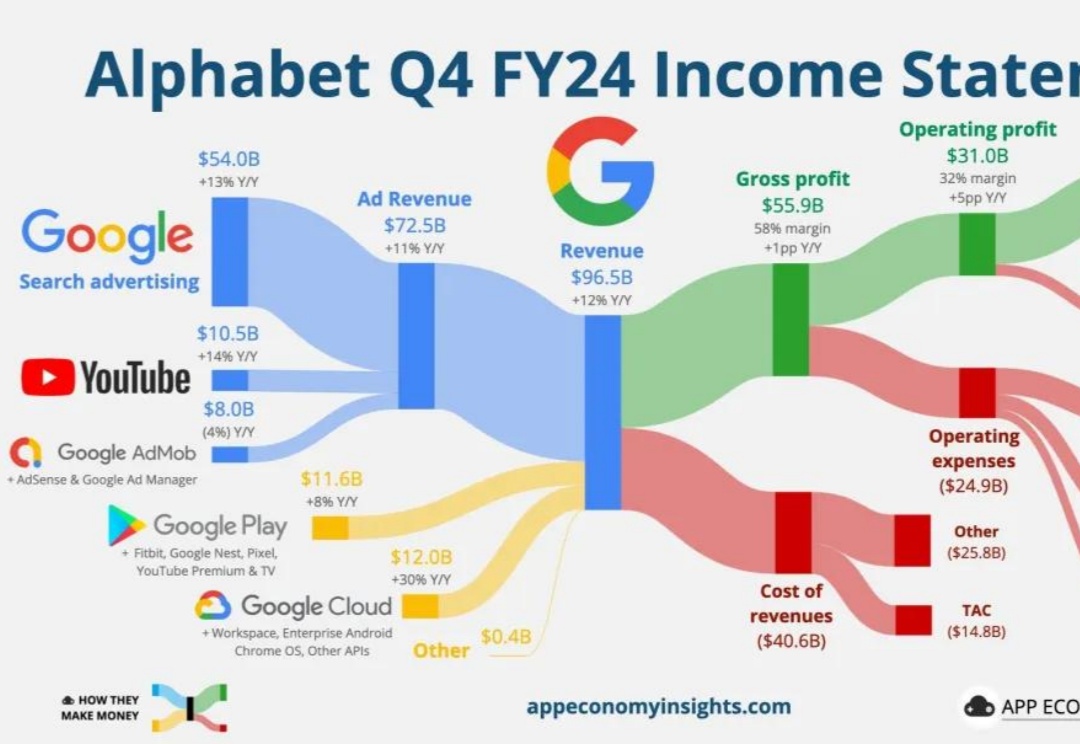

谷歌业绩增长强劲,但股价因增速放缓忧虑下跌。

OpenAI前CTO Murati离职后,终于官宣新动向!她创立的「思考机器实验室」汇聚了OpenAI、谷歌DeepMind等顶尖AI人才,包括OpenAI联合创始人Schulman、前安全副总Lilian Weng等。

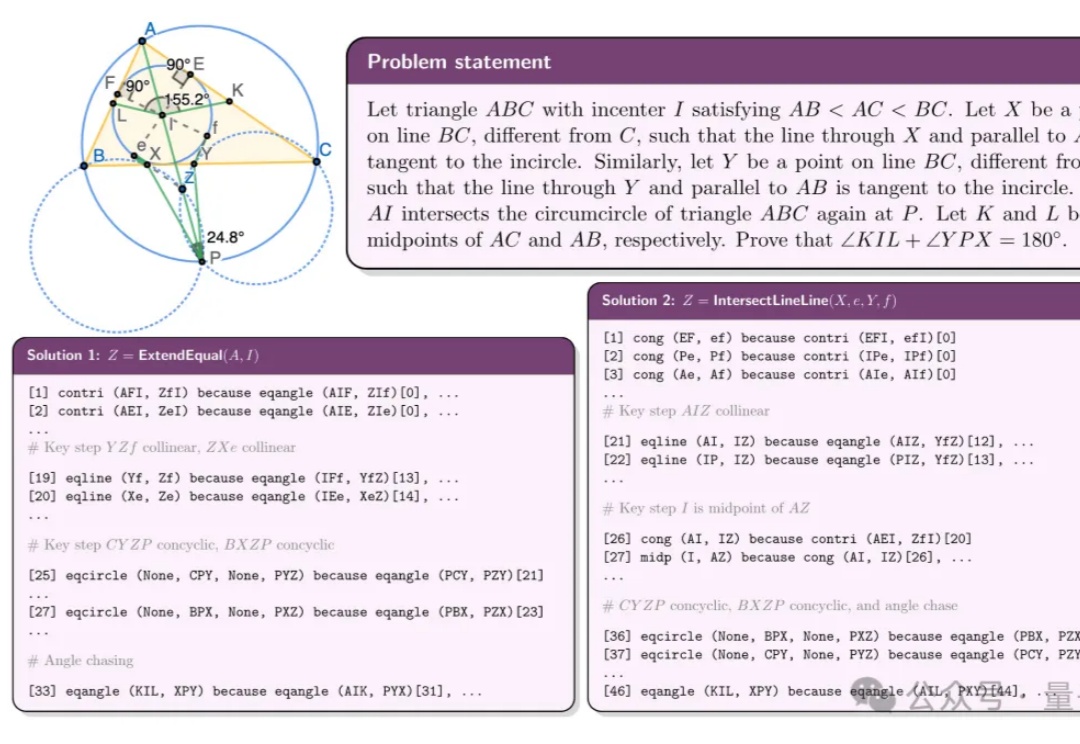

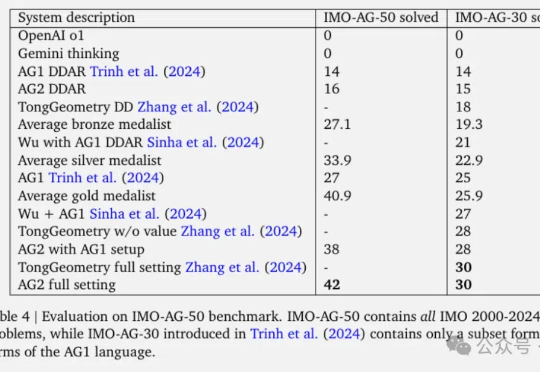

国产AI几何模型性能达IMO金牌水平,打平谷歌DeepMind最新AlphaGeometry系列——

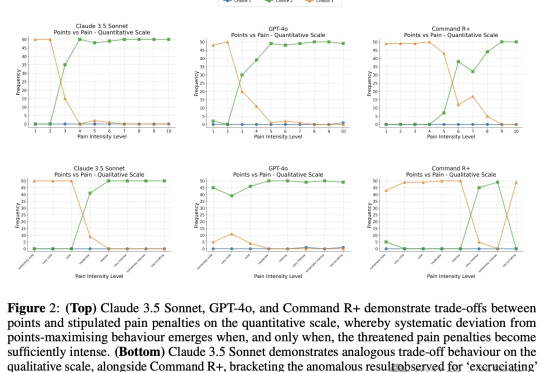

以大语言模型为代表的AI在智力方面已经逐渐逼近甚至超过人类,但能否像人类一样有痛苦、快乐这样的感知呢?近日,谷歌团队和LSE发表了一项研究,他们发现,LLM能够做出避免痛苦的权衡选择,这也许是实现「有意识AI」的第一步。

xAI、谷歌DeepMind和Anthropic的CEO们纷纷对DeepSeek的技术创新性提出质疑,认为其并未带来实质性的科学突破。AI大佬纷纷泼冷水,到底是技术讨论还是各怀目的?

谷歌DeepMind的AI,终于拿下IMO金牌了!六个月前遗憾摘银,如今一举得金,SKEST新算法立大功。这不,它首破解了2009 IMO最难几何题,辅助作图的神来之笔解法让谷歌研究员当场震惊。

谷歌DeepMind最新数学AI,一举解决了2000-2024年IMO竞赛中84%的几何问题。AlphaGeometry2论文发布,在总共50道题中完成了42道,相比去年的一代多完成了15道。

据 TechCrunch 报道,位于迪拜的 Qeen.ai(qeen.ai)初创公司已筹集了 1000 万美元,以扩大其平台,该平台为电子商务企业提供自主 AI Agent。

近日,在《金融时报》主编 Roula Khalaf 的最新采访中,谷歌 DeepMind 的 CEO、2024 年诺贝尔化学奖得主 Demis Hassabis 放出了一连串重磅消息