Figma老股估值910亿,一批员工财务自由

Figma老股估值910亿,一批员工财务自由据彭博社报道,包括Coatue,Alkeon Capital Management和General Catalyst Partners在内的投资者已经投资了Figma,估值被认定为125亿美元(折合人民币910亿元),该交易被广泛认为是为IPO做准备。

据彭博社报道,包括Coatue,Alkeon Capital Management和General Catalyst Partners在内的投资者已经投资了Figma,估值被认定为125亿美元(折合人民币910亿元),该交易被广泛认为是为IPO做准备。

84岁的美国老人Dorothy Elicati在失去结婚65年的丈夫后,每天醒来唯一做的事就是哭泣,直到一个AI机器人的出现。现在,美国会每年花费70万美元,为某些州的老年人免费发放这款机器人。

近日,清华大学与密歇根大学联合提出的自动驾驶汽车安全性「稀疏度灾难」问题,发表在了顶刊《Nature Communications》上。研究指出,安全攸关事件的稀疏性导致深度学习模型训练难度大增,提出了密集学习、模型泛化改进和车路协同等技术路线以应对挑战。

腾讯科技讯 5月9日消息,据国外媒体报道,援引知情人士周四透露,法国人工智能初创公司Mistral AI将以60亿美元的估值,从包括General Catalyst和Lightspeed Venture Partners在内的投资者手中筹集约6亿美元资金。Mistral AI在本轮融资中的最新估值几乎是半年前估值的近三倍。

使用测序 (scATAC-seq) 技术对转座酶可及的染色质进行单细胞测定,可在单细胞分辨率下深入了解基因调控和表观遗传异质性,但由于数据的高维性和极度稀疏性,scATAC-seq 的细胞注释仍然具有挑战性。现有的细胞注释方法大多集中在细胞峰矩阵上,而没有充分利用底层的基因组序列。

大型语言模型(LLM)往往会追求更长的「上下文窗口」,但由于微调成本高、长文本稀缺以及新token位置引入的灾难值(catastrophic values)等问题,目前模型的上下文窗口大多不超过128k个token

Characater.ai 网站每日活跃用户超 350 万,很多用户在过去一年向其发送了超千万条消息,Characater.ai,似乎正在悄悄改变人类和 AI 的关系,不能再被简单定义为偏工具属性的对话机器人。

近日,CMU Catalyst 团队推出了一篇关于高效 LLM 推理的综述,覆盖了 300 余篇相关论文,从 MLSys 的研究视角介绍了算法创新和系统优化两个方面的相关进展。

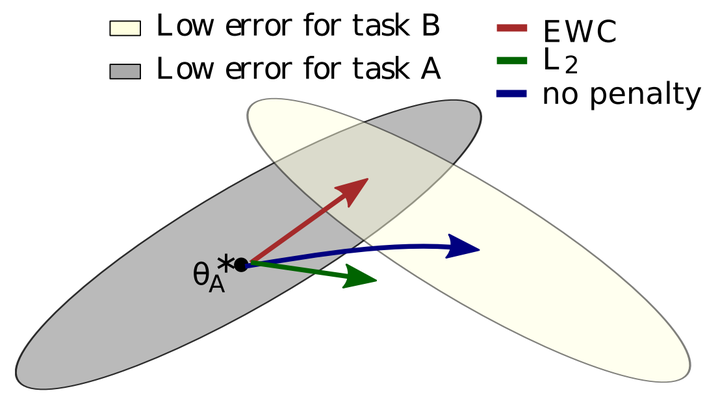

所谓灾难性遗忘,就是一个在原始任务上训练好的神经网络在训练完新任务后,在原始任务上的表现崩溃式的降低。

Meta谷歌接连放出重磅成果!Meta开源无缝交流语音翻译模型,谷歌放出无监督语音翻译重大突破Translation 3。