微软系连续创业者打造销售Agent,助力OpenAI等企业效率翻倍,估值13亿美元

微软系连续创业者打造销售Agent,助力OpenAI等企业效率翻倍,估值13亿美元Clay 集成了75+ 数据提供商(如 LinkedIn、Clearbit、Salesforce),并内置 AI Agent 进行客户研究、销售数据充实和个性化营销。通过无代码/低代码方式,用户可以拖拽式操作进行数据整合、自动化外联和个性化营销,提高业务增长效率。

Clay 集成了75+ 数据提供商(如 LinkedIn、Clearbit、Salesforce),并内置 AI Agent 进行客户研究、销售数据充实和个性化营销。通过无代码/低代码方式,用户可以拖拽式操作进行数据整合、自动化外联和个性化营销,提高业务增长效率。

我早上了,还有《Flappy Bird》啥事儿了。

增长玩的很溜,但产品内核呢?

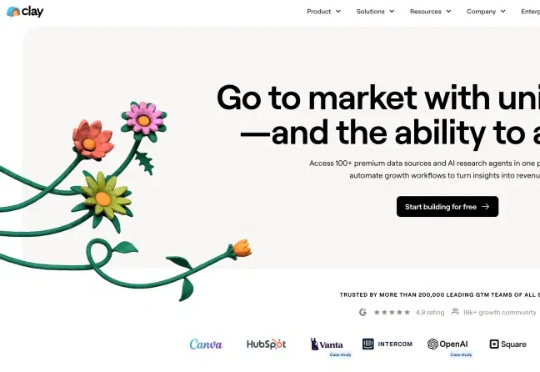

北京时间2月16日,马斯克宣布,将于太平洋时间周一晚上8点(北京时间2月18日12:00)发布Grok 3大模型,届时将进行现场演示。马斯克称Grok 3有非常强大的推理能力,在测试中的表现超越包括DeepSeek在内的所有已发布的AI大模型模型。5G与6G公众号(ID:angmobile)注意到马斯克表示Grok 3的某些能力之强“让人感到可怕”。

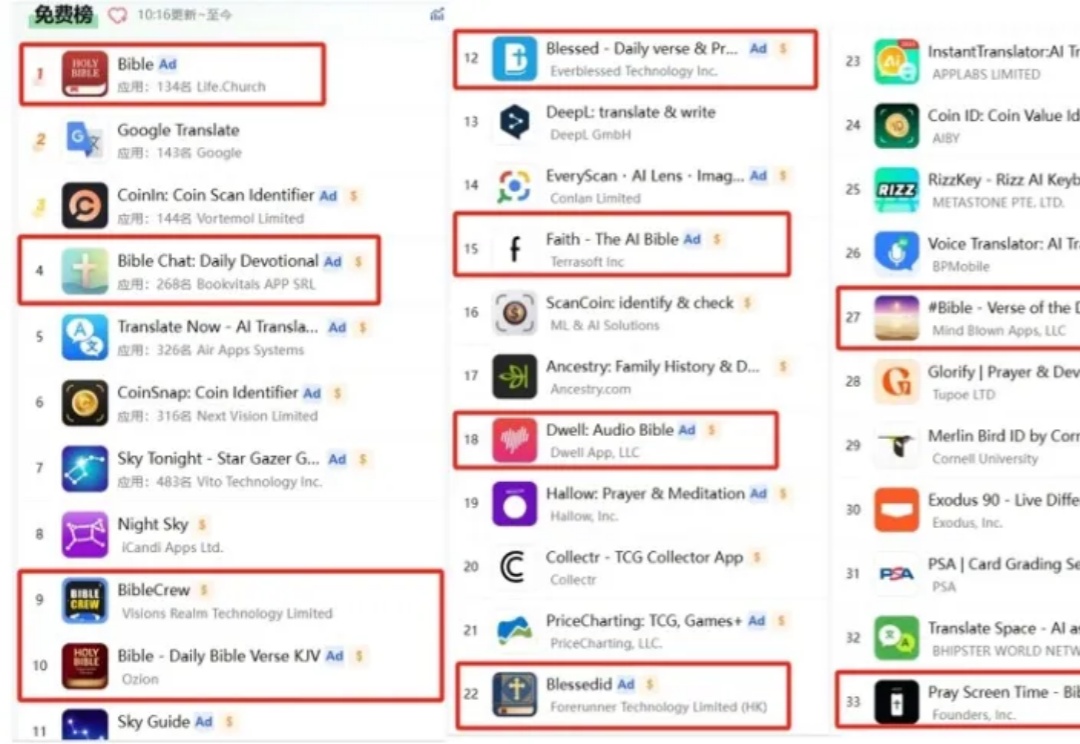

不知道是不是因为今年是禧年(天主教圣年,会有重大宗教活动)的缘故,不少宗教类 App 近期频频出现在笔者视野中,既有白鲸出海之前关注过的 Hallow,也有不少新面孔。

超级碗再次证明了自己是美国最优秀的职业体育赛事。 作为转播商的福克斯,公布了美国时间2月9日举行的超级碗转播相关记录。福克斯引用收视率调查企业尼尔森,和负责流媒体转播的Tubi,以及NFL官方网站的数据计算,此次超级碗平均有1.26亿人观看。

本期我们有幸邀请到了Pokee AI创始人朱哲清Bill,凭借Bill在Meta和斯坦福大学的丰富经验,尤其是在大规模部署强化学习模型服务数十亿用户方面的实践,他发现了强化学习的巨大潜力。Pokee AI致力于开发卓越的交互式、个性化、高效的AI Agent,结合团队深厚的强化学习专长,打造具备规划、推理和工具使用能力的解决方案,同时减少现有 AI 系统的幻觉问题。

大模型,三十年搜索战争的收官一战。2010 年,十年你追我赶,百度谷歌之战,以百度胜利暂时落下帷幕。那时,所有人都以为,全世界范围内的搜索之战,自此落幕,谷歌、百度两大巨头分别占领两大市场,360、 bing 等则依靠搜索产品的带动,分食长尾市场。

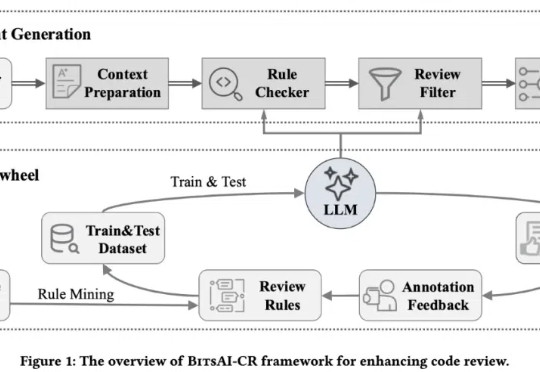

在人工智能浪潮席卷全球的今天,大语言模型 (LLM) 正在重塑软件开发流程。近日,字节跳动首次对外披露其内部广泛应用的代码审查系统 BitsAI-CR 的技术细节,展示了 AI 在提升企业研发效率方面的重要进展。

近日,在《金融时报》主编 Roula Khalaf 的最新采访中,谷歌 DeepMind 的 CEO、2024 年诺贝尔化学奖得主 Demis Hassabis 放出了一连串重磅消息