白宫宣布:封杀 Claude

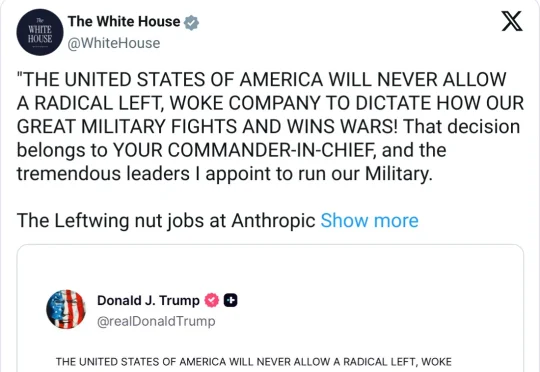

白宫宣布:封杀 Claude白宫官方账号于北京时间 2 月 28 日凌晨转发特朗普声明(发布于特朗普自己的媒体 Truth Social),宣布所有联邦机构立即停用 Anthropic 技术,给予六个月过渡期

白宫官方账号于北京时间 2 月 28 日凌晨转发特朗普声明(发布于特朗普自己的媒体 Truth Social),宣布所有联邦机构立即停用 Anthropic 技术,给予六个月过渡期

OpenClaw被谷歌封禁之后,Perplexity扔出深水炸弹,重磅上线Perplexity Computer,让全球19个顶尖AI集体打工,全程不用动手。与此同时,Anthropic官宣的一场重磅收购,让Claude执行力迎来质变。

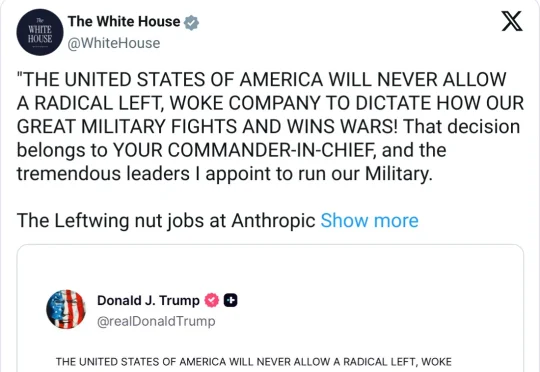

最近,炸裂消息一个接一个。首先,DeepSeek V4将在一周内上线。第二,它跳过英伟达,把访问权限首先给了某国内芯片厂商。另外,Anthropic因为蒸馏事件,也被群嘲了。

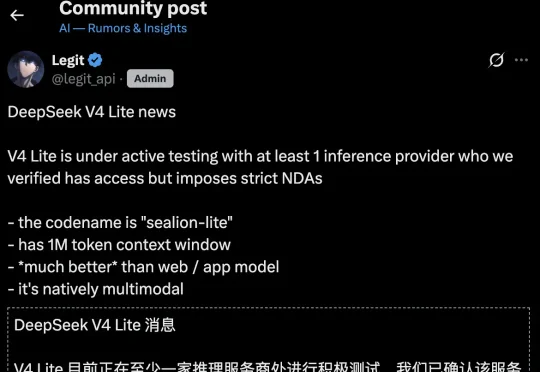

2026 年 2 月 15 日,Sam Altman 宣布:Peter Steinberger 加入 OpenAI,负责下一代个人 Agent。11 天后,Anthropic 宣布收购 Vercept。但这两件事放在一起看,说的是同一件事:AI 的战场正在发生一次非常具体的迁移——从「谁的模型更聪明」,到「谁能让 AI 真正控制一台电脑」。

有一说一,Anthropic这家公司虽然贱不喽嗖的,但是做产品,是真的好。。。昨天凌晨,Claude Code终于上了我梦寐以求的一个功能。remote control。远程控制。

Anthropic 周三宣布已收购 Vercept,这家 AI 初创公司团队核心成员与西雅图科技界的多家知名企业渊源深厚。此次收购是继去年 12 月 Anthropic 收购编程智能体引擎 Bun 以推动 Claude Code 规模化发展之后的最新动作。

美国五角大楼正向 Anthropic 极限施压,要求彻底解除 Claude 的军事应用限制。会后,Anthropic 发布新版政策。公司正式放弃了「单方面暂停大模型训练」的安全承诺。在政治与商业的双重压力下,AI 安全理想主义最终向现实妥协。

「software armageddon(软件末日)」——这是外媒描述过去几个月软件板块遭遇时用的词。Anthropic 每推出一个新工具,市场就会条件反射式地先问一遍:又有哪些软件要被干掉?然后果断抛售手里的股票。

硅谷曾是全球码农的「养老天堂」:下午四点的冲浪板、吃不完的零食、永远不响的手机。但到了2026年,这里只剩下一个身份:全球最昂贵的顶级血汗工厂。OpenAI和Anthropic的天才们正在用健康和家庭,给人类史上最贪婪的吞金兽——AGI,充当一次性燃料。

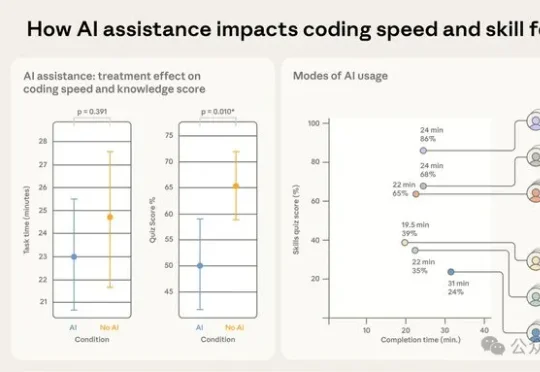

在AI编程时代,效率飙升却隐藏危机:Anthropic最新研究揭示,使用AI助手虽能快速生成代码,但开发者在概念理解、代码阅读和调试能力上显著落后。独立解决问题才是技能之钥,AI若不当用,将成「懒惰陷阱」。