刚刚,Anthropic紧急换帅!新任CTO执掌算力命脉,直面OpenAI千亿赌局

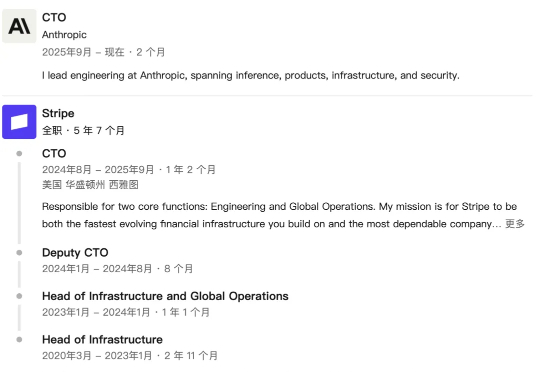

刚刚,Anthropic紧急换帅!新任CTO执掌算力命脉,直面OpenAI千亿赌局Anthropic宣布任命前Stripe CTO Rahul Patil为新任首席技术官,此次换帅旨在强化Anthropic的AI基础设施,以应对Claude产品快速增长带来的算力和能耗压力。同时,也是为了面对OpenAI和Meta数千亿美元级的基础设施投入而进行的一次战略调整。

Anthropic宣布任命前Stripe CTO Rahul Patil为新任首席技术官,此次换帅旨在强化Anthropic的AI基础设施,以应对Claude产品快速增长带来的算力和能耗压力。同时,也是为了面对OpenAI和Meta数千亿美元级的基础设施投入而进行的一次战略调整。

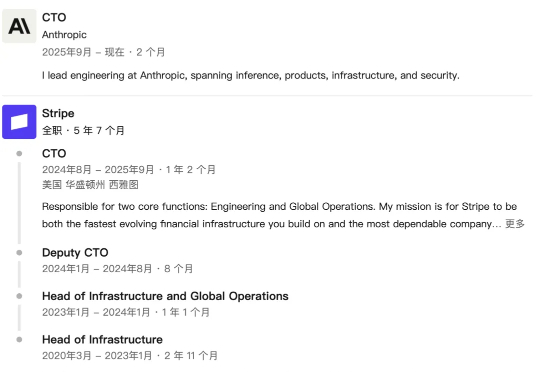

最强编程模型让位了。 但没有换人,依然是Claude。 新发布的Claude Sonnet 4.5,在SWE-bench上的成绩比Sonnet 4提升了1.8个百分点,而且提质不加价。

今天凌晨,Claude Sonnet 4.5发布了!新模型在编码、计算机使用、推理、长任务能力、安全对齐上的水平全面拔高,成为新一代编程模型王者。新一轮围绕编程展开的百模大战即将展开,而Claude Sonnet 4.5即将成为大家争相对标的新对象

Anthropic、OpenAI等大厂,正计划每年投入10亿美元,教会AI像人类一样工作。他们不仅为AI提供强化学习环境(RL environment,简称gym),还让AI「偷师」各领域专家。OpenAI高管预言,未来「整个经济」,将在某种程度上变成一台「RL机器」。

“未来 1-5 年,可能有一半的白领岗位会消失,失业率会飙升至 10% 到 20%,无论这项技术能带来多少好处”。Anthropic 联合创始人 Dario Amodei 此前曾在采访中表示。这个观点一时引起了大家的广泛关注。

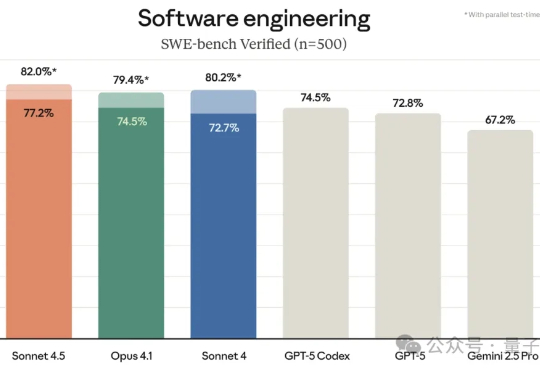

在 AI 辅助编程领域,Anthropic 推出的 Claude Code 命令行工具已成为开发者常用的助手。它允许从终端直接调用 Claude Sonnet 等模型,处理脚本编写、代码调试和系统命令执行等任务。

没有永恒的同盟,只有永恒的资本和利益

“看得出 Anthropic 是真急了,都开始澄清了。”有网友在看到发文解释 8 月至 9 月初陆续出现 bug 的推文后表示。“产品质量这么差。我之前不明白为什么,现在明白了。”开发者 Tim McGuire 在帖子下表示。

9月17日消息,AI领域的两大巨头Anthropic和OpenAI正致力于开发能够替代人类执行复杂工作的“AI同事”。其核心方法是使用模拟企业软件来训练AI模型,使其能像人类员工那样理解和操作真实的工作流程。

ChatGPT首份使用报告重磅上线!周月活飙至7亿,它已成为高学历白领的办公利器,编程却成为冷门。同时,Anthropic最新报告称,人们交给Claude完成任务暴涨至49%。