MiniMax海螺首次开源 VTP,打通了 Visual Tokenizer 的 Scaling Law

MiniMax海螺首次开源 VTP,打通了 Visual Tokenizer 的 Scaling LawMiniMax 海螺视频团队「首次开源」了 VTP(Visual Tokenizer Pre-training)项目。他们同步发布了一篇相当硬核的论文,它最有意思的地方在于 3 个点:「重建做得越好,生成反而可能越差」,传统 VAE 的直觉是错的

MiniMax 海螺视频团队「首次开源」了 VTP(Visual Tokenizer Pre-training)项目。他们同步发布了一篇相当硬核的论文,它最有意思的地方在于 3 个点:「重建做得越好,生成反而可能越差」,传统 VAE 的直觉是错的

智东西12月19日报道,由三名00后武汉大学校友创办的大模型领域科技创企模态跃迁(MercAllure),已完成两轮累计数千万元融资,投资方包括深圳高新投、力合科创、楚天凤鸣天使基金、武汉基金、奇绩创坛等机构。

具身智能通往通用性的征途,正被 “数据荒漠” 所阻隔。当模型在模拟器中刷出高分,却在现实复杂场景中频频 “炸机” 时,行业开始反思:我们喂给机器人的数据,是否真的包含人类操作的精髓?近日,深度机智在以人类第一视角为代表的真实情境数据,筑牢物理智能基座,解决具身智能通用性难题的道路上又有重要举措。

智能体元年已至,AI下半场的“生产力战争”已经打响。

视觉–语言–动作(VLA)模型在机器人场景理解与操作上展现出较强的通用性,但在需要明确目标终态的长时序任务(如乐高搭建、物体重排)中,仍难以兼顾高层规划与精细操控。

2027年落地,主攻AI推理。

人类打字速度,竟成了制约AGI的瓶颈?近日,OpenAI Codex负责人Alexander Embiricos爆出了这一惊人观点。Embiricos还预测,2026年,当AI开始在一些领域具备自我审查能力,将触发生产力出现「曲棍球杆式」飞跃增长,并带动人类迈向AGI。

面对「9 块 9 包邮」的耳机内卷,传统制造商何卫自投 1000 多万 All-in 新品 MusicCam。他坚信,只有通过重投入、差异化和清晰的海外布局,才能摆脱「乙方」的命运,重新夺回市场主动权。

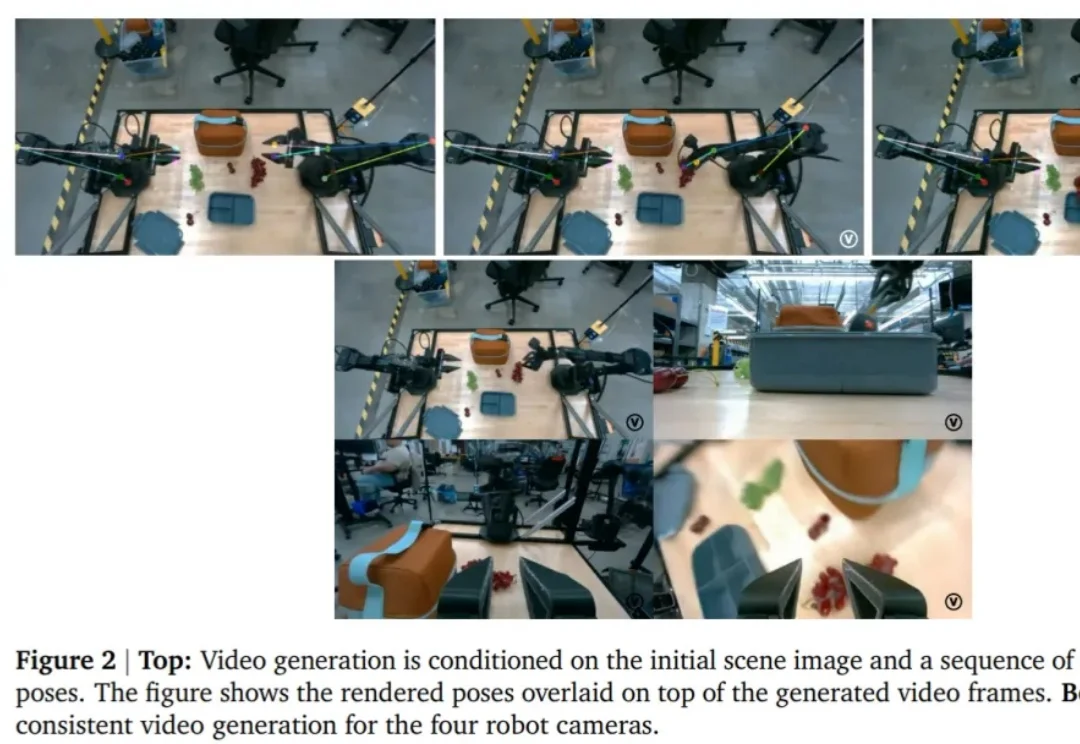

随着通用型(Generalist)机器人策略的发展,机器人能够通过自然语言指令在多种环境中完成各类任务,但这也带来了显著的挑战。

「奔向AGI」栏目聚焦AI大模型、AI agent、AI应用、芯片、机器人等前沿、热门的AI技术和商业创新。 作者丨冯汝梅 编辑丨关雎 人工智能赛道又一个惊人融资事件诞生。 2025年12月8日,由前