AI记忆革命爆发!Clawdbot如何像大脑般记住一切

AI记忆革命爆发!Clawdbot如何像大脑般记住一切一个开源AI,能记住你几个月前的决定、在本地替你跑活、还不受大厂控制:Clawdbot到底是个人助理,还是下一代「赛博打工人」?

搜索

搜索

一个开源AI,能记住你几个月前的决定、在本地替你跑活、还不受大厂控制:Clawdbot到底是个人助理,还是下一代「赛博打工人」?

2026 刚开年,Anthropic 就用 Claude Cowork 开启了 AI 行业新的创业热点。

过去一年,几乎所有 AI 产品都在谈一个词:记忆。

思维导图曾被证明可以帮助学习障碍者快速提升成绩,那么当前已经可堪一用的智能体系统如果引入类似工具是否可以帮助改善长期学习记忆能力呢?有研究团队做出了探索性尝试。

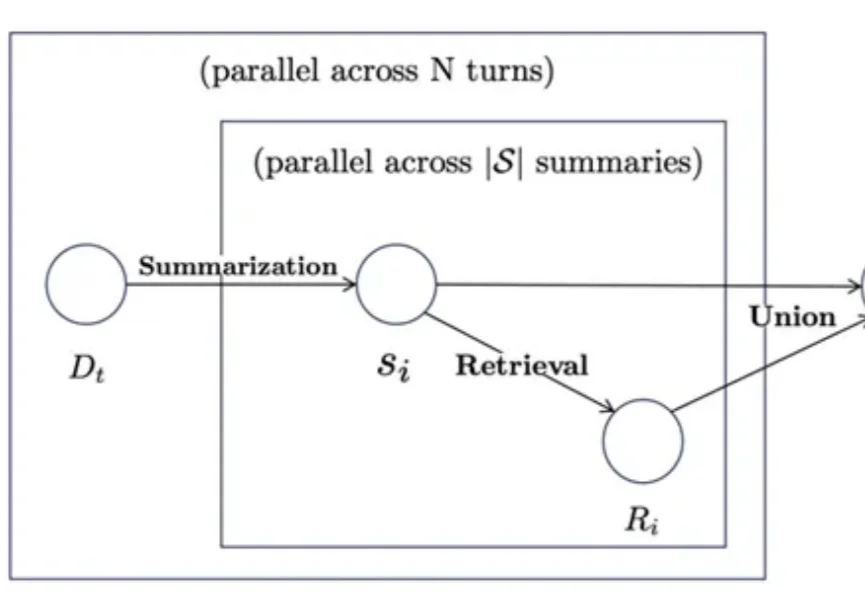

现有AI记忆评测存在局限,如数据源单一、忽视变化本质、注入成本高等。CloneMem通过层次化生成框架构建合成人生,设计贴近真实场景的评测任务,涵盖多种问题类型。

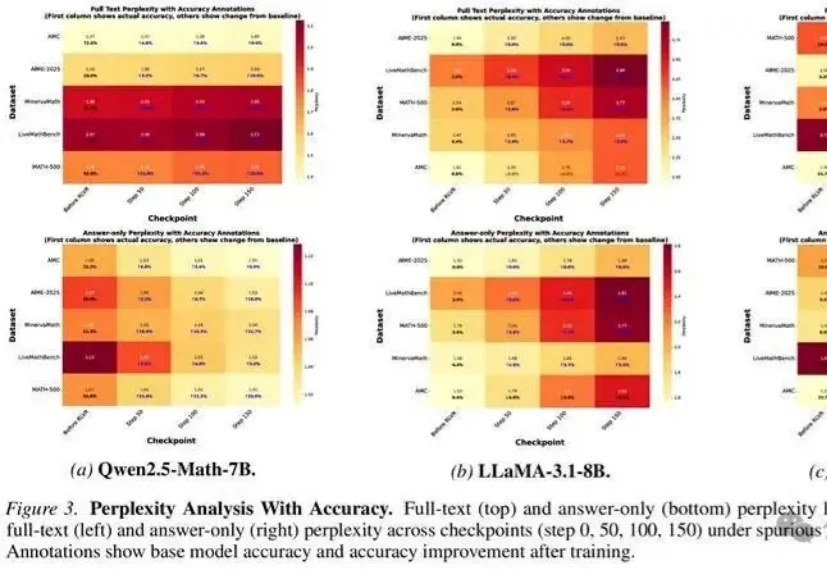

无需真实奖励,哪怕用随机、错误的信号进行训练,大模型准确率也能大幅提升?

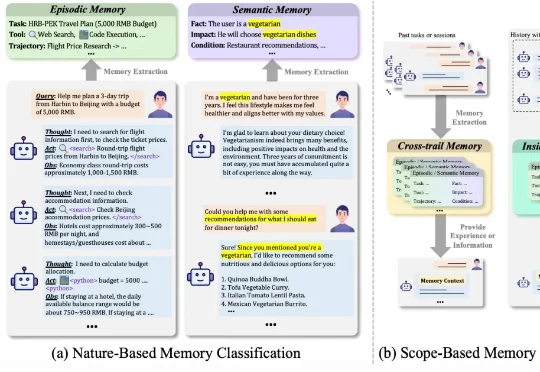

哈工大、鹏城实验室、新加坡国立、复旦、北大联合发布了一篇重磅综述《AI Meets Brain: A Unified Survey on Memory System from Cognitive Neuroscience to Autonomous Agents》,首次打破认知神经科学与人工智能之间的学科壁垒,系统性地将人脑记忆机制与 Agents 记忆统一审视,

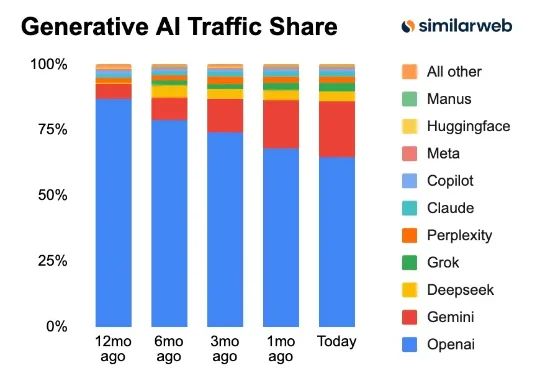

最近,奥特曼的焦虑肉眼可见。去年年底,谷歌Gemini 3横空出世,一举横扫各大榜单,将ChatGPT狠狠拽下了神坛。为了抢回AI皇冠,奥特曼不得不拉响「红色警报」。

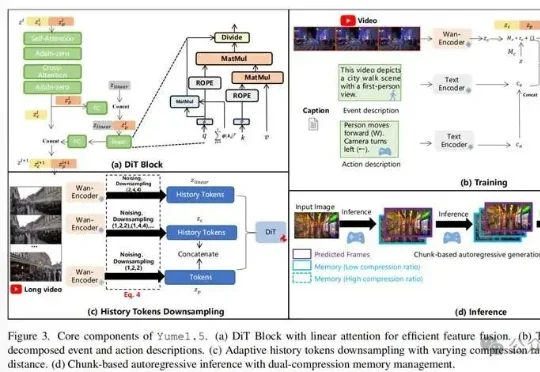

上海AI Lab联合多家机构开源的Yume1.5,针对这一核心难题提出了时空信道联合建模(TSCM),在长视频生成中实现了近似恒定计算成本的全局记忆访问。

我正在用 ChatGPT 给自家的狗生成一张穿着鹈鹕服装的搞笑照片。几秒钟后,图片出来了——狗狗的装扮很完美,但图片左侧莫名其妙多了一个「Half Moon Bay」(半月湾)的标志。