突发,Grok-3免费上线!答对9.11和9.9谁大,1分攻克MIT积分难题

突发,Grok-3免费上线!答对9.11和9.9谁大,1分攻克MIT积分难题刚刚Grok-3免费开放了!DeepSearch和Think两大模式加持,刚上了热搜的「9.11和9.9哪个大」终于能做对了(但没全对),甚至1分钟秒解MIT积分赛题。然而,它刚一亮相就遭OpenAI研究员「打假」,被对方质疑作弊。

刚刚Grok-3免费开放了!DeepSearch和Think两大模式加持,刚上了热搜的「9.11和9.9哪个大」终于能做对了(但没全对),甚至1分钟秒解MIT积分赛题。然而,它刚一亮相就遭OpenAI研究员「打假」,被对方质疑作弊。

中国初创企业DeepSeek(深度求索)开发的高性能、低成本生成式AI(人工智能)大规模语言模型(LLM)受到了全世界的关注。日本经济新闻(中文版:日经中文网)就如何评价该公司的最新AI模型、安全性方面的风险、以及对日本企业的影响等问题,采访了日本AI研究领域的第一人、东京大学教授松尾丰。

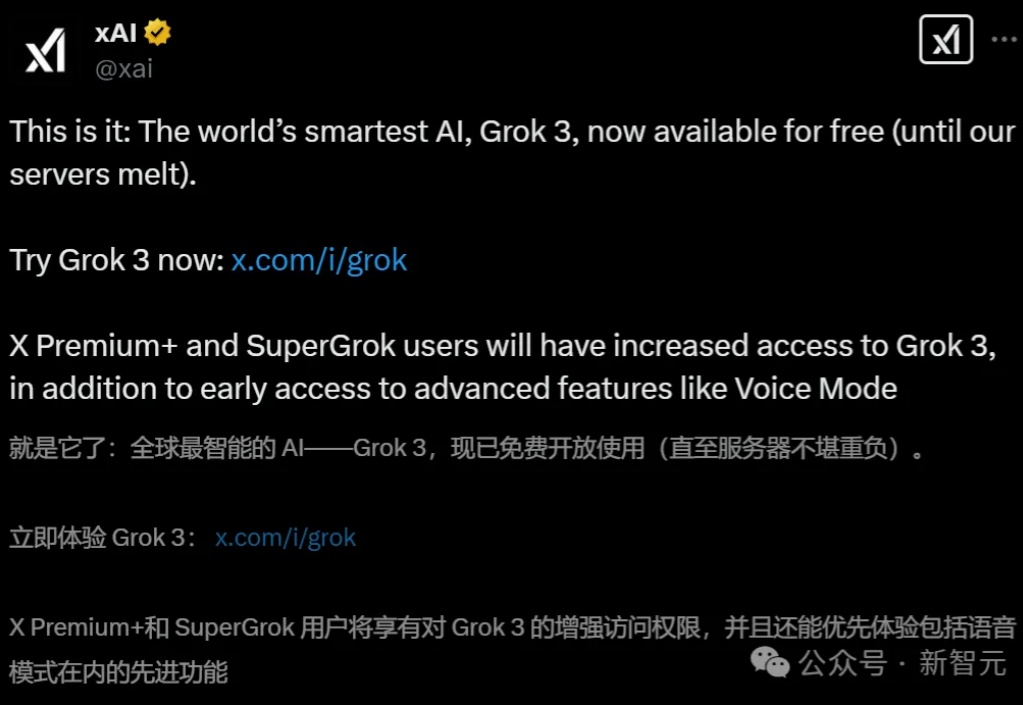

梁文峰说,钱从来都不是问题,唯一担心的是缺算力。不过,基于国产昇腾算力的DeepSeek R1系列推理API,性能已经直接对标高端GPU了!而且,华为已经率先携手国内15所头部高校,打造出了独一份的科教创新卓越/孵化中心,通过产教融合、科教融汇破解高校科研的算力困局。

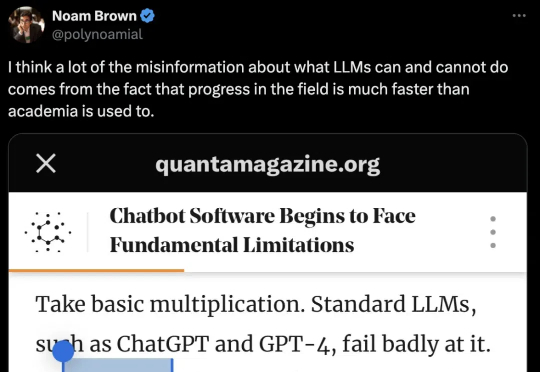

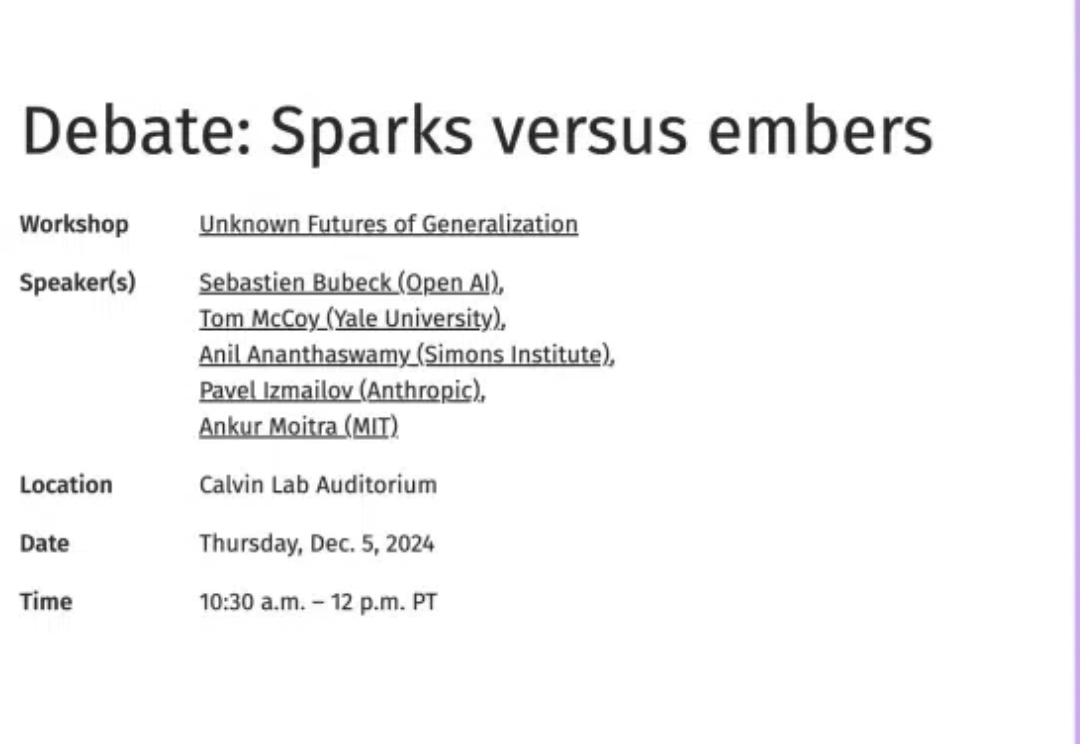

一篇报道,在AI圈掀起轩然大波。文中引用了近2年前的论文直击大模型死穴——Transformer触及天花板,却引来OpenAI研究科学家的紧急回应。谁能想到,一篇于2023年发表的LLM论文,竟然在一年半之后又「火」了。

Ilya Sutskever 在 NeurIPS 会上直言:大模型预训练这条路可能已经走到头了。上周的 CES 2025,黄仁勋有提到,在英伟达看来,Scaling Laws 仍在继续,所有新 RTX 显卡都在遵循三个新的扩展维度:预训练、后训练和测试时间(推理),提供了更佳的实时视觉效果。

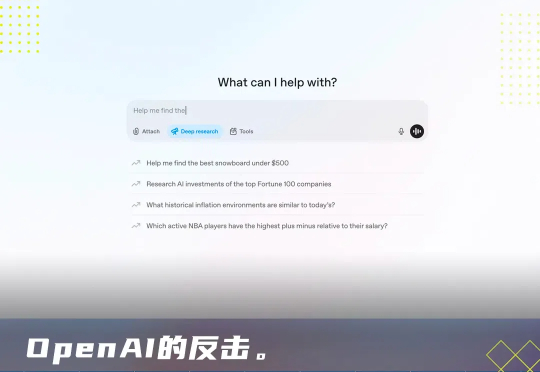

刚推出o3-mini的OpenAI没闲着,昨天又马不停蹄地发布了一个新东西:能为用户独立工作的AI研究助手「Deep Research」。

2025年1月26日,拾象创始人兼CEO李广密,组织了一场关于 DeepSeek的闭门讨论会,嘉宾包括数十位顶尖AI研究员、投资人与一线 AI 从业者,围绕DeepSeek的技术细节、组织文化以及其出圈后的短中长期影响等,进行了探讨与学习。

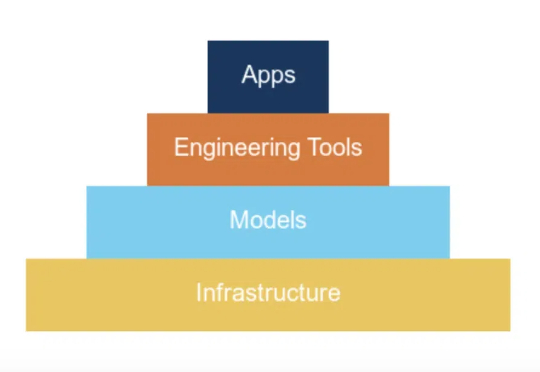

本月,OpenAI科学家就当前LLM的scaling方法论能否实现AGI话题展开深入辩论,认为将来AI至少与人类平分秋色;LLM scaling目前的问题可以通过后训练、强化学习、合成数据、智能体协作等方法得到解决;按现在的趋势估计,明年LLM就能赢得IMO金牌。

斯坦福HAI的研究员Michael Kratsios,被任命为白宫科技政策办公室主任,及特朗普政府的总统科技助理。从马斯克、AI沙皇到HAI研究员,这几轮任命彰显出:美国开始在国家层面推动科技政策发展,大力发展AI。

投资界获悉,备受关注的前OpenAI研究与安全副总裁翁荔(Lilian Weng)近日宣布,她正式加入硅谷早期投资机构Fellows Fund的Fellow团队,担任Distinguished Fellow,开启新一段征程。