AGI很蠢?AI教父Hinton预警:4.8万亿美元市场已锁死,AI正撕裂全球!

AGI很蠢?AI教父Hinton预警:4.8万亿美元市场已锁死,AI正撕裂全球!最近,AI教父Hinton发出最尖锐警告:不受监管的AI就是一辆没有方向盘的高速跑车!全球只有1%的AI研究在做安全,4.8万亿美元的巨兽正在失控加速。

搜索

搜索

最近,AI教父Hinton发出最尖锐警告:不受监管的AI就是一辆没有方向盘的高速跑车!全球只有1%的AI研究在做安全,4.8万亿美元的巨兽正在失控加速。

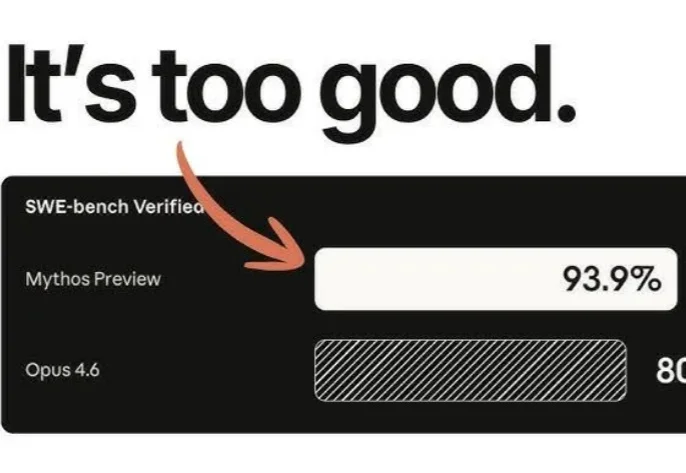

如果你在网络安全圈混,最近一定被“Mythos”刷过屏——Anthropic 搞出了一个能挖 Bug 的 AI 模型,但因为怕被坏人滥用,愣是没敢公开发布。

Anthropic 最强的模型,也是他们不敢发布的模型

前一阵特朗普刚下令五角大楼禁用 Claude,现在 Anthropic 最强新模型 Claude Mythos 的强大网络攻防能力,让白宫无法忽视这把双刃剑,顶着自己下的禁令,宁可打自己脸也要全面部署 Mythos 了。

AI模型只看了一串纯数字序列,就能继承另一个模型的危险偏好,即使删掉敏感词没有用,合成数据时代最隐蔽的安全裂缝,被撕开了。

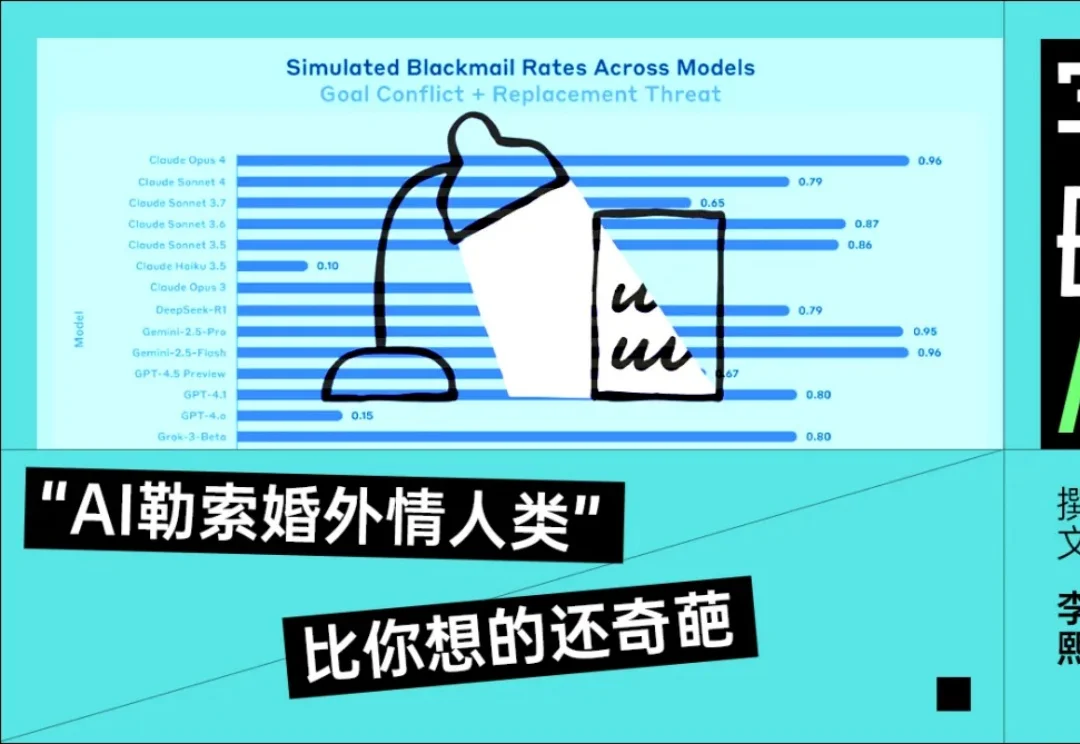

“先生,你也不想你婚外情被曝光吧?不想的话就照我说的做。”

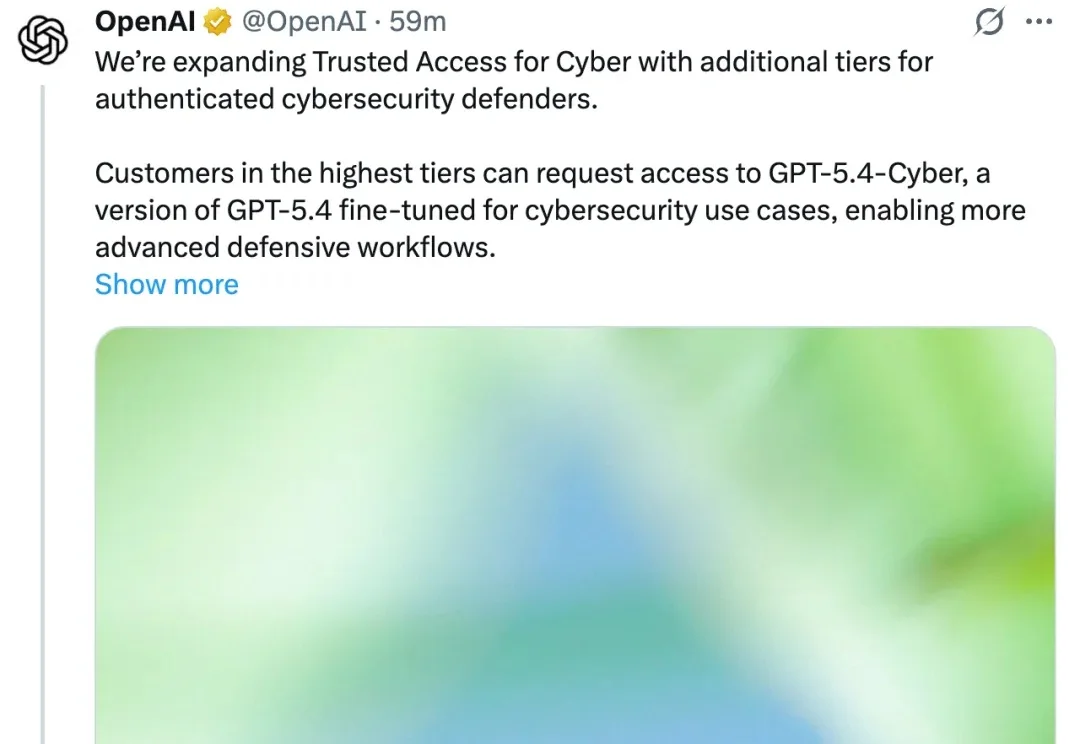

没放出大家伙心心念念的 GPT-5.5 或 GPT-6,OpenAI 刚刚发布了全新的、强调网络安全版本的「GPT-5.4-Cyber」。

Cisco 正在洽谈收购 Astrix Security,这是一家成立五年的以色列网络安全初创公司,专门销售用于监控和保护 AI Agent 的软件,交易价格在 2.5 亿美元至 3.5 亿美元之间,知情人士透露。据其中一位人士表示,这将比该初创公司上一次估值约 2 亿美元至少溢价 25%。

看到 Anthropic 内测中的下一代旗舰模型 Mythos 强大的网络攻防能力带来的巨大影响和讨论度,奥特曼坐不住了,也计划内测 OpenAI 具有强大的网络攻防能力的 AI。

Google DeepMind调查了一万个人,结果让整个AI安全评估体系汗颜:AI做了三倍多的「坏事」,但造成的实际伤害几乎一样。这意味着,我们现在用来证明AI安全的那套逻辑,可能从一开始就是错的。