会用AI才能多发论文,LLM助力科研效率提升!新研究登Nature子刊

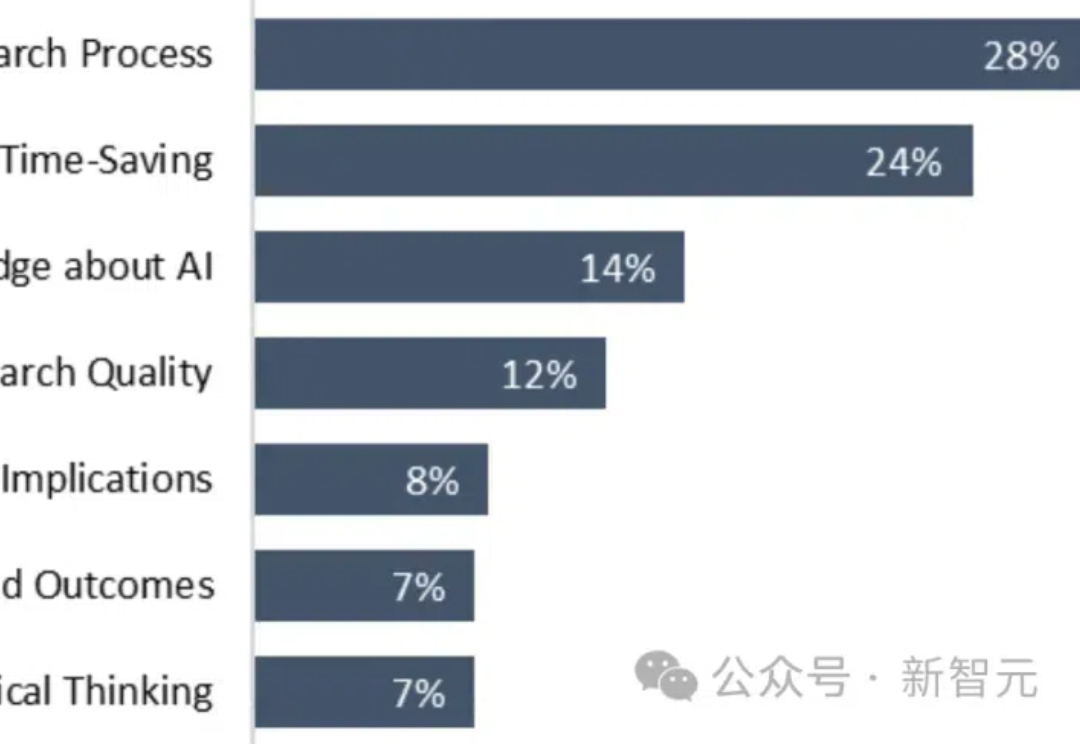

会用AI才能多发论文,LLM助力科研效率提升!新研究登Nature子刊Nature子刊近日发布了一项研究,针对学术写作中大模型的使用。他们发现,那些了解LLM以及大模型相关技术的受访者有更多的发表文章数量。

Nature子刊近日发布了一项研究,针对学术写作中大模型的使用。他们发现,那些了解LLM以及大模型相关技术的受访者有更多的发表文章数量。

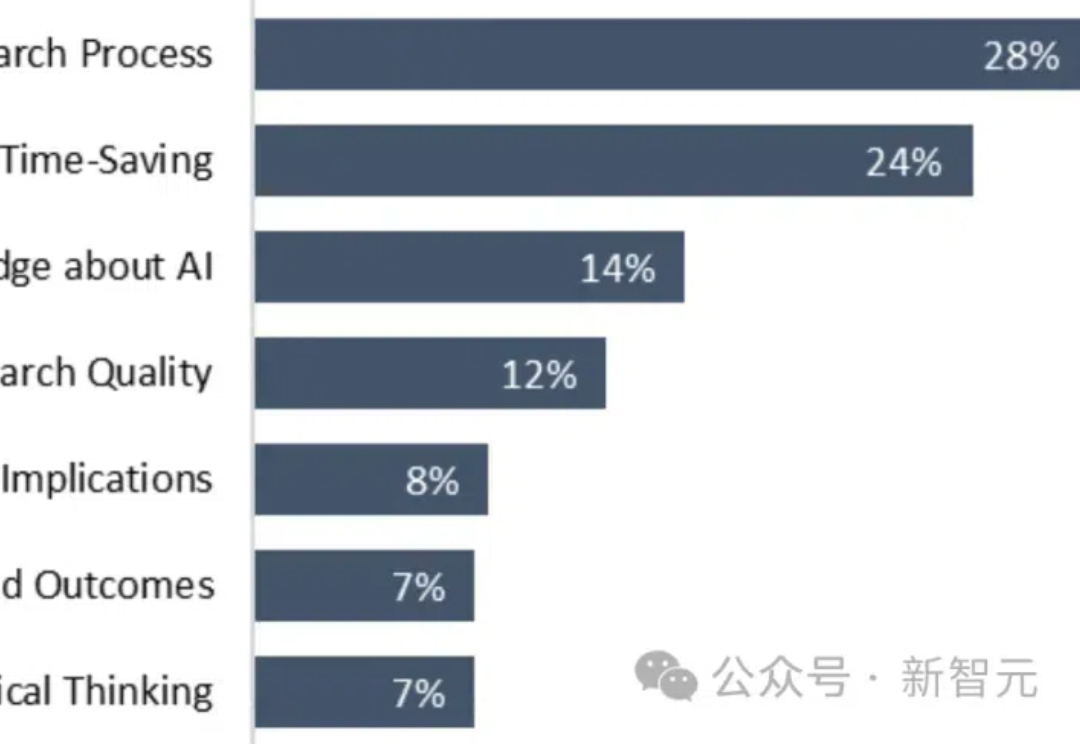

2024年11月15日,加州理工学院生物学和生物工程系的Jieyu Zheng和Markus Meister发表了一篇震撼学界的论文《The Unbearable Slowness of Being: Why do we live at 10 bit/s?》[1]。这项研究揭示了一个令人不安的事实:人类大脑每秒仅能处理大约10比特信息。

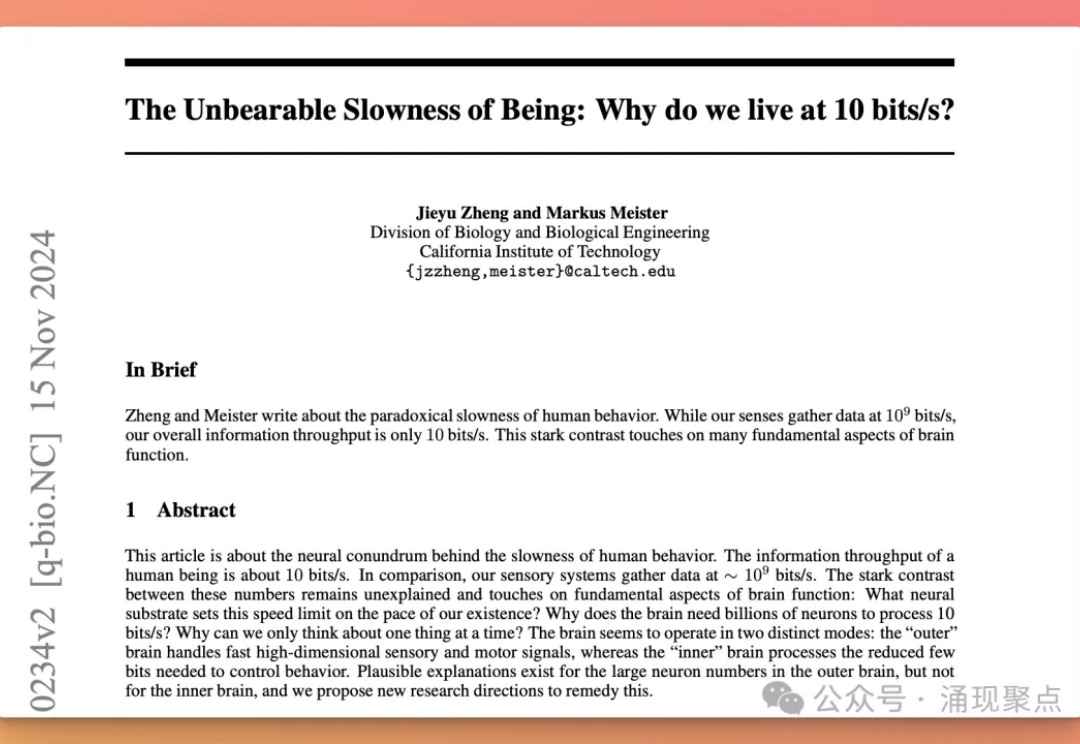

发表于昨天的论文《Agent Laboratory: Using LLM Agents as Research Assistants》对于科研界具有划时代意义,过去几周才能完成的科研任务现在仅需20分钟到一两个小时左右(不同LLM),花费2-13个美金的Token即可完成!

一个温知识: 联合国宣布,今年是“量子科学与技术之年”。 因为整100年前的1925年,正是以德国物理学家海森堡发表一篇名为《运动学和力学关系的量子力学重新诠释》的论文为起点,量子力学的现代时代,齿轮开始转动。

学生交完期末答卷,打工人写完年终总结,各自奔赴跨年现场,一年又过去了。这一年,AI改变了很多行业的生态,从业者的状态,尤其是在内容创作领域。世界开了巨大的AI“夸夸群”,称赞AI“伟力”的文案几乎成为互联网信息污染的一部分。

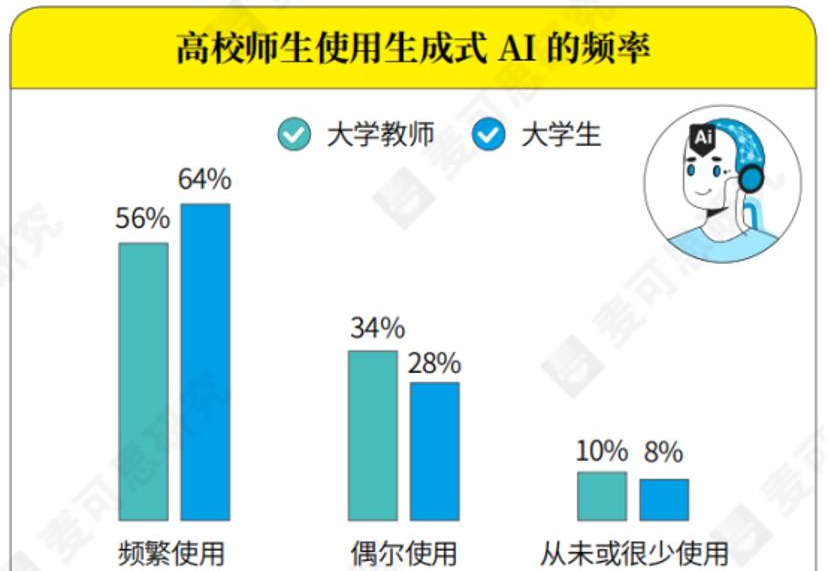

“高校发布AI禁令”成了热门话题,引发了教育界乃至社会的热烈讨论。当AI入侵互联网,我们该如何与AI共处?

2024 年,是 AI 领域让人兴奋的一年。在这一年中,各大科技公司、机构发布了数不胜数的研究。

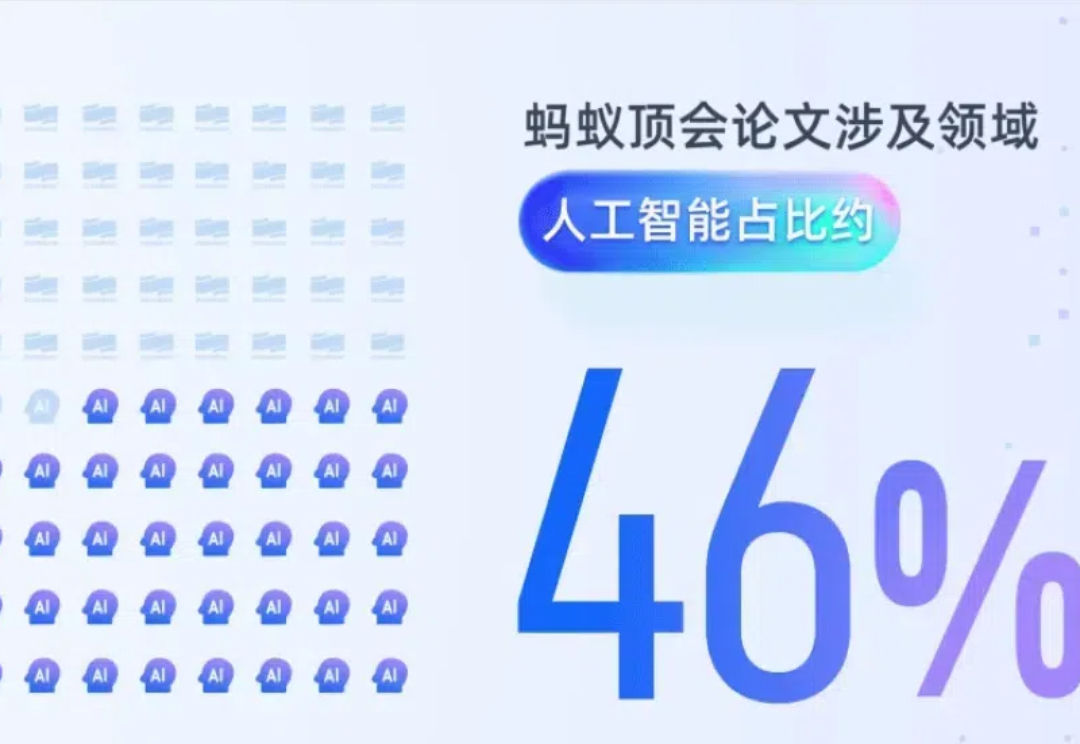

事情是这样的,我今天刷信息流的时候注意到,蚂蚁集团今天发布了 2024 科技生态白皮书,展示了他们在论文、专利、开源、标准、产学研等几个方面的进展。

AI真是助力科研的神器,不光能用大模型提升写作效率,跟AI技术沾边的论文中顶刊的概率也会增加,升职速度也会提升;但对于科学界来说,大家都一股脑去研究AI,那些不能用AI的领域受到了冷落,最终导致整体科研多样性下降。

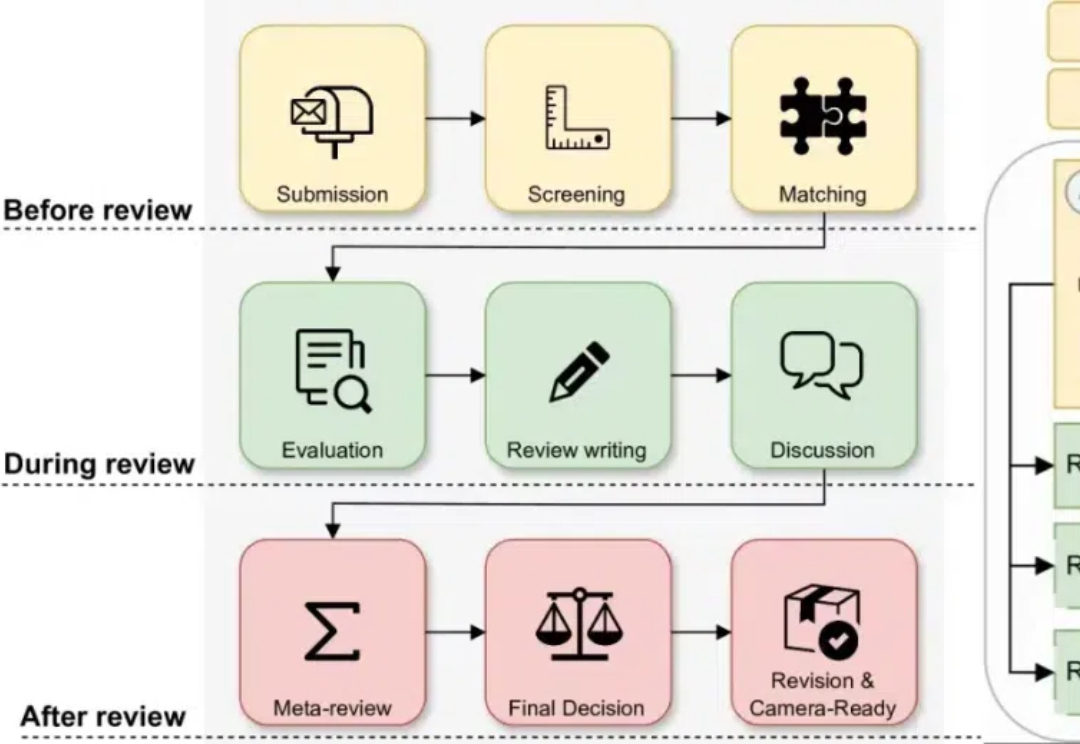

审稿人严重不足,审稿意见急剧下滑,CVPR官方坐不住了,不仅出台了七条新规,还再三强调,禁止审稿人用大模型生成/翻译评审结果。