马斯克最新预测:AI或在2030年超越人类智力,未来还可能“终结”人类

马斯克最新预测:AI或在2030年超越人类智力,未来还可能“终结”人类据国外媒体报道,特斯拉和SpaceX的首席执行官埃隆·马斯克(Elon Musk)日前在“丰富峰会”上与奇点大学和XPRIZE基金会创始人彼得·戴曼迪斯(Peter Diamandis)进行了线上对话。这次峰会由硅谷的奇点大学主办,该大学致力于向商业领袖提供前沿技术咨询。XPRIZE基金会通过举办科学竞赛推动科技创新,其中一些项目得到了马斯克的资助。

据国外媒体报道,特斯拉和SpaceX的首席执行官埃隆·马斯克(Elon Musk)日前在“丰富峰会”上与奇点大学和XPRIZE基金会创始人彼得·戴曼迪斯(Peter Diamandis)进行了线上对话。这次峰会由硅谷的奇点大学主办,该大学致力于向商业领袖提供前沿技术咨询。XPRIZE基金会通过举办科学竞赛推动科技创新,其中一些项目得到了马斯克的资助。

近期,一篇4万字的演讲风靡于国内人工智能(AI)学术圈。原华为"天才少年"、Logenic AI公司联合创始人李博杰博士,日前发表了一篇关于AI Agent思考的文章,题为"AI Agent 应该更有趣还是更有用"。

解决最短路径算法,也能被扩散模型完成。

fabrie上线两年了,布尔向量现在已经有了非常稳定的收入,是否可以分享一下商业化方面你们实际的一些经验?

LLM战场的新玩家,一出手就是王炸!信仰Scaling Law的阶跃星辰,一口气带来了Step-1千亿参数语言大模型、Step-1V千亿参数多模态大模型,以及Step-2万亿参数MoE语言大模型的预览版。而阶跃星辰之旅,终点就是AGI。

【新智元导读】GPT-5还未发布,GPT-6已经在路上了?微软工程师曝出,为GPT-6搭建10万个H100训练集群,整个电网却被搞崩。通往AGI大关,还需要破解电力难题。

LLM-Powered Agent凭借长期记忆+自主规划+自动执行等特性,是探索人工通用智能(AGI)的可能途径之一。从单一智能体到多智能体的迭代,是实现AI执行更多更复杂的工作的重要跨越。

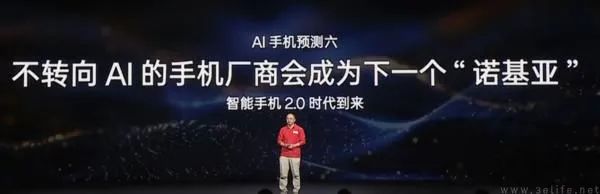

一旦AIGC进化成AGI,智能手机的好日子可能就要彻底结束了。不转向AI手机的厂商会成为下一个“诺基亚”,这是360公司创始人、董事长兼CEO周鸿祎一加Ace 3V发布会上的大胆预测。最近一段时间,AI手机可谓是手机圈最热门的概念,前有OPPO宣布进入AI手机时代、魅族要“All in AI”,后有小米集团合伙人、集团总裁卢伟冰认为,“AI是未来,是无处不在的能力,但AI手机是噱头”。

AGI时代,越来越近了。本月,中国初创AGI(通用人工智能)公司月之暗面宣布旗下大模型工具Kimi Chat正式升级到200万字参数量,与五个月前该大模型初次亮相时的20万字相比,提升十倍。Kimi Chat的升级彻底引爆市场,同时也引起长文本大模型(Long-LLM)细分赛道更加激烈的竞争。

我们就是奔着AGI去的,不然这群人聚在一起干嘛?2024年2月,在准备一场分享会的PPT中,前微软全球副总裁、如今的阶跃星辰CEO姜大昕,把他看到的一句评论放进了自我介绍: 在微软混得风生水起,怎么想不开创业?