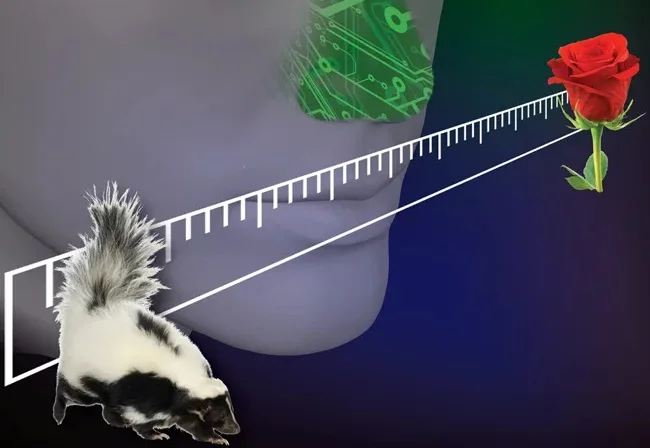

AI开始长鼻子了!比人类灵1000倍,能闻出癌症、打假球鞋、甚至给牛验孕...

AI开始长鼻子了!比人类灵1000倍,能闻出癌症、打假球鞋、甚至给牛验孕...人类花了几十年时间教会 AI“看”和“听”,最近,科学家们开始让它学会“闻”了。

人类花了几十年时间教会 AI“看”和“听”,最近,科学家们开始让它学会“闻”了。

小米MiMo团队中,每天Agent对话次数少于100次的,就离职吧。

《读佳》获悉,BOSS直聘推出全新AI招聘产品Deephire,依托人工智能技术打造招聘者与求职者的智能交互平台,打通岗位咨询、薪资查询、人才筛选、职业规划等招聘求职全场景需求,为企业和求职者提供更高效、精准的双向服务,助力招聘行业数字化升级。

好家伙,最近开源脑机这波热度简直了!

我们也在 Claude Code、本地部署的龙虾里,都接入了 MiniMax M2.7 模型,以及 MiniMax 提供的 MaxClaw,然后把真实的开发过程中遇到的 Bug、枯燥的金融数据,还有大量的长流程任务统统交给它。

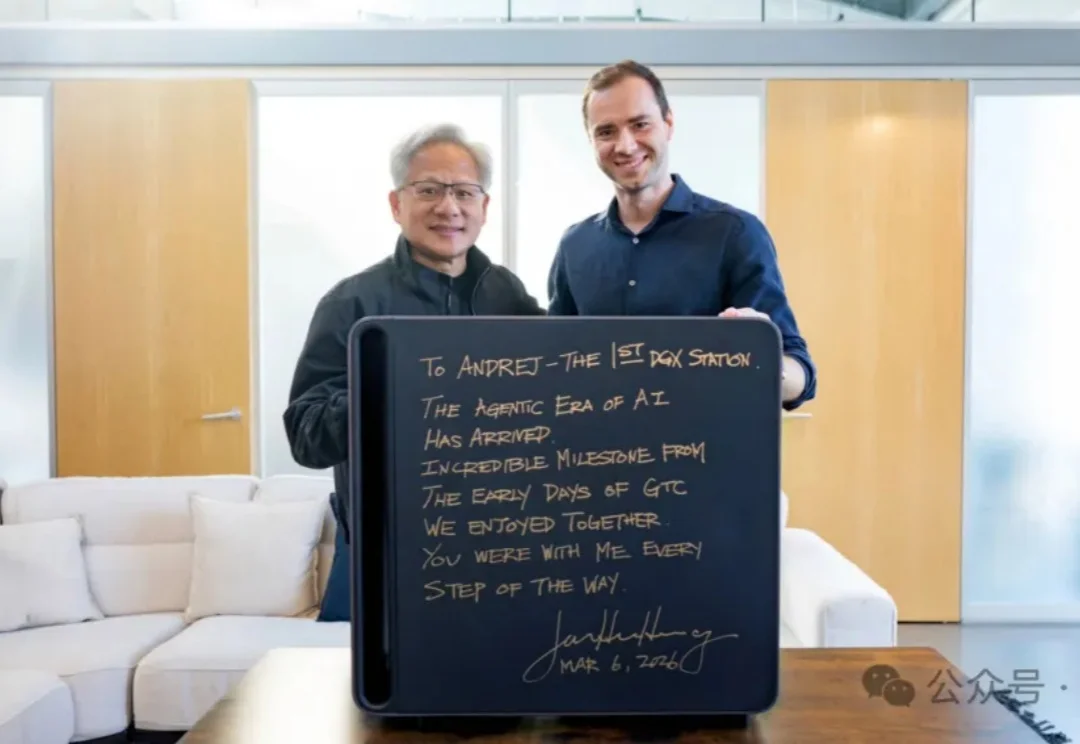

老黄又又又亲自上门送“显卡”了!

面壁智能为你单独造了个“养虾池”,把数据、模型、“龙虾”都留在本地。

大家好,我是袋鼠帝。 我最近终于给住进MacOS的龙虾装上了Claude Opus4.6的脑子。

AI下半场拼的是数据。

没有农民,没有农机手,甚至没有一个人站在田间地头。