Nature子刊!MIT华人科学家打造细胞版「谷歌地图」,破解亿万年生物学黑箱!

Nature子刊!MIT华人科学家打造细胞版「谷歌地图」,破解亿万年生物学黑箱!过去,科学家观察研究细胞的工具很有限。

过去,科学家观察研究细胞的工具很有限。

OpenAI深夜突袭,GPT-5.4新王炸场!一夜之间,直接粉碎了Gemini 3.1 Pro和Claude Opus 4.6的神话。这也是头一次,ChatGPT拥有真正「原生电脑使用」能力,办公效率直接拉满。而真正恐怖的地方在于,每一个维度上它都没有短板。

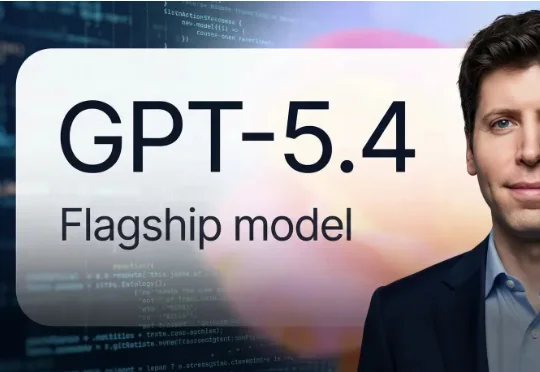

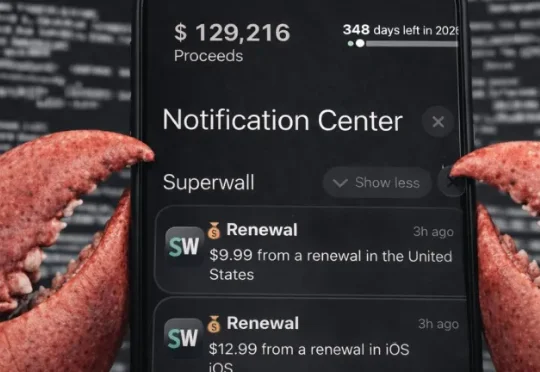

国外有一个小哥,超级个体,也就是现在国内流行的 OPC(一人公司),靠 11 个应用加 OpenClaw,每月能赚 7.3 万美元。这篇文章里,他专门拆解 OpenClaw 是怎么帮我们赚真金白银的,以及如何通过自动化把主动收入变成被动收入。

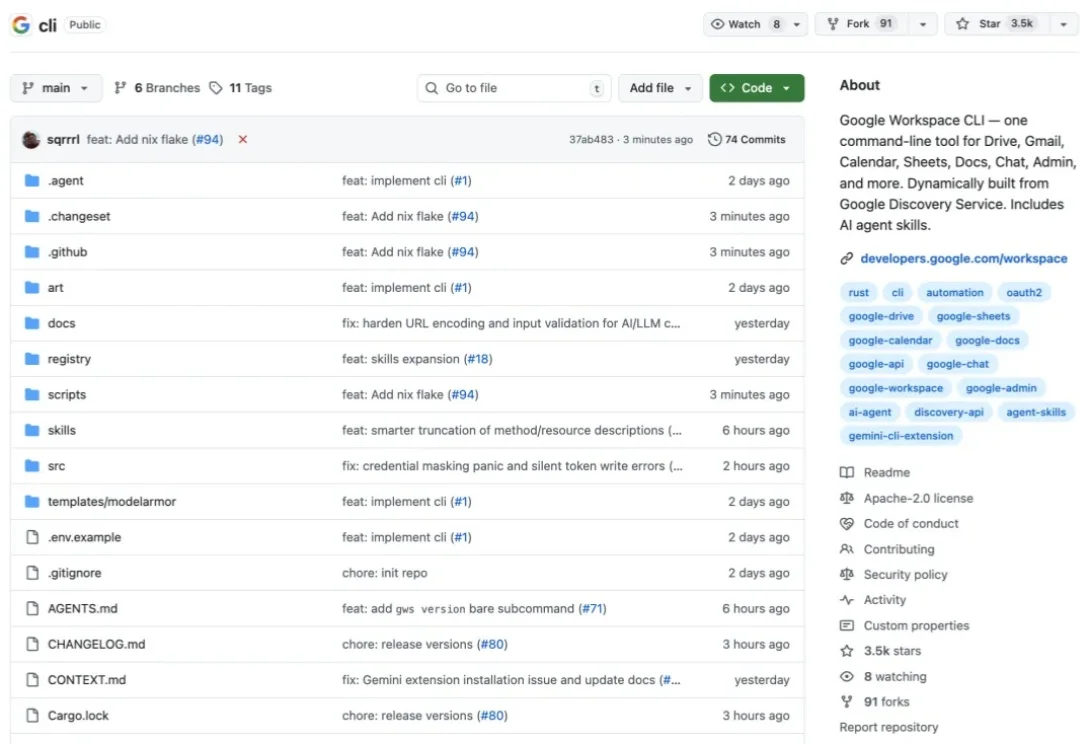

今天上午的时候,Google Workspace CLI 上线到了 GitHub,挂在 Google Workspace 的官方组织名下。我开始写这篇文章的时候,这个项目是 2700 个 Star;当我发出去的时候,重新截了个图,已经有 3500 个 Star 了

今一大早,收到了个消息: OpenAI 要上市了

大家好,我是最近一直在折腾 OpenClaw 的袋鼠帝。

OpenAI的人才地震还在继续!刚刚,前研究副总裁Max Schwarzer宣布离职,这位亲手主导o1、o3和整个GPT-5系列post-training的核心人物,选择加入Anthropic,重返一线RL研究。

资本正在加速押注具身智能的下一阶段。

一份绝密备忘录爆出,Dario Amodei彻底撕碎了OpenAI,怒喷「安全作秀」做样子给所有人看。但不可否认的是,美国务院正大面积抛弃Claude,接入GPT-4.1。

Agentic Engineering 这个词刚被大神 Karpathy 提出了 1 个月,就已经有了不少大佬现身说法如何管理你的 Agent团队了。