2026年了,你的AI为什么还被钉在电脑上?

2026年了,你的AI为什么还被钉在电脑上?我在淘宝上花了28块钱,买了一个很奇葩的东西。

搜索

搜索

我在淘宝上花了28块钱,买了一个很奇葩的东西。

感谢鲸鱼兄弟开源。

先说说什么是小孩 AI?说实话,我之前还真没怎么关注过。大致指的是:五年级搞智能驾驶,11 岁复刻 Minecraft,15 岁做 AI 创业公司雇了一个 38 岁员工,小学生 AI 编程速成营,AI 启蒙、AI 启智、AI 启辰,「不学编程的小孩会被 AI 时代淘汰」。

独家获悉,字节跳动日前低调公布全球首个25B级、基于混合专家 (MoE) -扩散自注意力机制(DiT) 的开源增强统一多模态模型Mamoda2.5。Mamoda2.5依托Qwen3-VL-8B、128 个专家,Top-8 路由的MoE+DiT架构搭建,最终模型参数高达250亿,而每次仅激活约30亿参数(约12%)。

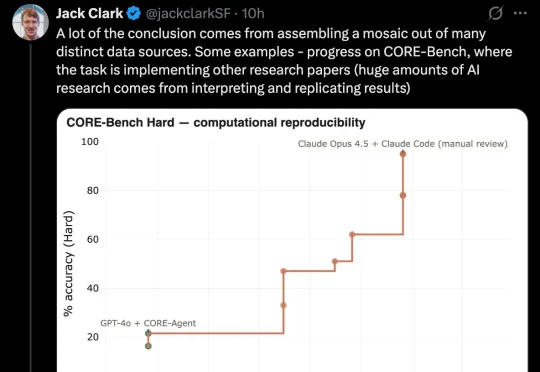

Anthropic联合创始人Jack Clark读完数百份公开数据,得出一个让他自己也坐不住的结论:2028年底前,AI自己造AI的概率是60%。支撑他这一判断的,是编程、科研复现、模型训练优化等多条能力曲线:每一条都在向右上方飞,没有减速迹象。

动点出海获悉,新加坡人工智能设计平台FORMAS.AI近日宣布获得398万美元pre-seed轮融资。FORMAS.AI面向建筑、工程与施工行业,提供AI原生设计平台。公司称,其产品主要服务建筑师、室内设计师和房地产团队,覆盖早期创意生成、渲染、方案迭代和展示等设计环节。

太炸裂了!刚刚,OpenAI总裁Brockman当庭承认:自己投入0美元,持有OpenAI营利部门300亿美元股份(马斯克捐了3800万,得到的是0)。更炸的是,Brockman和奥特曼都悄悄持有Cerebras个人股份。Gary Marcus直言,这是马斯克最接近赢的一次。

AI 很快就能自己改造自己了?Anthropic 联合创始人 Jack Clark 发帖称,他最近几周阅读了大量公开的 AI 开发数据后,认为到 2028 年底,递归自我改进(recursive self-improvement)发生的概率有 60%。

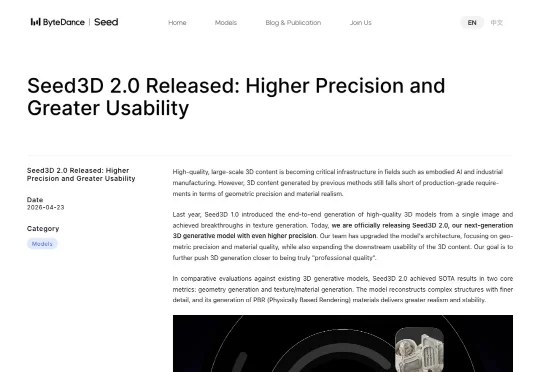

字节跳动 Seed 团队正式发布 Seed3D 2.0——一张图片就能生成高精度 3D 模型,几何和材质两大核心指标均达到 SOTA。60 位专业评测者盲评,人类偏好胜率最高达 89.9%,还能直接输出带关节信息的仿真级资产。推文近 900 赞、5.6 万次浏览迅速刷屏,但连发帖人自己都在评论区承认:「Meshy 和 Tripo 现在还是更好用。」

一位中国开发者自称用5个Claude AI代理并行工作,独自承接原本需要5-8人团队的外包项目,月入2.67万美元。这些数字来自B站视频的二次转述,无法独立核实——但真正值得注意的,是他描述的技术架构已经写进了Anthropic官方文档。