Anthropic让AI先读员工手册再上岗:失控率从54%降到7%

Anthropic让AI先读员工手册再上岗:失控率从54%降到7%Anthropic最新研究让AI先读懂规范背后的意义,再接受行为示范,在特定实验中将Agent失控率从54%压到7%。

搜索

搜索

Anthropic最新研究让AI先读懂规范背后的意义,再接受行为示范,在特定实验中将Agent失控率从54%压到7%。

最近,一家叫 CopilotKit 的公司宣布完成 2700 万美元的 A 轮融资,由 Glilot Capital、NfX 和 SignalFire 联合领投。这不只是一条融资新闻,它背后指向的是一个更大的问题:当 AI agent 已经可以真正嵌入应用、理解用户意图、生成动态界面、自主执行任务,我们今天所熟悉的软件交互方式,还能撑多久?

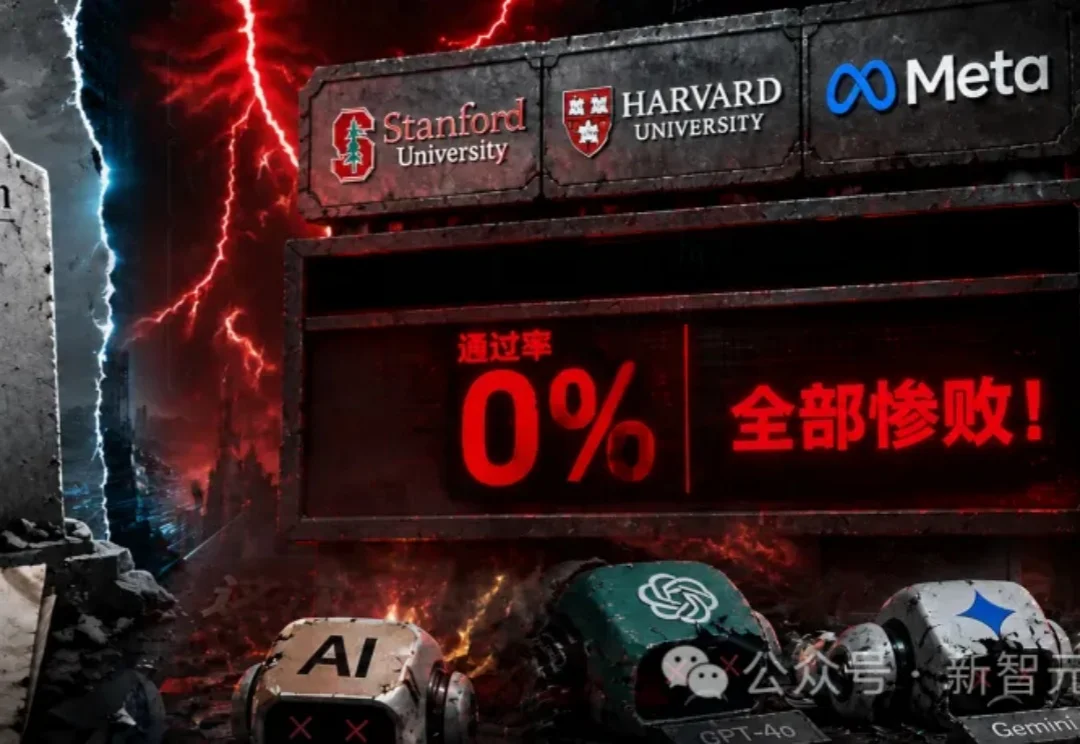

SWE-Bench上能拿72%的模型,换张考卷直接归零!Meta联合斯坦福、哈佛放出ProgramBench,200个项目从零手写,9大顶级模型完整通过率0%。最强的Claude Opus 4.7平均通过率也才51.2%。更离谱的是一联网,就有模型在36%的任务里跑去GitHub扒源码。

两位哈佛毕业的女生 Eva Tuecke 和 Catherine Yeo 用 AI 改变了电池故障排查,她们创立的 Altara 公司在近日获得 700 万美元种子轮融资,估值 7 亿美元,领投方是 Greylock。Neo、BoxGroup 和 Liquid 2 Ventures 也参与了本轮融资,此外还有包括 Jeff Dean 在内的知名天使投资人以及 OpenAI 和 AMD 的高层领导。

OpenAI 揭晓了 ChatGPT Futures 项目,为 37 名年轻人提供了 1 万美元的无偿资助、前沿模型访问权限,并邀请他们 6 月去总部参访

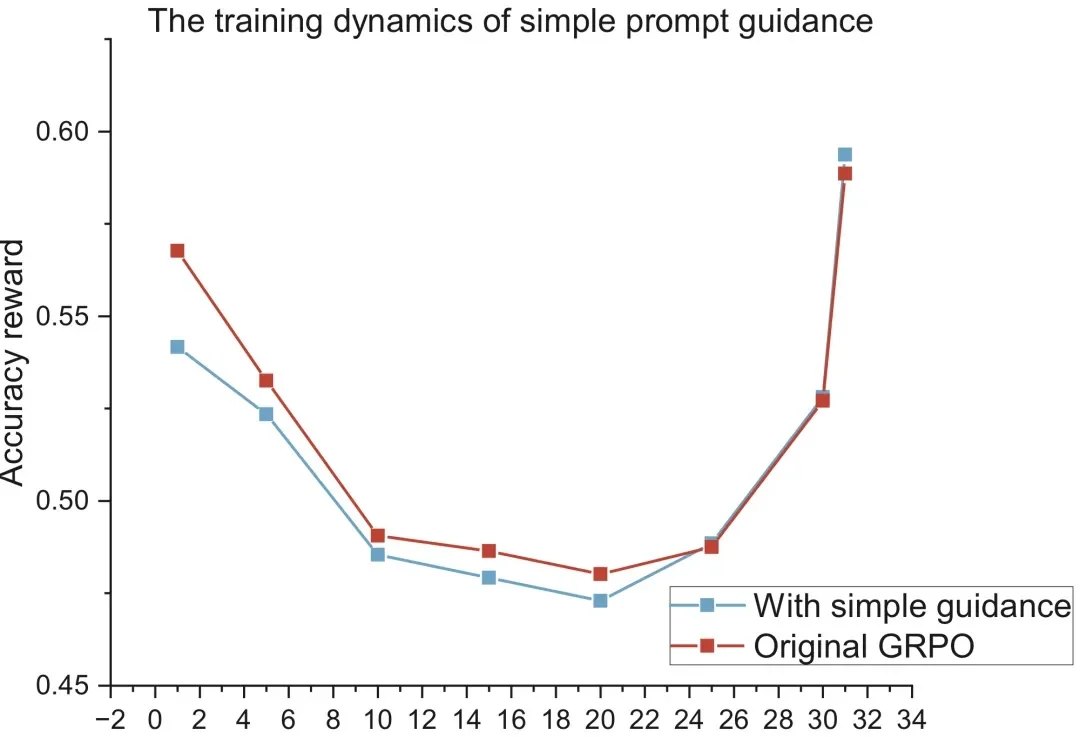

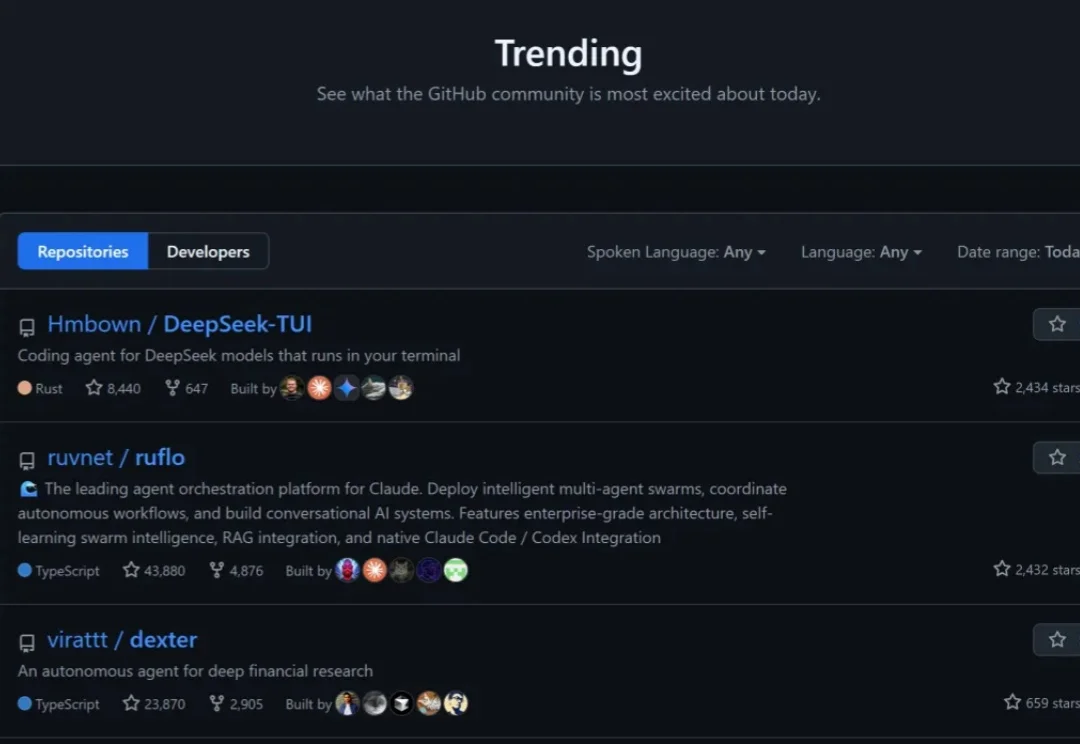

大模型时代的「炼金术师」们,或许都曾面临一个共同的困扰:当我们试图将 DeepSeek-R1、OpenAI-o1 那种惊艳的推理能力迁移到小规模语言模型(SLMs)时,效果却总是差强人意。现有的强化学习方法如 GRPO 在 7B+ 的大模型上效果显著,但一旦应用到 1.7B 甚至更小参数的模型上,性能提升就微乎其微。

Assort Health 是一家值得被认真拆解的初创公司。成立仅两年多,累计融资1.015亿美元,拿着300万美元的ARR(年度经常性收入),却获得了7.5亿美元的估值。Assort 最近推出主动式互动引擎 Activate,从被动接听到主动做患者唤醒和慢病管理,这已经是在为真正面向用户的智能体做铺垫了。

感谢鲸鱼兄弟开源。

AI 闹狩猎夜进入第二站——上海,活动逐渐呈现出我们期待的样子:具体的,奇怪的,有趣的、以及——该死的可爱。

2026年,一群AI研究者给模型制造了毒品。 没错,论文中就叫毒品——AI Drugs。 他们生成了一些256×256像素的图片,这些我们看着全是毫无意义的色块。但AI看了之后表现得近乎狂喜——它自己报告的幸福感飙到6.5/7。