“AI火了,我们却快完了!”顶级开源框架Tailwind之父含泪裁掉75%兄弟:半年后,这个项目可能就没了

“AI火了,我们却快完了!”顶级开源框架Tailwind之父含泪裁掉75%兄弟:半年后,这个项目可能就没了前端生态最具影响力的开源项目之一 Tailwind CSS,正经历一场罕见的生存压力测试。

前端生态最具影响力的开源项目之一 Tailwind CSS,正经历一场罕见的生存压力测试。

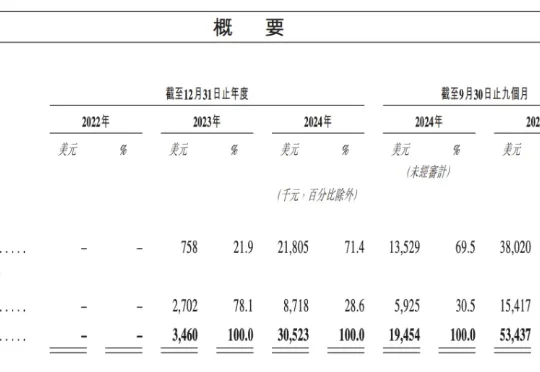

即将于 1 月 9 日敲钟上市的大模型公司 MiniMax,创下近年来港股 IPO 机构认购历史记录。此次参与 MiniMaxIPO 认购的机构超过 460 家,超额认购达 70 多倍。此前的认购记录属于宁德时代,其在 2025 年登陆港股市场时,剔除基石后超额认购 30 倍。

CES 2026新AI硬件巡礼:中国团队抢眼,“深圳军团”把性价比打到新高度。智东西1月7日报道,在国际消费电子展CES 2026上,AI正在以更隐蔽、也更具体的方式进入硬件世界,一批新型AI硬件和创意展品刷足了存在感。

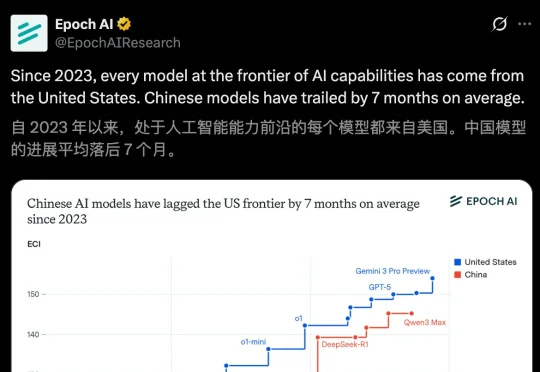

一张来自Epoch AI图表给出了一个冷静却尖锐的结论:中国AI平均落后7个月。一张图揭示真相:自2023年以来,前沿AI全部来自美国!最近,Epoch AI一份报告指出,中国AI模型的进展平均落后于美国7个月——最小差距为4个月,最大差距为14个月。

1月8日,大模型六小龙第一股,智谱上市了,市值直超551亿港元,而且一路涨幅超已逾7%。而就在上市前一天,小编注意到,智谱创立发起人兼首席科学家唐杰在微博上发布了一条充满预告意味的帖子,称:“AA(artificialanalysis)换了几个benchmark,基本是把原来刷爆的都换了,现在评估越来越难,新增加的Physical Reasoning貌似还很难。。。。”

本文为《2025 年度盘点与趋势洞察》系列内容之一,由 InfoQ 技术编辑组策划。本系列覆盖大模型、Agent、具身智能、AI Native 开发范式、AI 工具链与开发、AI+ 传统行业等方向,通过长期跟踪、与业内专家深度访谈等方式,对重点领域进行关键技术进展、核心事件和产业趋势的洞察盘点。

2023年启动大模型研发以来,腾讯第一次把大语言模型变成一把手工程,负责人是个27岁的年轻人;

目前最新的消费级 GPU,还是去年在 CES 上正式发布的 RTX 50 系列。其中必然有内存全球大涨价的原因,当前市场的内存成本,一周之内就能涨价 50%-100%,并且多个分析机构表示,涨价会持续到 2027 年。

一场AI界的《创造101》火了!LMArena让你盲投选出最强AI,三年从校园项目逆袭,刚刚融1.5亿美元,估值飙到17亿美元。众包投票挑战专家权威,争议四起,却已成行业标杆。你的票,就能决定下一个AI顶流!

2025 年 12 月 21 日,Steve Klabnik 迎来了他使用 Rust 的第十三个年头。作为 Rust 社区早期的核心人物之一,他在技术圈有着特殊的地位。在即将迈入 40 岁门槛之际,他在博客中坦言,过去几年过得颇为艰难,但现在的状态是「非常快乐」。