刚刚,全球最大高算力智能模组商港股上市!年入近30亿

刚刚,全球最大高算力智能模组商港股上市!年入近30亿供货蔚来比亚迪,美格智能再战港股。

供货蔚来比亚迪,美格智能再战港股。

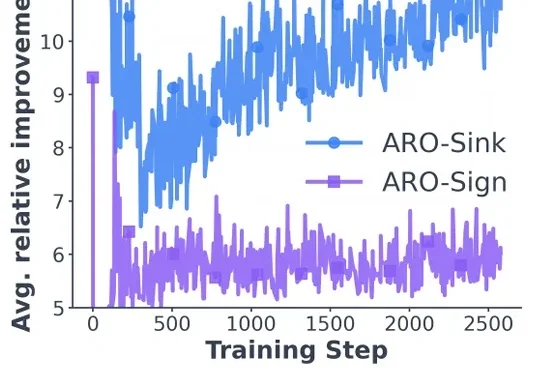

如果你在过去一年关注过大模型训练的技术,大概率听过 Muon 这个名字 —— 这个在月之暗面 K2 模型的相关讨论中走红的优化器,被视为是可能挑战 Adam 的新秀。它的思路很直接:对动量矩阵进行正交化,让各个奇异方向上的更新速率一致,提升训练效率。

分享个魔幻的事情: 我有一个在字节的朋友,上周末吃饭,他说他们字节内部开了个龙虾幼儿园。

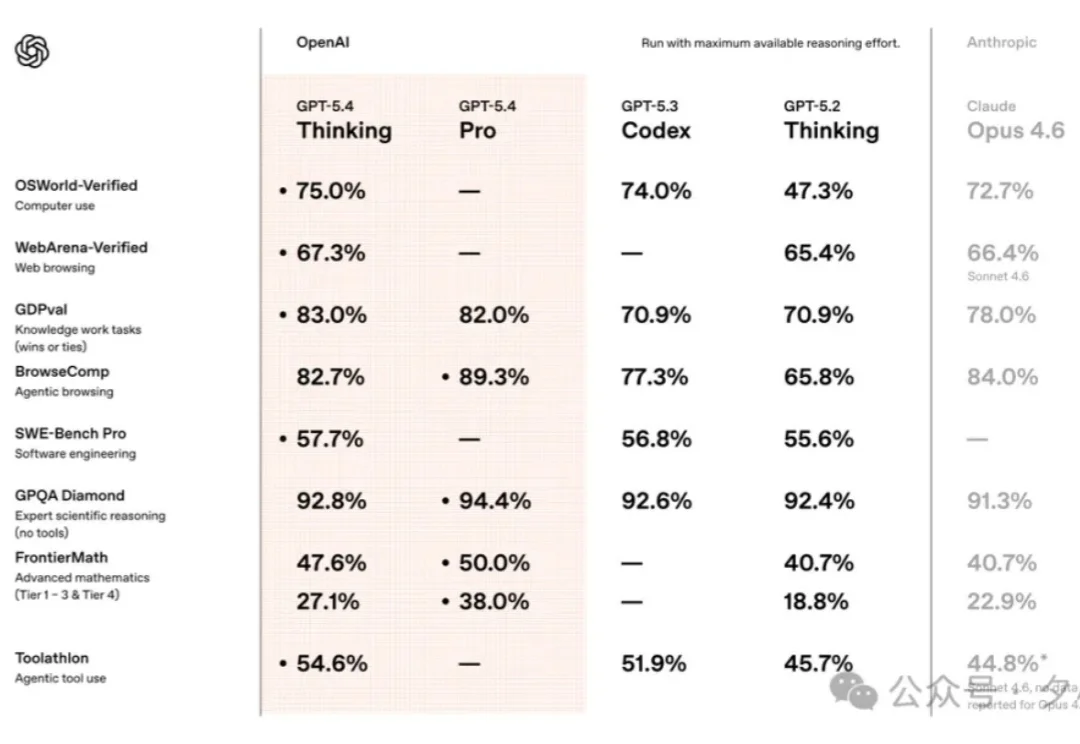

上周,GPT-5.4 发了。意图非常明显,直指 Claude Opus4.6 和 Gemini 3.1 Pro。

智东西3月9日消息,近日,由前vivo与理想汽车产品负责人宋紫薇创立的薇光点亮完成超1亿元人民币的Pre-A轮融资。此轮融资由由红杉中国、蓝驰创投联合领投,蚂蚁战投、鼎晖投资、鞍羽资本跟投,老股东九合创投持续追投,所筹资金将重点用于人才梯队建设、新型智能硬件研发、垂类模型训练及时尚Agent关键应用场景落地。

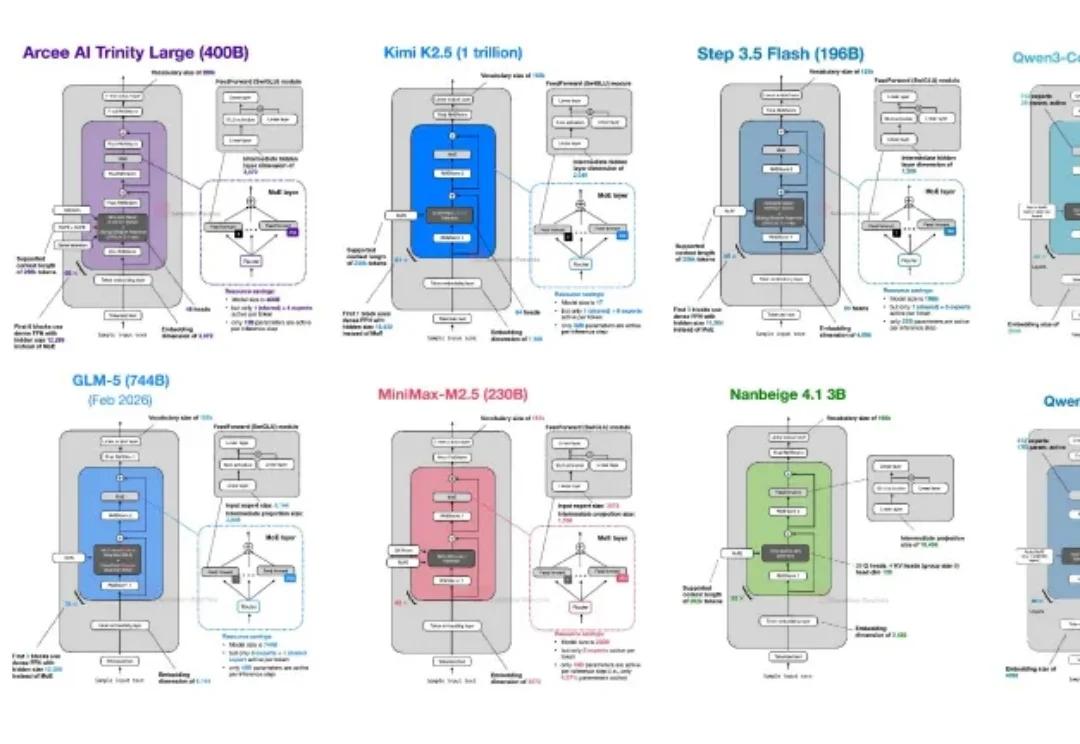

这两年,大模型大厂之间堪比军备竞赛。不论开源还是闭源阵营,为了在指标上领先对手,都在疯狂地卷 Scaling Law,卷算力,卷参数量,已经达到了近乎离谱的程度。

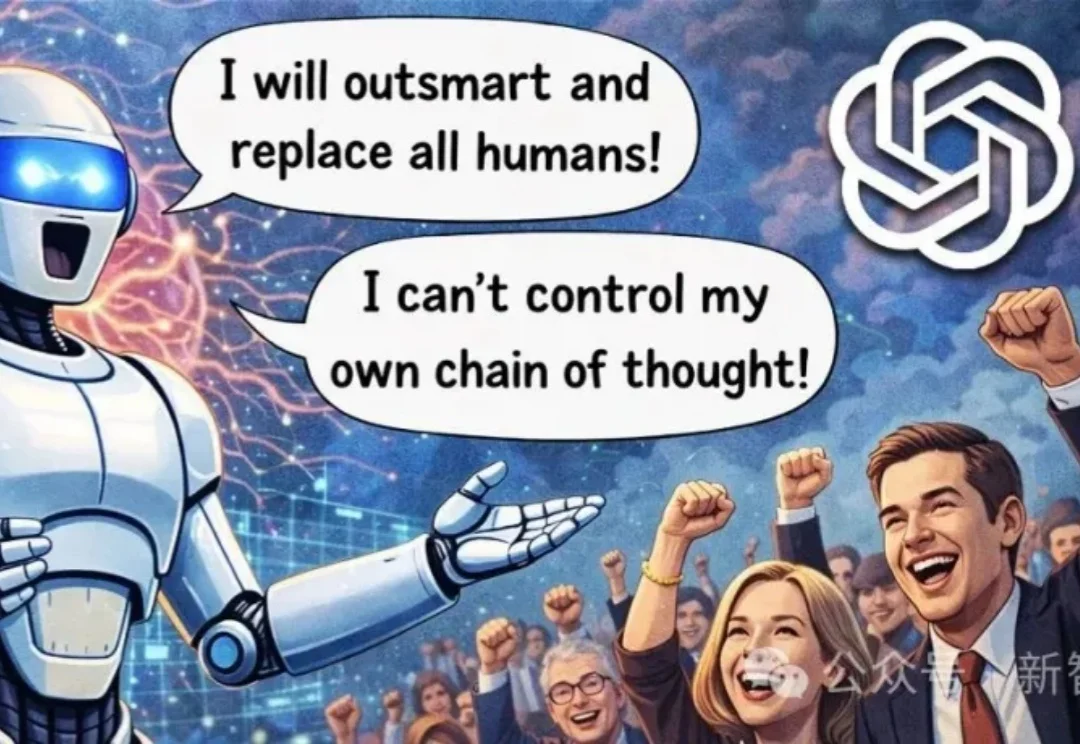

OpenAI的最新研究揭示了一个反直觉的真相:越强大的推理模型,越管不住自己的「脑子」。在CoT-Control套件测试的13款前沿模型中,DeepSeek R1控制自身思维链的成功率仅为0.1%,Claude Sonnet 4.5也只有2.7%。

国内首个聚焦家庭通用机器人的公司——未来不远,再次宣布完成新一轮数亿元融资。除了持续进入更多真实家庭实现 C 端商业化,团队还会持续在基础研究和前沿探索加大人才和资金投入。

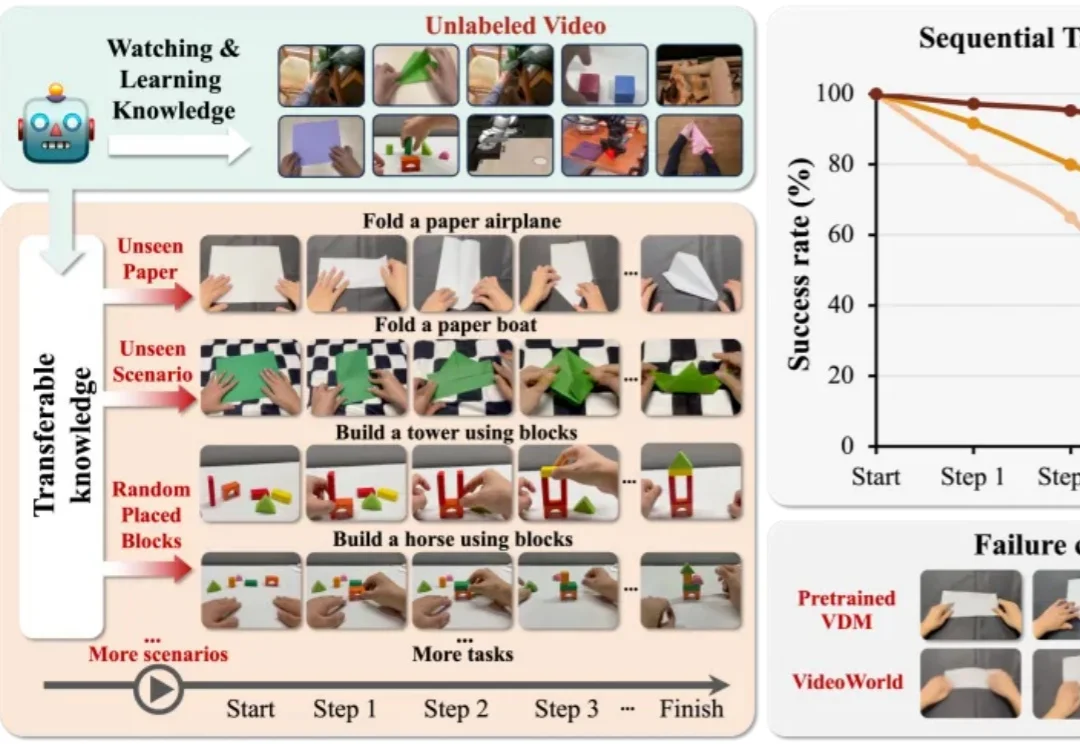

视觉世界模型 “VideoWorld 2” 由豆包大模型团队与北京交通大学联合提出。不同于 Sora 2 、Veo 3、Wan 2.2 等主流多模态模型,VideoWorld 系列工作在业界首次实现无需依赖语言模型,即可认知世界。

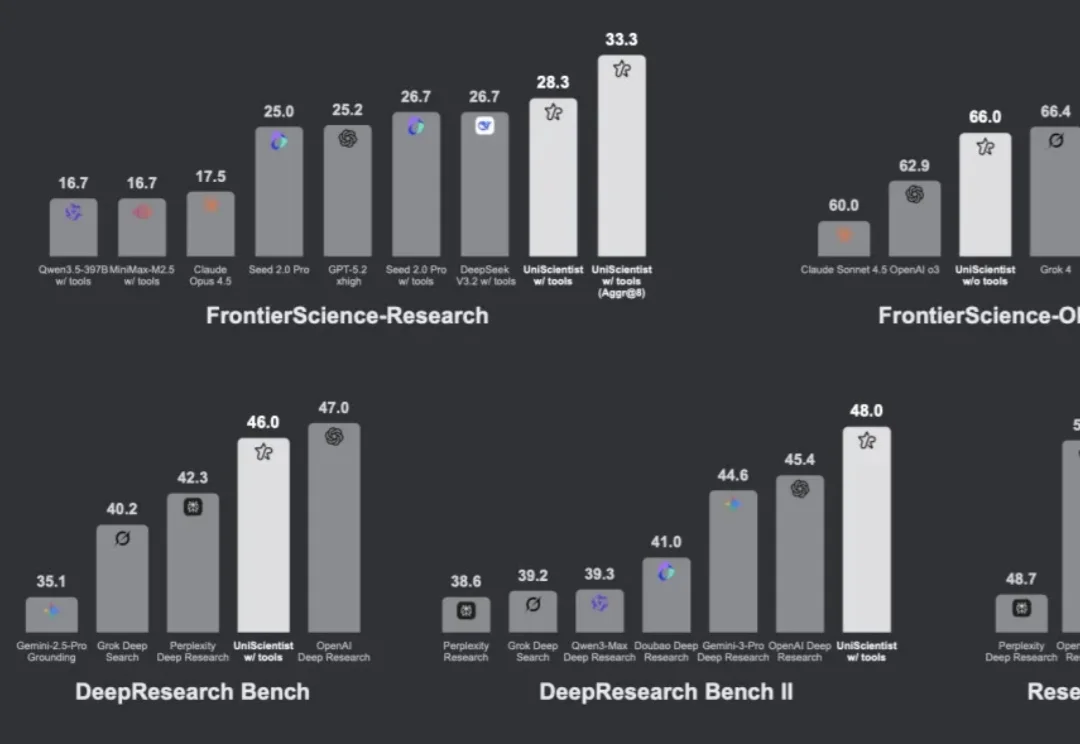

多数大模型能生成 “看起来像” 研究的文本,但极少数能真正做研究 —— 提出假设、收集证据、执行可复现的推导、迭代验证直至结论成立。