硅谷深思:GPT应用迟未爆发,大模型泡沫根源初探

硅谷深思:GPT应用迟未爆发,大模型泡沫根源初探2022年诞生的ChatGPT,已经在相当程度上实现了大模型的Scaling law(尺度定律)和通用能力涌现。

搜索

搜索

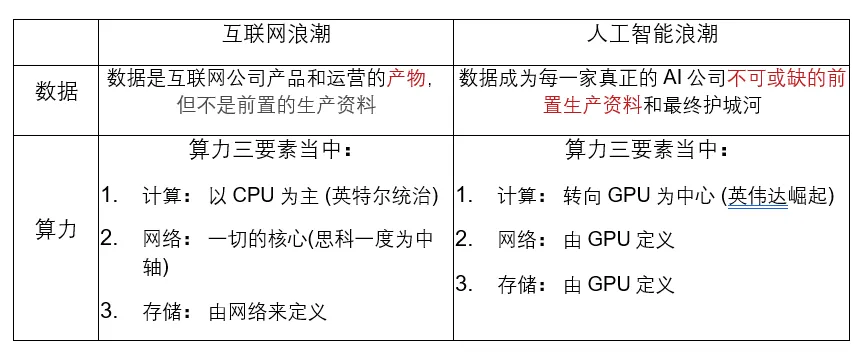

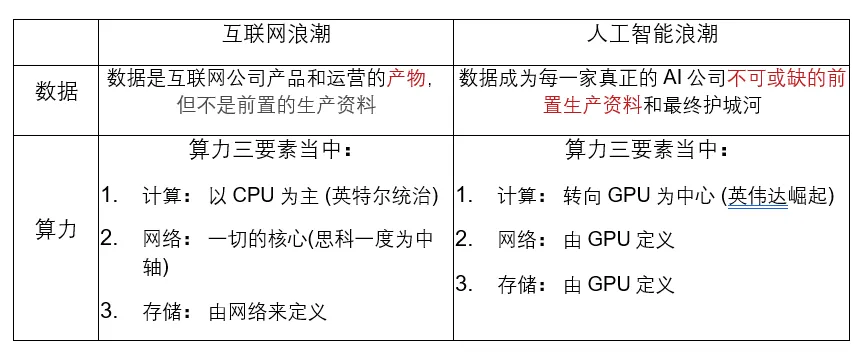

2022年诞生的ChatGPT,已经在相当程度上实现了大模型的Scaling law(尺度定律)和通用能力涌现。

LLM训练速度还可以再飙升20倍!英伟达团队祭出全新架构归一化Transformer(nGPT),上下文越长,训练速度越快,还能维持原有精度。

大型语言模型(LLMs)虽然在适应新任务方面取得了长足进步,但它们仍面临着巨大的计算资源消耗,尤其在复杂领域的表现往往不尽如人意。

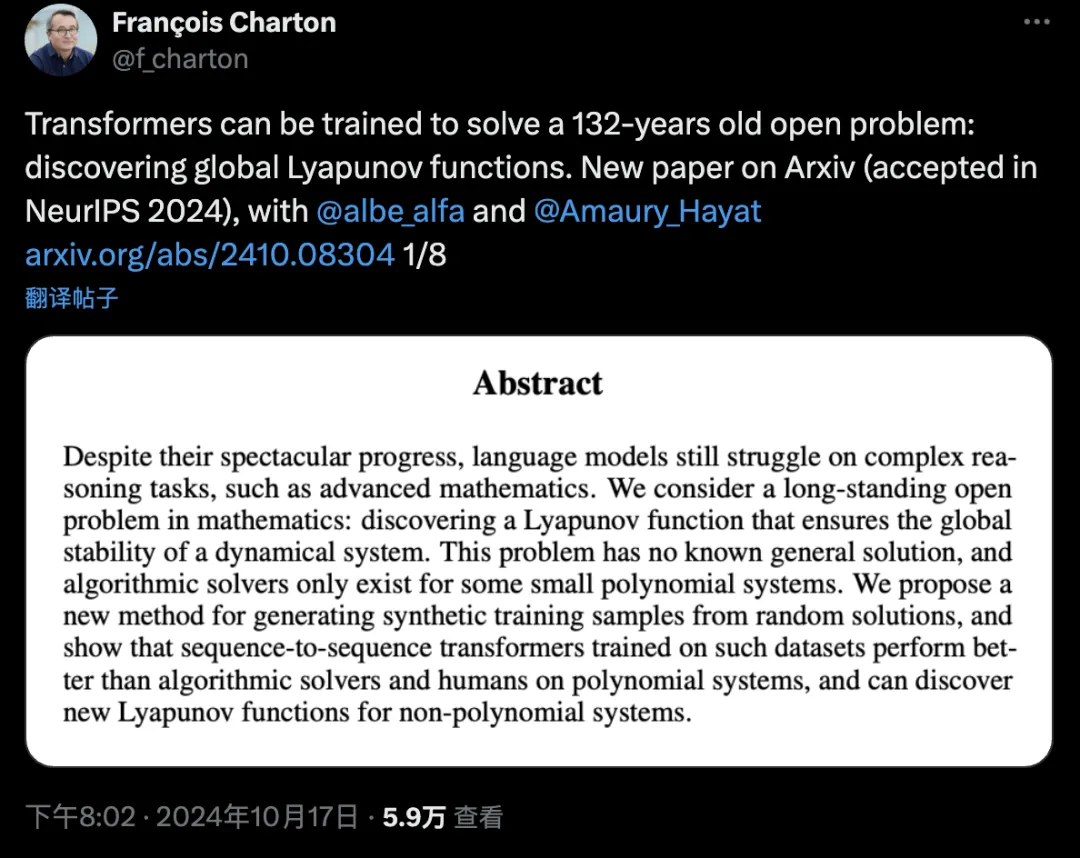

牛顿没解决的问题,AI给你解决了? AI的推理能力一直是研究的焦点。作为最纯粹、要求最高的推理形式之一,能否解决高级的数学问题,无疑是衡量语言模型推理水平的一把尺。

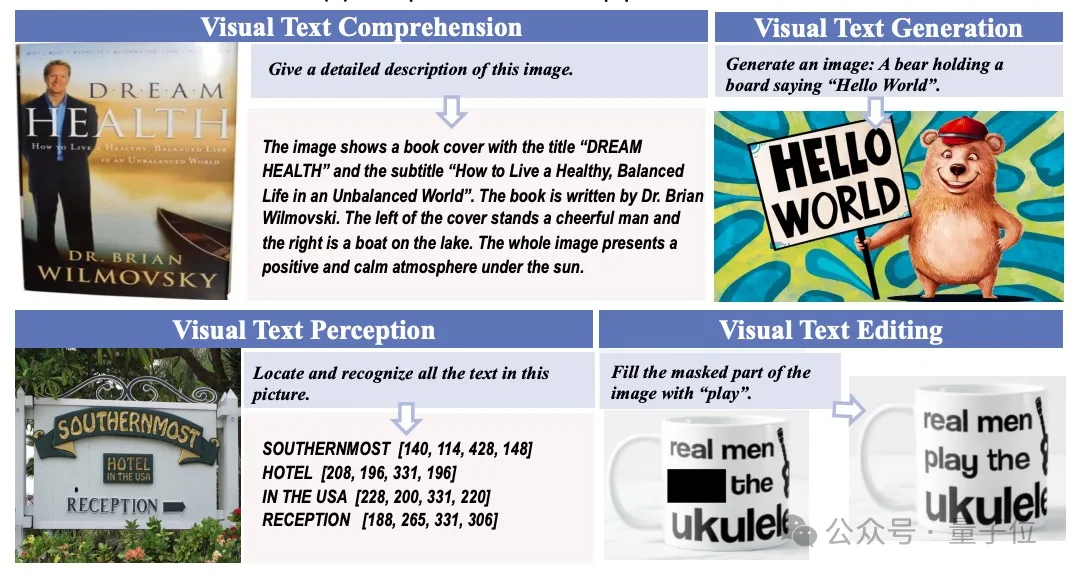

多模态生成新突破,字节&华师团队打造TextHarmony,在单一模型架构中实现模态生成的统一,并入选NeurIPS 2024。

机器人控制和自动驾驶的离线数据损坏问题有解了! 中科大王杰教授团队 (MIRA Lab) 提出了一种变分贝叶斯推断方法,有效地提升了智能决策模型的鲁棒性。

连最积极搞AI的李彦宏,在这件事上也迟疑了。 “百度不碰Sora类的视频生成方向。”李彦宏在近期的2024年Q3总监会上说道。原因在于,10年、20年都可能难以商业化应用。 从OpenAI Sora横空出世,再到6月的快手可灵全量上线,视频生成成为2024年最火热的AI话题。

科技巨头如亚马逊、微软、谷歌和Meta每年在AI相关的投资上花费300亿至600亿美元。

又快又准,即插即用!清华8比特量化Attention,两倍加速于FlashAttention2,各端到端任务均不掉点!

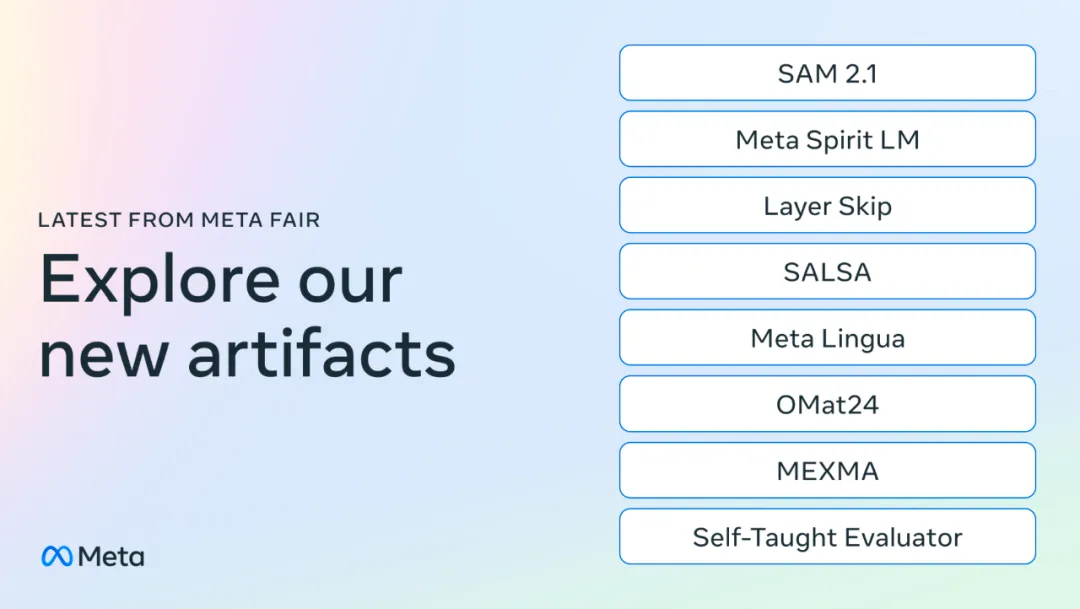

今天,Meta 分享了一系列研究和模型,这些研究和模型支撑 Meta 实现高级机器智能(AMI)目标,同时也致力于开放科学和可复现性。