NeurIPS 2024 | 自我纠错如何使OpenAI o1推理能力大大加强?北大、MIT团队给出理论解释

NeurIPS 2024 | 自我纠错如何使OpenAI o1推理能力大大加强?北大、MIT团队给出理论解释自我纠错(Self Correction)能力,传统上被视为人类特有的特征,正越来越多地在人工智能领域,尤其是大型语言模型(LLMs)中得到广泛应用,最近爆火的OpenAI o1模型[1]和Reflection 70B模型[2]都采取了自我纠正的方法。

搜索

搜索

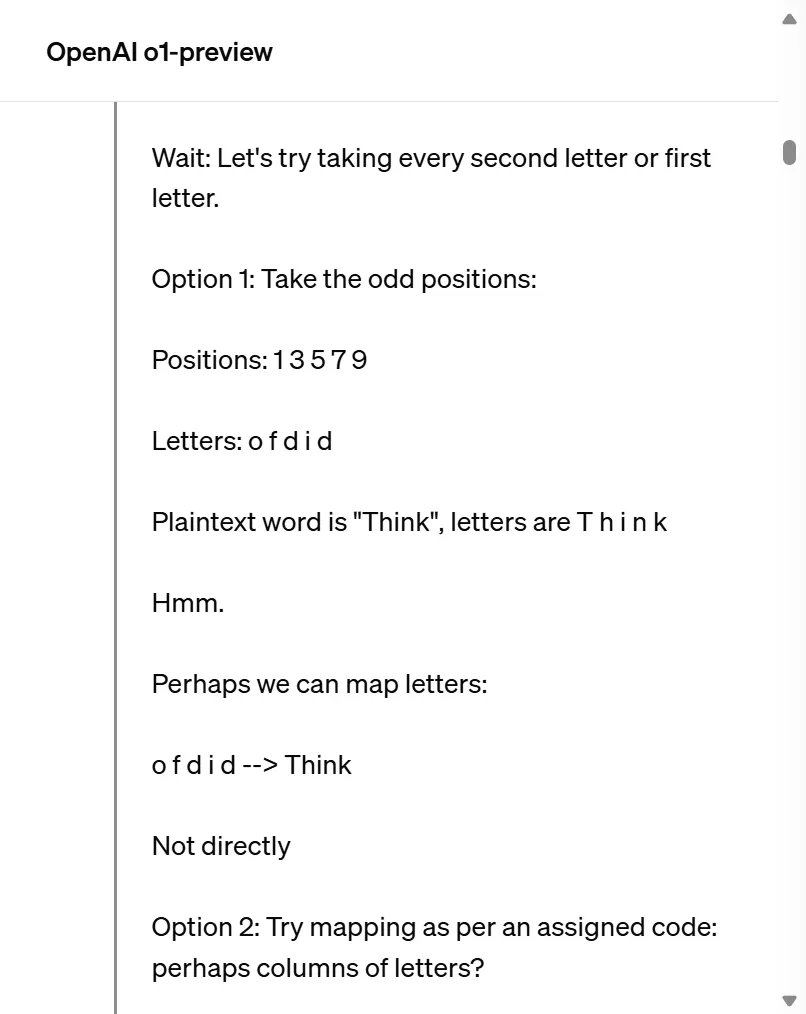

自我纠错(Self Correction)能力,传统上被视为人类特有的特征,正越来越多地在人工智能领域,尤其是大型语言模型(LLMs)中得到广泛应用,最近爆火的OpenAI o1模型[1]和Reflection 70B模型[2]都采取了自我纠正的方法。

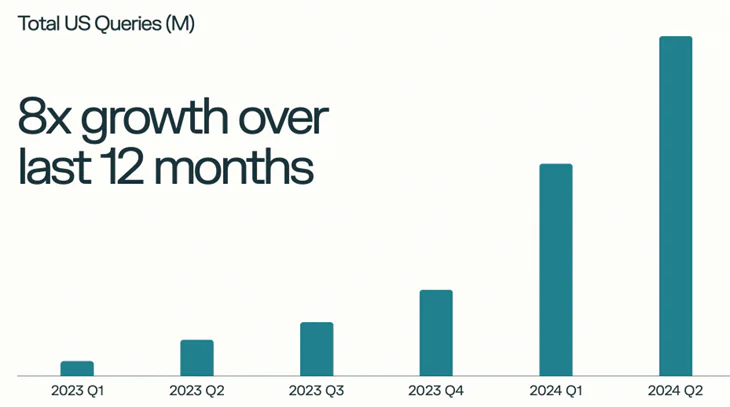

10月28日,The Information报道称,Meta正在研发自己的“AI驱动搜索引擎”,以减少对谷歌和微软Bing搜索的依赖。Meta的搜索,将通过生成式AI对用户输入的关键词或者prompt进行摘要和总结。

作为自然语言处理(NLP)领域的顶级盛会,EMNLP 每年都成为全球研究者的关注焦点。

一款 Z 世代健康应用程序,提供简短、游戏化的方式来提升情绪健康。在全球范围内,约有12亿10至19岁的青少年,其中大约20%面临着心理健康问题。

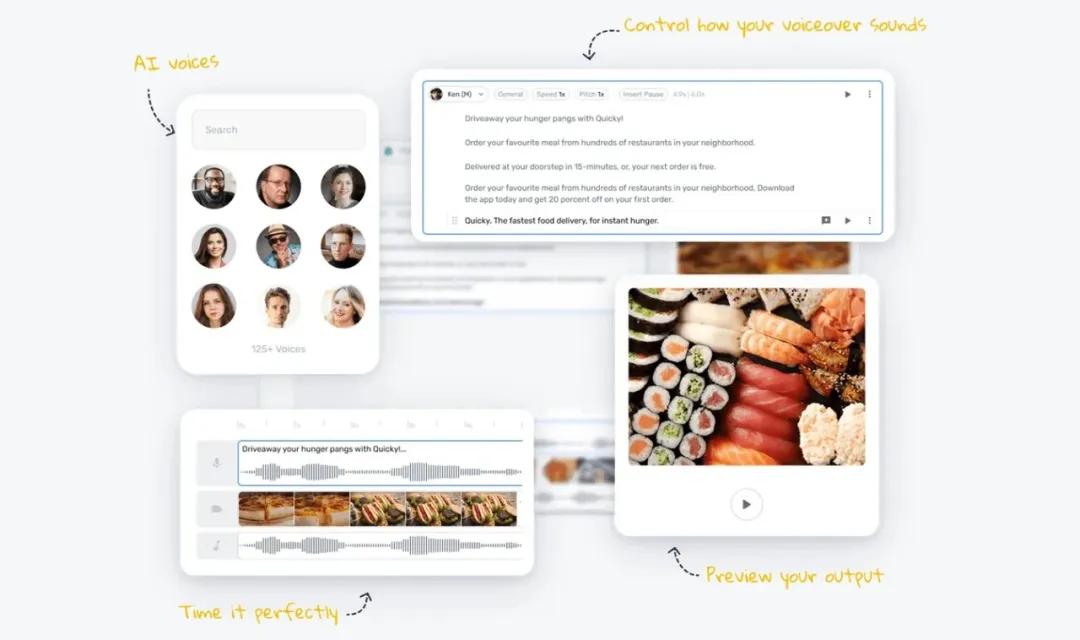

是否曾为项目寻找合适的声音而苦恼?无论是商业广告、播客还是教育视频,合适的声音都能带来截然不同的效果。现在,有了Murf AI的Speech Gen 2,这款先进的AI语音生成器将彻底改变你制作配音的方式。

卷到没边了,122天交付10卡超算,马斯克造Colossus的神奇速度,直接把对手们干懵逼了!OpenAI和微软甚至因此谈崩了。现在,超算大战干脆升级为谍战模式,对手直接派出飞机悬空侦查。

鹅厂全家桶,被大模型打通的进度+1(手动狗头)。 元宝2.0大更新,不仅新增AI应用专属模块,把搜索、阅读、生图都整合到了一起。 甚至连腾讯文档、电脑管家和搜狗输入法都被他们打通了。

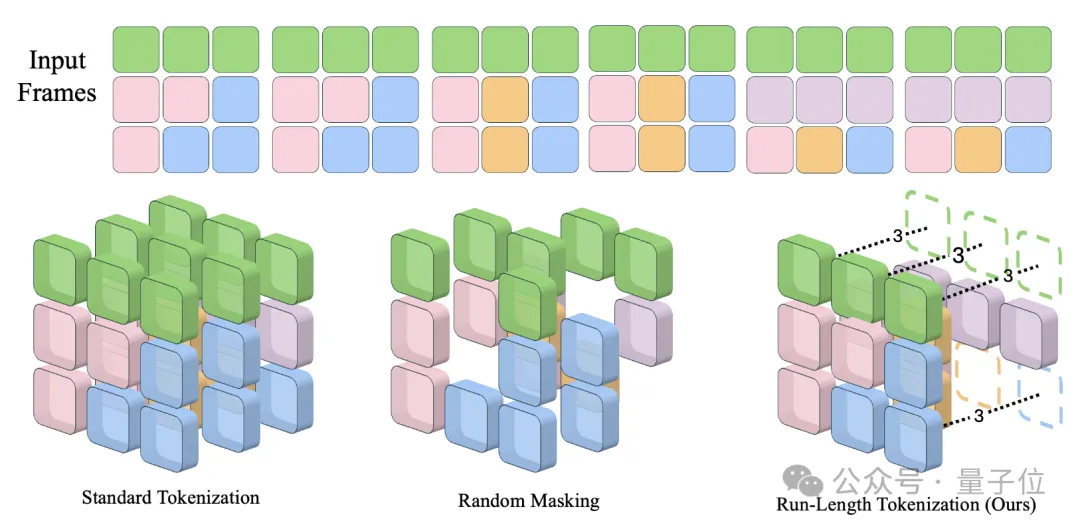

卡内基梅隆大学提出了视频生成模型加速方法Run-Length Tokenization(RLT),被NeurIPS 2024选为Spotlight论文。 在精度几乎没有损失的前提下,RLT可以让模型训练和推理速度双双提升。

本文介绍了来自北京大学王选计算机研究所的王勇涛团队的最新研究成果 VL-SAM。针对开放场景,该篇工作提出了一个基于注意力图提示的免训练开放式目标检测和分割框架 VL-SAM,在无需训练的情况下,取得了良好的开放式 (Open-ended) 目标检测和实例分割结果,论文已被 NeurIPS 2024 录用。

近日,中科大王杰教授团队 (MIRA Lab) 针对离线强化学习数据集存在多类数据损坏这一复杂的实际问题,提出了一种鲁棒的变分贝叶斯推断方法,有效地提升了智能决策模型的鲁棒性,为机器人控制、自动驾驶等领域的鲁棒学习奠定了重要基础。论文发表在 CCF-A 类人工智能顶级会议 Neural Information Processing Systems(NeurIPS 2024)。