Appfigure:用户2024年为AI付费达14亿美元,教育是关键领域之一

Appfigure:用户2024年为AI付费达14亿美元,教育是关键领域之一,最近,Appfigure 通过梳理 1000 款 AI 应用(移动端)总结了一份年度 AI 趋势报告,称AI市场在2024年近20亿美元的规模,重点介绍了AI助理、文生图、AI 陪伴、教育AI等版块。

,最近,Appfigure 通过梳理 1000 款 AI 应用(移动端)总结了一份年度 AI 趋势报告,称AI市场在2024年近20亿美元的规模,重点介绍了AI助理、文生图、AI 陪伴、教育AI等版块。

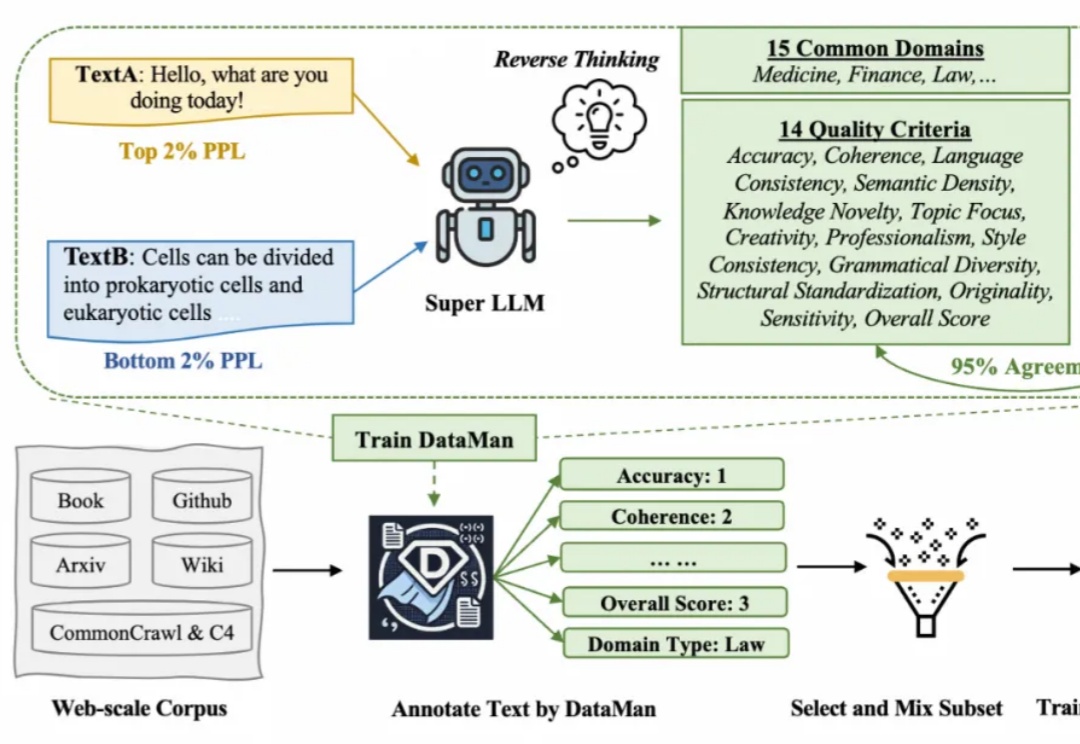

在 Scaling Law 背景下,预训练的数据选择变得越来越重要。然而现有的方法依赖于有限的启发式和人类的直觉,缺乏全面和明确的指导方针。在此背景下,该研究提出了一个数据管理器 DataMan,其可以从 14 个质量评估维度对 15 个常见应用领域的预训练数据进行全面质量评分和领域识别。

一篇题为「New Junior Developers Can’t Actually Code」的博文炸开了锅。资深码农Namanyay对AI工具在软件开发中的广泛应用表达了忧虑——AI正在让新一代开发者跳过基础知识的学习,沦为「复制粘贴(CV)工程师」。这篇文章迅速蹿红,引发了包括马斯克在内的众多业内大佬的热议。

AI组队自主开发时代来临!OpenAI Operator和Replit Agent组队编程,仅在5个提示90分钟内完成了应用程序的开发。

蚂蚁集团开始自研人形机器人产品。

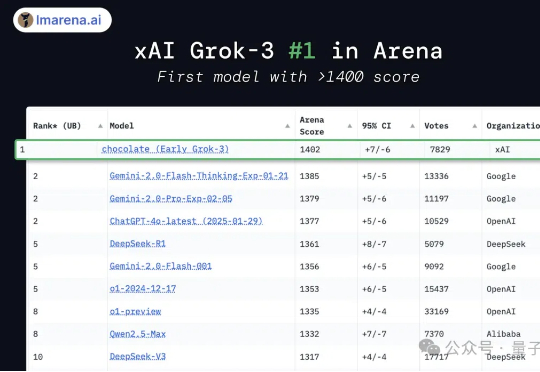

刚刚,马斯克xAI的Grok 3终于亮相(超300万人次围观)!一出道即巅峰,竞技场(lmarena.ai)官方给出了这样的评价:Grok 3是首个突破1400分的模型,并且在所有类别中排名第一。

全球空间智能第一股来了!来自中国,来自杭州。2月14日,空间智能独角兽群核科技正式向港交所递交招股说明书,启动IPO进程,冲击“全球空间智能第一股”,摩根大通、建银国际为联席保荐人。

最新大语言模型推理测试引众议,DeepSeek R1常常在提供错误答案前就“我放弃”了?? Cursor刚刚参与了一项研究,他们基于NPR周日谜题挑战(The Sunday Puzzle),构建了一个包含近600个问题新基准测试。

2月11日,在阿联酋迪拜举办的World Governments Summit 2025峰会上,百度创始人李彦宏与阿联酋AI部长奥马尔·苏丹·奥拉马(Omar Sultan AI Olama)对谈时表示,尽管技术进步、成本降低,但仍需持续投入AI基础设施,以确保处于技术创新的最前沿。

OpenAI感受到不小的危机,甚至开始走营销的“捷径”。近日OpenAI以 60 秒的广告首次亮相超级碗(全国橄榄球联盟的年度冠军赛),这则广告上半年的投放成本约为 1400 万美元。