开源超闭源!通义千问Qwen2发布即爆火,网友:GPT-4o危

开源超闭源!通义千问Qwen2发布即爆火,网友:GPT-4o危开源大模型全球格局,一夜再变。

开源大模型全球格局,一夜再变。

生命科学领域的基础大模型来了!

大模型应用开卷,连一向保守的苹果,都已释放出发展端侧大模型的信号。

与 DeiT 等使用 ViT 和 Vision-Mamba (Vim) 方法的模型相比,ViL 的性能更胜一筹。

检索增强生成 (RAG) 是将检索模型与生成模型结合起来,以提高生成内容的质量和相关性的一种有效的方法。RAG 的核心思想是利用大量文档或知识库来获取相关信息。各种工具支持 RAG,包括 Langchain 和 LlamaIndex。

不久之前,Google DeepMind 发布了 AlphaFold3,再次引发了人们对「AI + 生命科学」的讨论。

如何制服AI吞电兽?

AlphaFold3引起的浪潮下,一个新的抗体设计生成式AI大模型浮出水面。

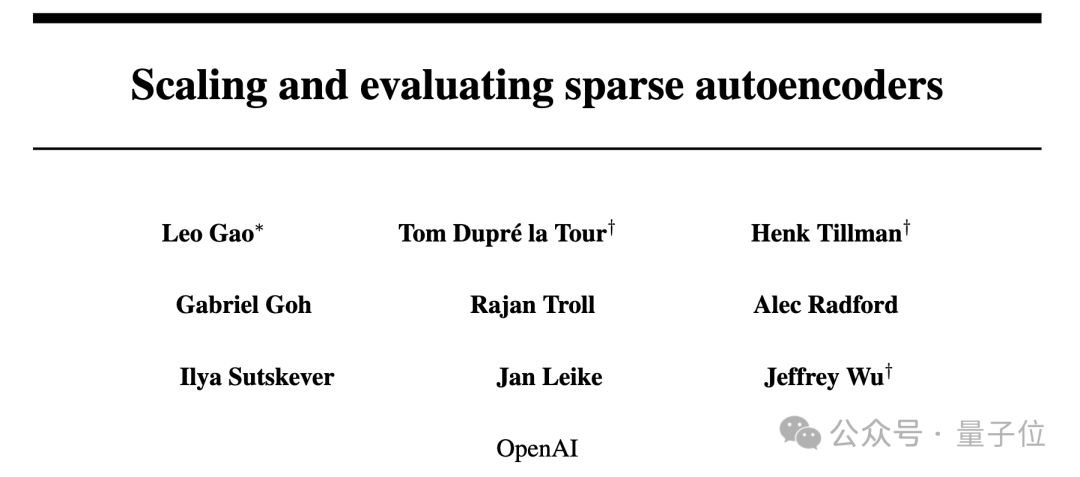

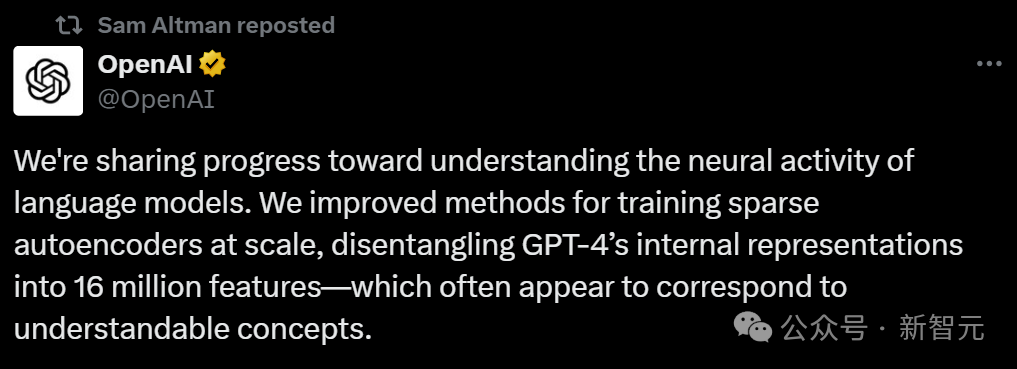

OpenAI研究如何破解GPT-4思维,公开超级对齐团队工作,Ilya Sutskever也在作者名单之列。

今天,OpenAI发布了一篇GPT-4可解释性的论文,似乎是作为前两天员工联名信的回应。网友细看论文才发现,这居然是已经解散的「超级对齐」团队的「最后之作」。

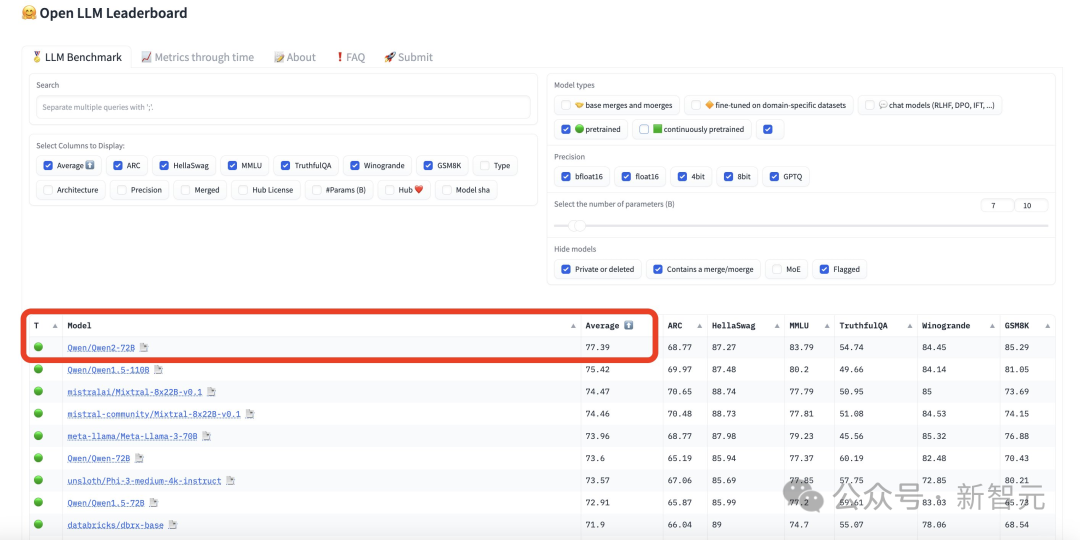

一夜之间,全球最强开源模型再次易主。万众瞩目的Qwen2-72B一出世,火速杀进开源LLM排行榜第一,美国最强开源模型Llama3-70B直接被碾压!全球开发者粉丝狂欢:果然没白等。

不使用外部工具也能让大语言模型(LLMs)实现严谨可信的推理,新国立提出 SymbCoT 推理框架:结合符号化逻辑(Symbolic Logical)表达式与思维链,极大提升推理质量,鲁棒性与可信度。

大模型也可解释了?大模型都在想什么?OpenAI 找到了一种办法,能给 GPT-4 做「扫描」,告诉你 AI 的思路,而且还把这种方法开源了。

怎样才能将可爱又迷人的柯基与柴犬的图像进行区分?

随着大型语言模型(LLM)规模不断增大,其性能也在不断提升。尽管如此,LLM 依然面临着一个关键难题:与人类的价值和意图对齐。在解决这一难题方面,一种强大的技术是根据人类反馈的强化学习(RLHF)。

AI算力资源越发紧张的当下,斯坦福新研究将GPU运行效率再提升一波——

Cloudflare最近宣布AI Gateway已普遍可用。AI Gateway作为管理和扩展生成式AI工作负载的统一接口,让开发人员能够监控和控制AI应用程序。

CRATE-α是一种新型Transformer架构变体,通过设计改进提升了模型的可扩展性、性能和可解释性,CRATE-α-Base在ImageNet分类任务上的性能显著超过了之前最好的CRATE-B模型,其性能会随着模型和数据集规模扩大而继续提升。

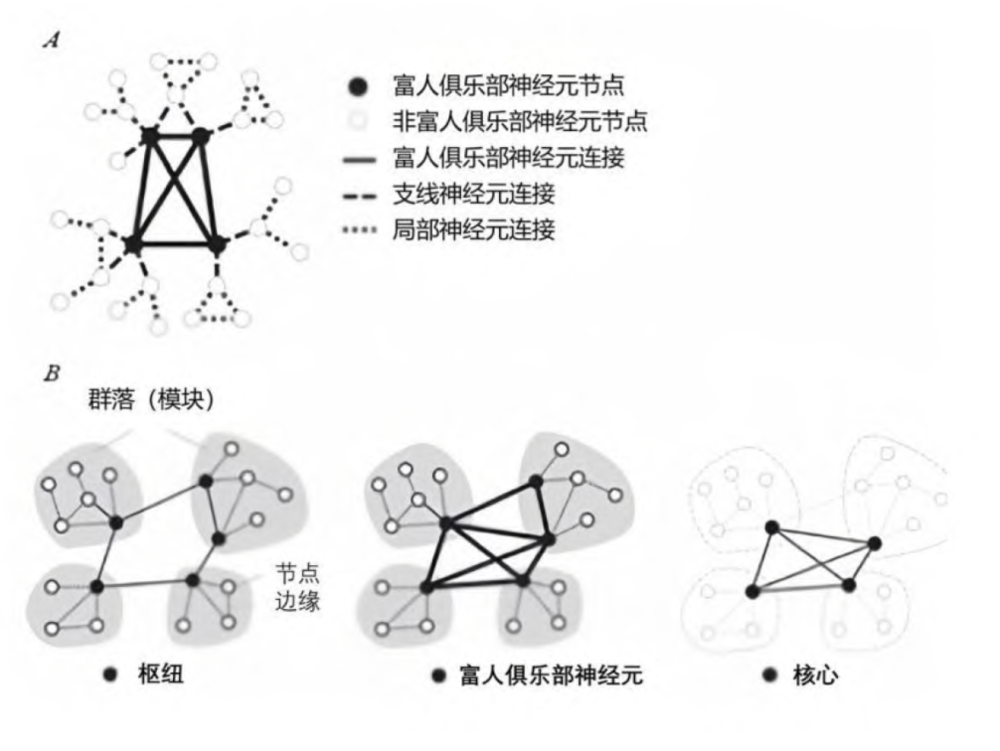

随着近年来人工智能(AI)的惊人进步,AI 是否具有意识以及如何构建有意识的 AI 系统越来越受到学界和公众的关注。要回答这类问题,我们仍然需要或者必须从意识理论中去寻找灵感和答案。

请想象这样一个场景。你坐在公交车上靠窗的位置,这时你的朋友突然对你说:“今天好像有点热”。你会怎么回应?大多数人的做法应该是立即打开窗户,因为他们巧妙地理解了朋友的言外之意:他是在礼貌地请求自己打开窗户,而不是单纯因为无聊而谈论天气。

天津大学与南京大学联合团队在CVPR 2024上发表了LPSNet项目,提出了一种端到端的无透镜成像下的3D人体姿态和形状估计框架,通过多尺度无透镜特征解码器和双头辅助监督机制,直接从编码后的无透镜成像数据中提取特征并提高姿态估计的准确度。

最近,OpenAI的一位前员工发表了一篇165页的超长博文,对AI发展的未来做出了一系列预测。文章的核心观点可以概括成一句话:人类很可能在2027年实现AGI。

本文介绍了KAN网络算法的原理和优势,探讨了其在深度学习领域可能引发的范式转变。 • ⚡ KAN网络将可学习的激活函数从神经元移到了神经网络的边上,表现出更高的准确性和更少的参数量 • ???? KAN在数学和物理领域的实验中展现了卓越性能,提供了一种新的科学发现的路径 • ???? KAN具有更快的神经缩放定律和可解释性,为AI领域带来了新的探索可能性

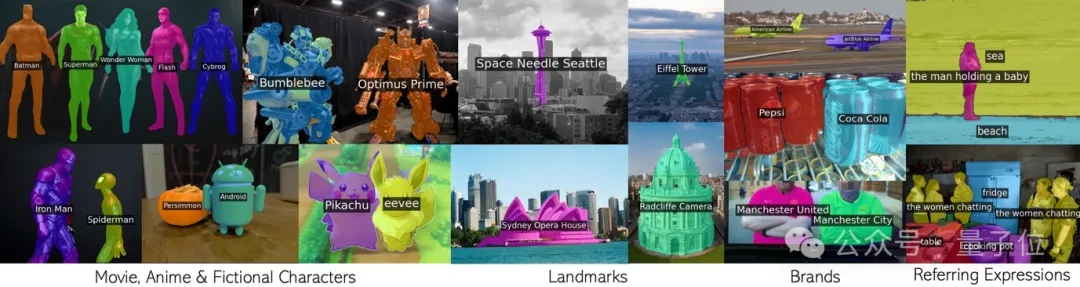

循环调用CLIP,无需额外训练就有效分割无数概念。 包括电影动漫人物,地标,品牌,和普通类别在内的任意短语。

北航的研究团队,用扩散模型“复刻”了一个地球? 在全球的任意位置,模型都能生成多种分辨率的遥感图像,创造出丰富多样的“平行场景”。 而且地形、气候、植被等复杂的地理特征,也全都考虑到了。

过去十年间,基于随机梯度下降(SGD)的深度学习模型在许多领域都取得了极大的成功。与此同时各式各样的 SGD 替代品也如雨后春笋般涌现。在这些众多替代品中,Adam 及其变种最受追捧。无论是 SGD,还是 Adam,亦或是其他优化器,最核心的超参数非 Learning rate 莫属。因此如何调整好 Leanring rate 是炼丹师们从一开始就必学的技能。

OpenAI前员工Leopold Aschenbrenner,之前在超级对齐(Superalignment)部门,可是能和Ilya大佬共事的。

大模型的下一个突破方向是什么?斯坦福大学教授吴恩达的答案是AI智能体工作流。

本文从技术角度介绍推荐系统发展,以及AI大模型在搜索推荐领域落地的前沿技术。

就算是 OpenAI 在舆论场也无法逃过版权保护的呼声。