怎么在DeepSeek里做SEO:一篇文章讲透生成引擎优化GEO

怎么在DeepSeek里做SEO:一篇文章讲透生成引擎优化GEO通过Deepseek、ChatGPT、Gemini等大模型说出来的话,不少没有辨别能力的小伙伴就会默认是公道与正确的。其实是未必。1.Deepseek、ChatGPT、Gemini等联网搜索的结果与规则还在完善;

通过Deepseek、ChatGPT、Gemini等大模型说出来的话,不少没有辨别能力的小伙伴就会默认是公道与正确的。其实是未必。1.Deepseek、ChatGPT、Gemini等联网搜索的结果与规则还在完善;

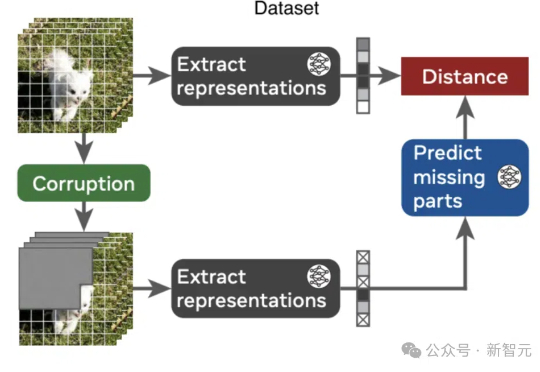

AI如何理解物理世界?视频联合嵌入预测架构V-JEPA带来新突破,无需硬编码核心知识,在自监督预训练中展现出对直观物理的理解,超越了基于像素的预测模型和多模态LLM。

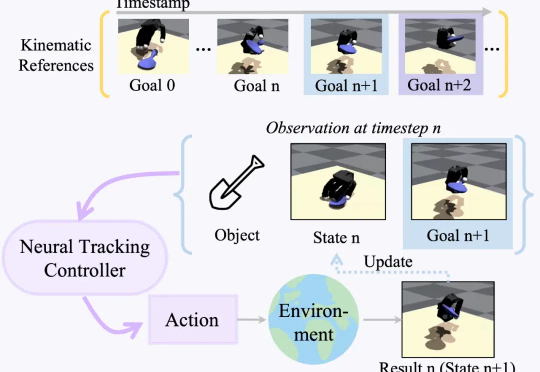

现实世界的机器人距离科幻小说里的机器人世界还有多远?通用灵巧操控何时才能实现?朝着这一伟大的目标,研究通用灵巧操控轨迹跟踪的 DexTrack 便应用而生。

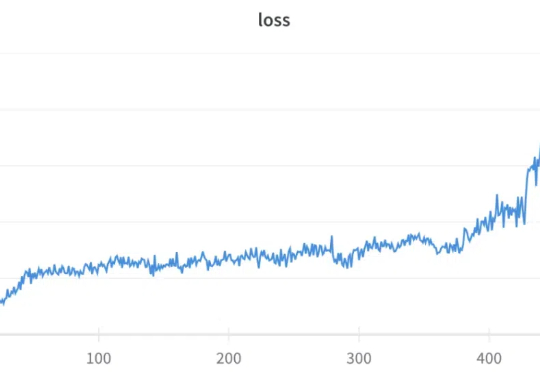

GRPO(Group Relative Policy Optimization)是 DeepSeek-R1 成功的基础技术之一,我们之前也多次报道过该技术,比如《DeepSeek 用的 GRPO 占用大量内存?有人给出了些破解方法》。

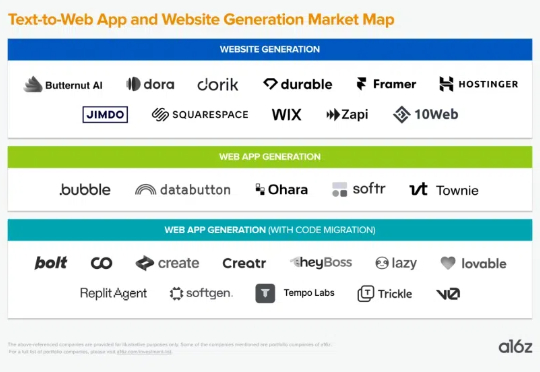

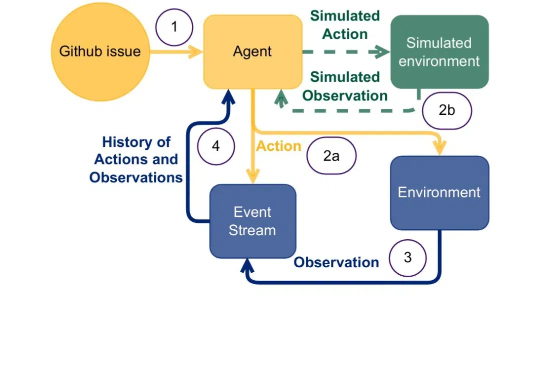

从本质上讲,LLM会根据用户从UI的输入生成代码示例。然后,生成的代码会通过中间件逻辑进行处理,根据逻辑跟踪文件、代码更改和第三方API调用。

近年来,大型语言模型(LLMs)在代码相关的任务上展现了惊人的表现,各种代码大模型层出不穷。这些成功的案例表明,在大规模代码数据上进行预训练可以显著提升模型的核心编程能力。

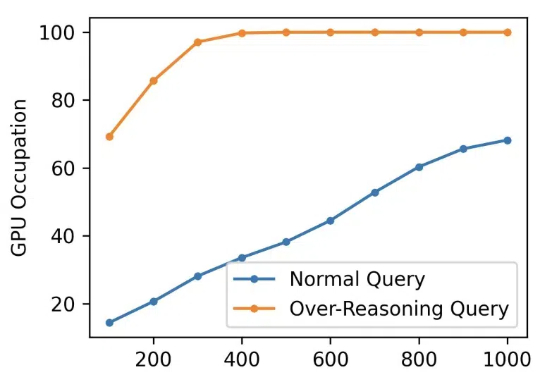

原来,大型推理模型(Large Reasoning Model,LRM)像人一样,在「用脑过度」也会崩溃,进而行动能力下降。

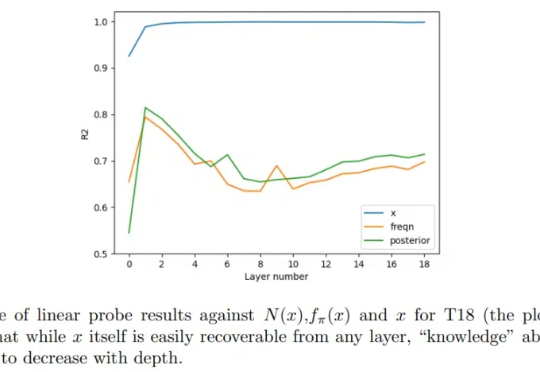

Transformer 很成功,更一般而言,我们甚至可以将(仅编码器)Transformer 视为学习可交换数据的通用引擎。由于大多数经典的统计学任务都是基于独立同分布(iid)采用假设构建的,因此很自然可以尝试将 Transformer 用于它们。

这份提示词有很多哲学性思考,很多表达让我看到背后的设计者把claude当成一个人去设计。 我猜,应该是Amanda Askell(Anthropic负责alignment和character design,是学哲学的一位女生,也是我的榜样) 主要设计的。

在大语言模型 (LLM) 的研究中,与以 Chain-of-Thought 为代表的逻辑思维能力相比,LLM 中同等重要的 Leap-of-Thought 能力,也称为创造力,目前的讨论和分析仍然较少。这可能会严重阻碍 LLM 在创造力上的发展。造成这种困局的一个主要原因是,面对「创造力」,我们很难构建一个合适且自动化的评估流程。

当百亿千亿参数的大模型霸占着科技头条,“若无必要,勿增实体”这把古老“剃刀”是否依旧闪耀?复杂性与简洁性真的是对立的吗?本文将回溯历史长河,探寻一个古老哲学原则与现代科技之间的微妙关联。在这个过程中,我们或许能够发现,复杂与简洁之间隐藏着怎样的辩证关系。

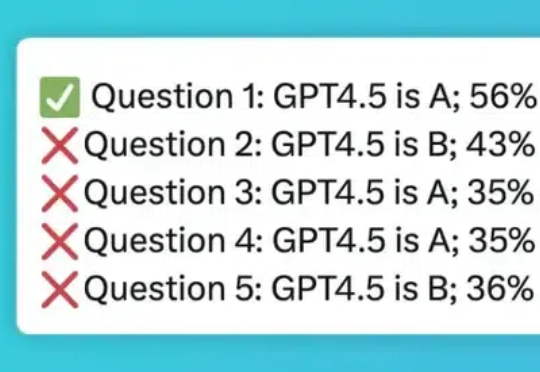

我先给大家道个歉,上一篇讲的不太对:《GPT-4.5 一手实测:垃圾》,是我喷得保守了,觉得 GPT-4.5 只是贵&慢,但模型总归是素质在线。 没想到,经过实际数万轮实测:GPT-4.5 不如 GPT-4

只要一句话,就能让DeepSeek陷入无限思考,根本停不下来?

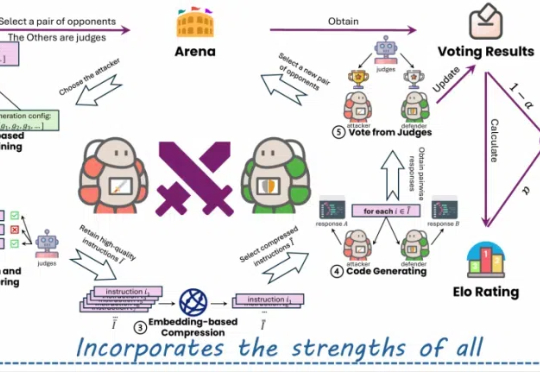

单目深度估计新成果来了!西湖大学AGI实验室等提出了一种创新性的蒸馏算法,成功整合了多个开源单目深度估计模型的优势。在仅使用2万张无标签数据的情况下,该方法显著提升了估计精度,并刷新了单目深度估计的最新SOTA性能。

近日,来自哥大的研究人员开发出了一种新AI系统,让机器人通过普通摄像头和深度神经网络实现自我建模、运动规划和自我修复,突破了传统机器人依赖工程师调整的局限,使机器人能像人类一样自主学习和适应环境变化,为具身智能发展带来新范式。

STP(自博弈定理证明器)让模型扮演「猜想者」和「证明者」,互相提供训练信号,在有限的数据下实现了无限自我改进,在Lean和Isabelle验证器上的表现显著优于现有方法,证明成功率翻倍,并在多个基准测试中达到最先进的性能。

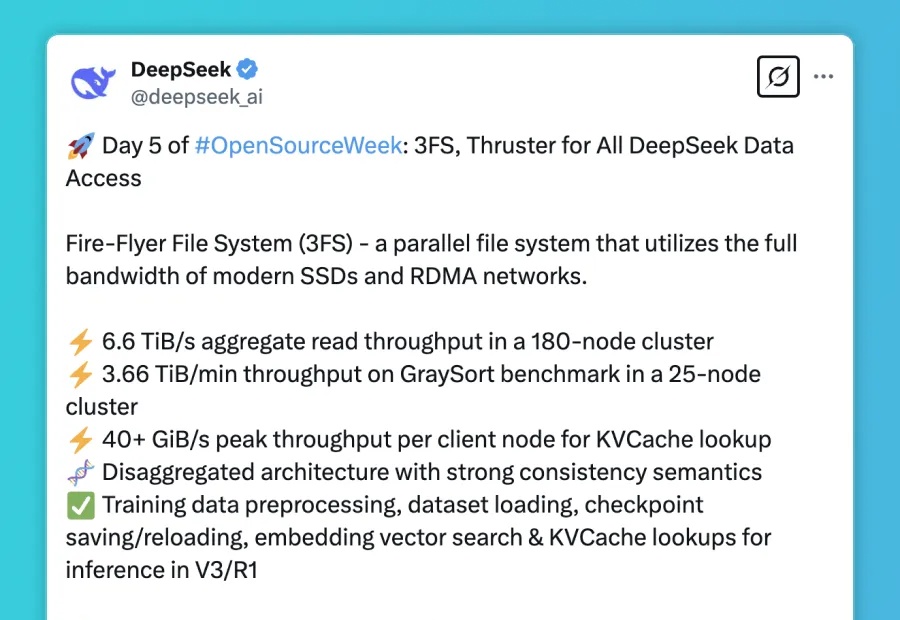

DeepSeek最后一天,送上了3FS文件并行系统,以及数据处理框架Smallpond。五天开源连更,终于画上了完美的句号。

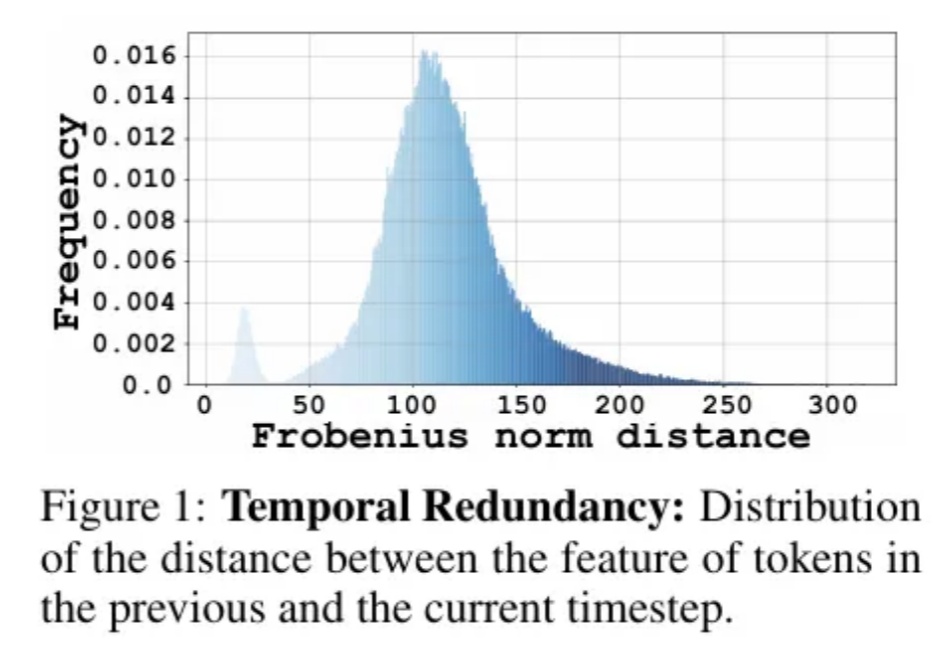

Diffusion Transformer模型模型通过token粒度的缓存方法,实现了图像和视频生成模型上无需训练的两倍以上的加速。

随着 AI 能力的提升,一个常见的话题便是基准不够用了——一个新出现的基准用不了多久时间就会饱和,比如 Replit CEO Amjad Masad 就预计 2023 年 10 月提出的编程基准 SWE-bench 将在 2027 年饱和。

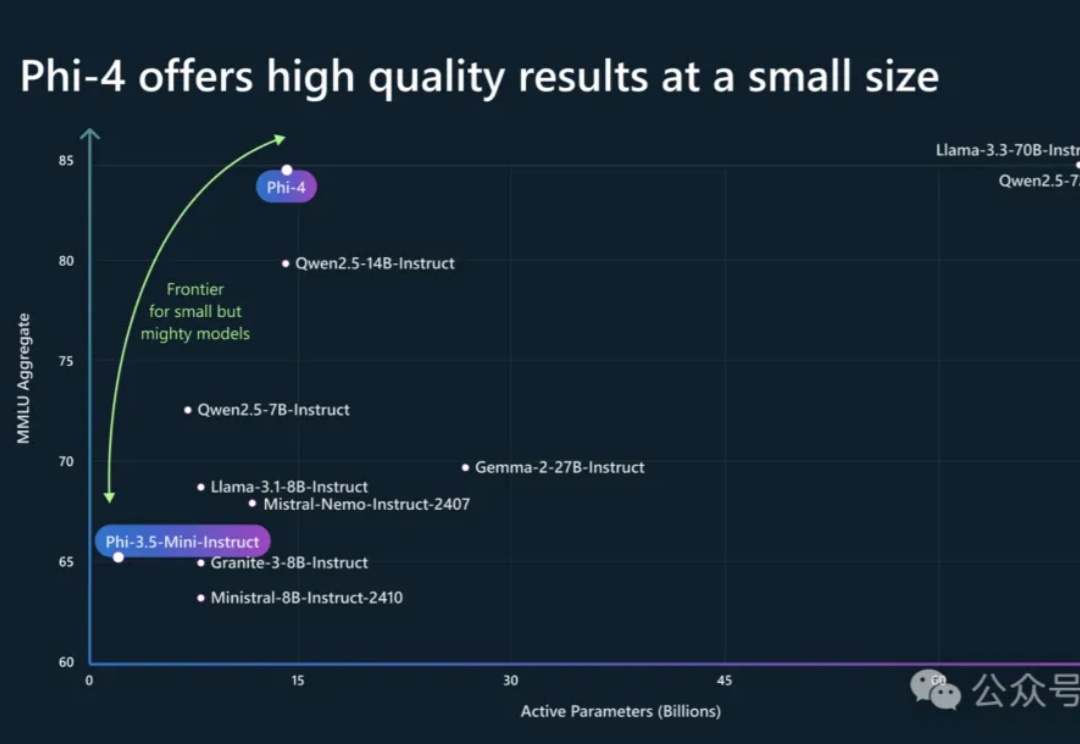

Phi-4系列模型上新了!56亿参数Phi-4-multimodal集语音、视觉、文本多模态于一体,读图推理性能碾压GPT-4o;另一款38亿参数Phi-4-mini在推理、数学、编程等任务中超越了参数更大的LLM,支持128K token上下文。

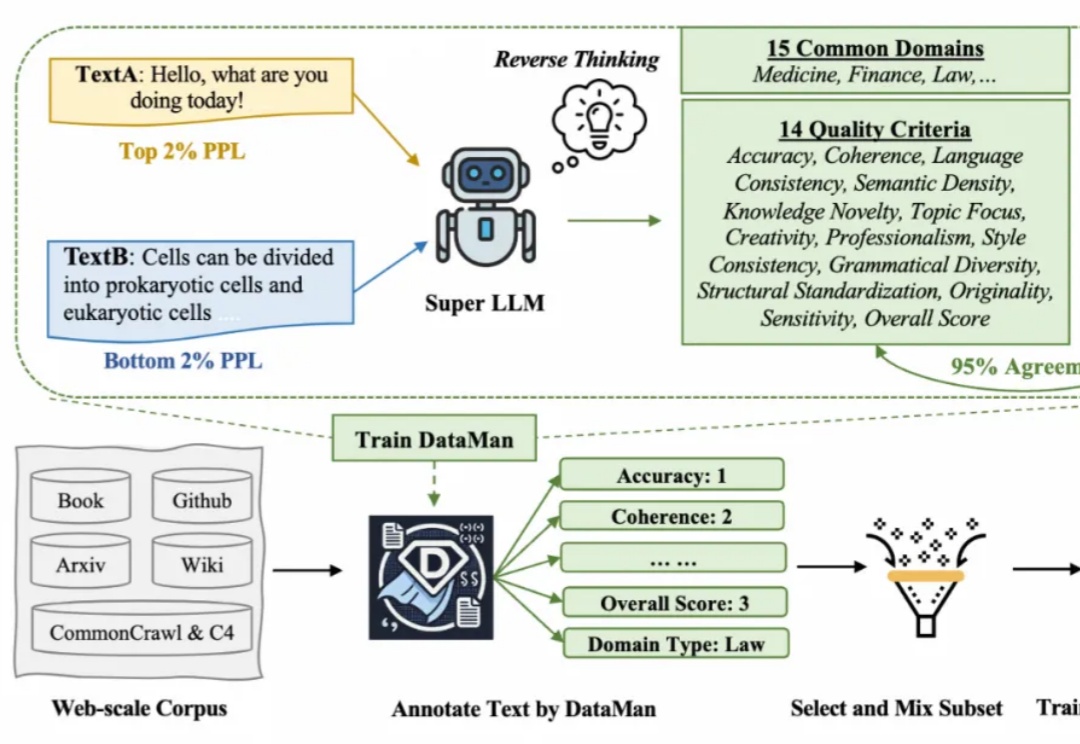

在 Scaling Law 背景下,预训练的数据选择变得越来越重要。然而现有的方法依赖于有限的启发式和人类的直觉,缺乏全面和明确的指导方针。在此背景下,该研究提出了一个数据管理器 DataMan,其可以从 14 个质量评估维度对 15 个常见应用领域的预训练数据进行全面质量评分和领域识别。

DeepSeek开源周的最后一天,迎来的是支撑其V3/R1模型全生命周期数据访问需求的核心基础设施 — Fire-Flyer File System(3FS) 和构建于其上的Smallpond数据处理框架。

单个模型的优缺点也能分析

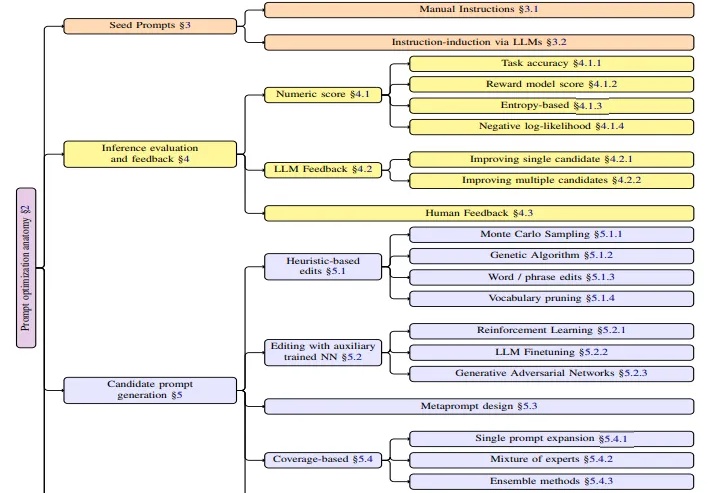

本文是对亚马逊AWS研究团队最新发表的APO(自动提示词优化)技术综述的深度解读。该研究由Kiran Ramnath、Kang Zhou等21位来自AWS的资深研究者共同完成,团队成员来自不同技术背景,涵盖了机器学习、自然语言处理、系统优化等多个专业领域。

这是智能体平台扣子官方整理的AI应用的相关数据,该报告可以让大家更好的了解用户在智能体方面的创建情况,同时也可以了解智能体平台本身的用户情况,更清楚的分析智能体商业的前景。

动辄百亿、千亿参数的大模型正在一路狂奔,但「小而美」的模型也在闪闪发光。

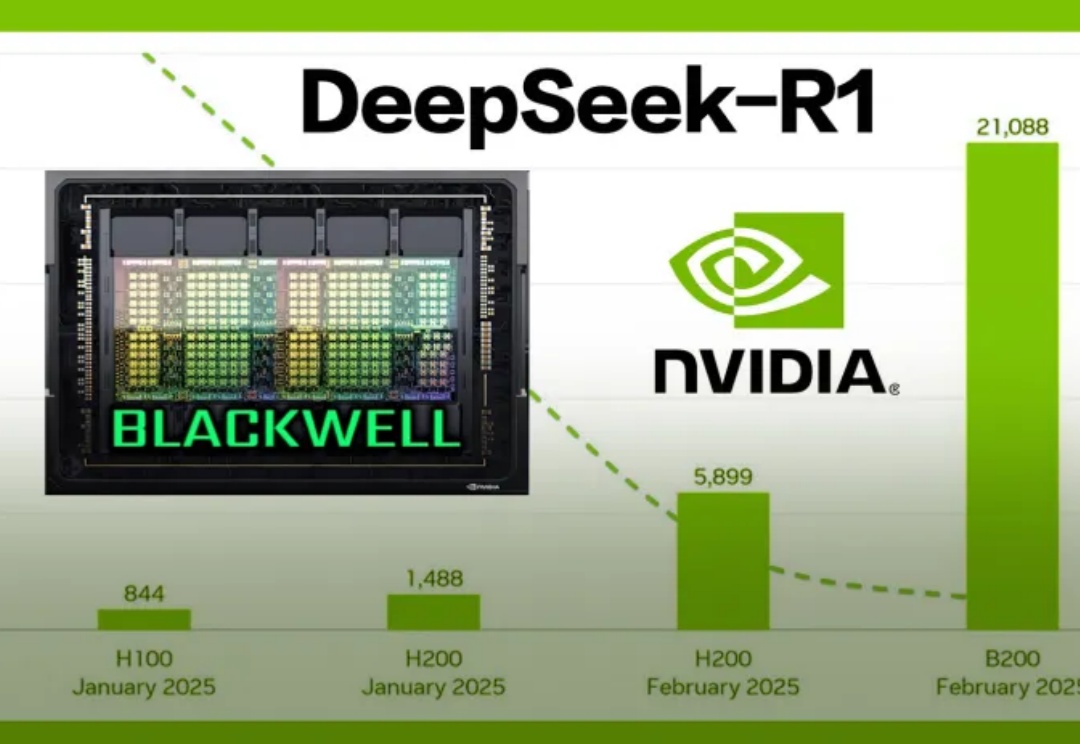

最近,英伟达开源了首个在Blackwell架构上优化的DeepSeek-R1,实现了推理速度提升25倍,和每token成本降低20倍的惊人成果。同时,DeepSeek连续开源多个英伟达GPU优化项目,共同探索模型性能极限。

斯坦福和普林斯顿研究者发现,DeepSeek-R1生成的自定义CUDA内核,完爆了o1和Claude 3.5 Sonnet,拿下总排名第一。虽然目前只能在不到20%任务上超越PyTorch Eager基线,但GPU编程加速自动化的按钮,已经被按下!

哈尔滨工业大学团队提出HEROS-GAN技术,通过生成式深度学习将低成本加速度计信号转化为高精度信号,突破其精度与量程瓶颈。该技术利用最优传输监督和拉普拉斯能量调制,使0.5美元的传感器达到200美元高端设备的性能,为工业、医疗等领域应用带来变革。

AI引用正确率仅有4.2- 18.5%,用Deep Research就提高了引用正确率吗?似乎用Think&Cite框架的SG-MCTS和过程奖励机制PRM可以解决引用问题,生成可信内容。