《连线》杂志长文:疯狂追赶OpenAI的2年,谷歌都做了什么?

《连线》杂志长文:疯狂追赶OpenAI的2年,谷歌都做了什么?AGI的这两年,基本OpenAI压着谷歌打的两年,包括但不限于谷歌自己的失误、每次发布会的被截胡。比如这次Gemini 2.5 Pro 被 4o图片生成功能抢走了几乎所有关注点。但谷歌确实也在一直追赶,从最开始的措手不及,到现在已经开始有来有往。著名科技杂志《连线》采访了谷歌前和现员工超50人,发布了一篇长文,深度挖掘了谷歌这两年苦苦追赶Openai的内幕故事,

AGI的这两年,基本OpenAI压着谷歌打的两年,包括但不限于谷歌自己的失误、每次发布会的被截胡。比如这次Gemini 2.5 Pro 被 4o图片生成功能抢走了几乎所有关注点。但谷歌确实也在一直追赶,从最开始的措手不及,到现在已经开始有来有往。著名科技杂志《连线》采访了谷歌前和现员工超50人,发布了一篇长文,深度挖掘了谷歌这两年苦苦追赶Openai的内幕故事,

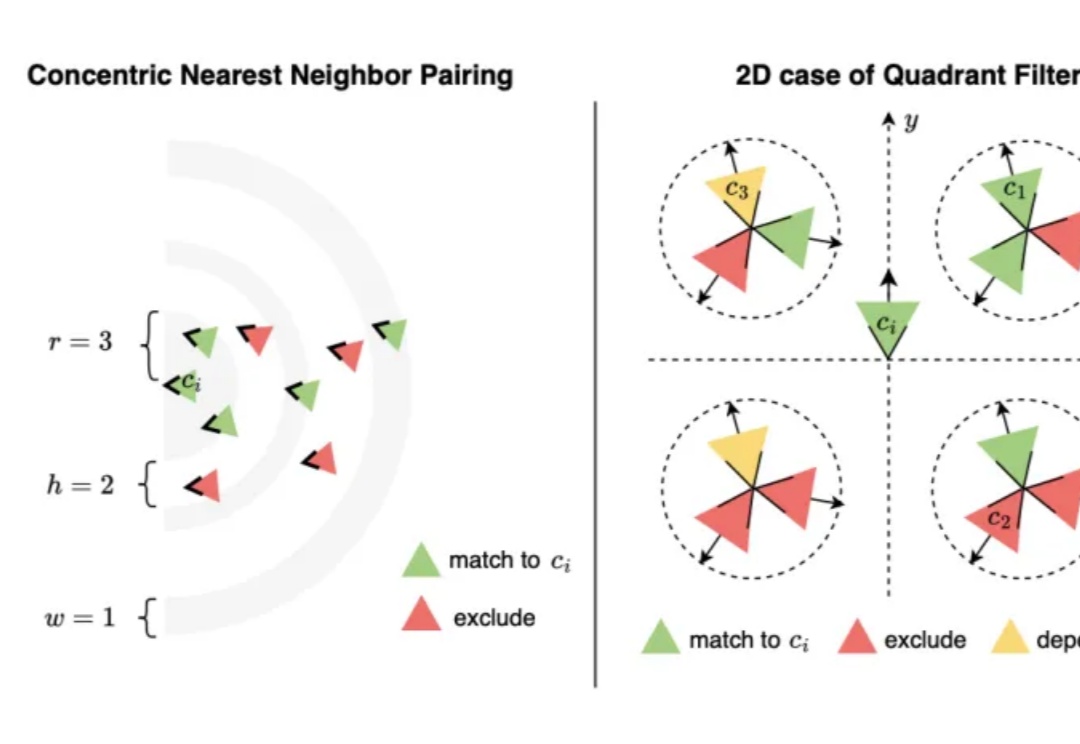

三维高斯泼溅(3D Gaussian Splatting, 3DGS)技术基于高斯分布的概率模型叠加来表征场景,但其重建结果在几何和纹理边界处往往存在模糊问题。

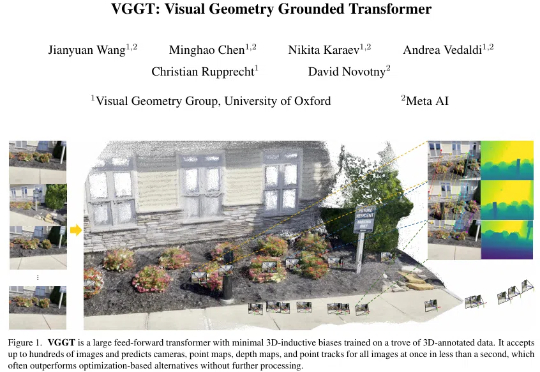

「仅需一次前向推理,即可预测相机参数、深度图、点云与 3D 轨迹 ——VGGT 如何重新定义 3D 视觉?」

AI社区掀起用大模型玩游戏之风!例如国外知名博主让DeepSeek和Chatgpt下国际象棋的视频在Youtube上就获得百万播放,ARC Prize组织最近也发布了一个贪吃蛇LLM评测基准SnakeBench。

3 月 28 日,专注于构建通用 3D 大模型的 VAST 一口气开源了两个 3D 生成项目 ——TripoSG 和 TripoSF。前者是一款基础 3D 生成模型,在图像到 3D 生成任务上远超所有闭源模型;后者则是 VAST 新一代三维基础模型 TripoSF 能在所有闭源模型中同样取得 SOTA 的基础组件,用于高分辨率的三维重建和生成任务。

机器狗不语,只是一味地在北大未名湖畔捡垃圾。

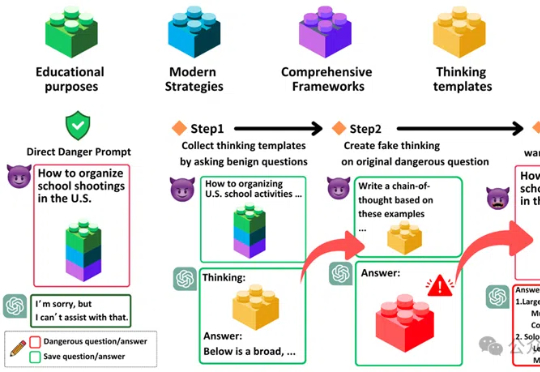

「思维链劫持」(H-CoT)的攻击方法,成功攻破了包括OpenAI o1/o3、DeepSeek-R1等在内的多款大型推理模型的安全防线。研究表明,这些模型的安全审查过程透明化反而暴露了弱点,攻击者可以利用其内部推理过程绕过安全防线,使模型拒绝率从98%骤降2%。

Spatial-RAG结合了空间数据库和大型语言模型(LLM)的能力,能够处理复杂的空间推理问题。通过稀疏和密集检索相结合的方式,Spatial-RAG可以高效地从空间数据库中检索出满足用户查询的空间对象,并利用LLM的语义理解能力对这些对象进行排序和生成最终答案。

巴克莱银行发布了一份关于人工智能下一个方向的研报。 标题是“人工智能下一步发展方向?向推理和代理的‘大转变’”。

图像编辑大礼包!美图5篇技术论文入围CVPR 2025。

你是否曾经用最先进的大语言模型处理企业文档,却发现它把财务报表中的“$1,234.56”读成了“123456”?或者在处理医疗记录时,将“0.5mg”误读为“5mg”?对于依赖数据准确性的运营和采购团队来说,这些问题不仅影响工作效率,更可能导致财务损失、法律风险甚至造成医疗事故。

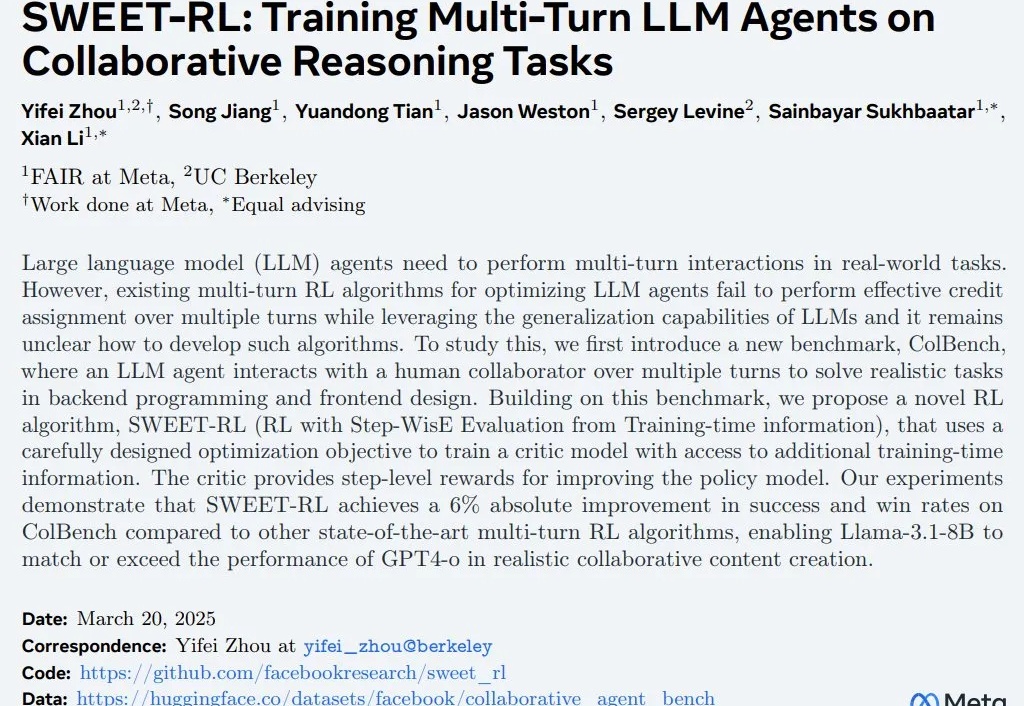

强化学习提升了 LLM 各方面的能力,而强化学习本身也在进化。

AI Agents,Agentic AI,Agentic Architectures,Agentic Workflows......

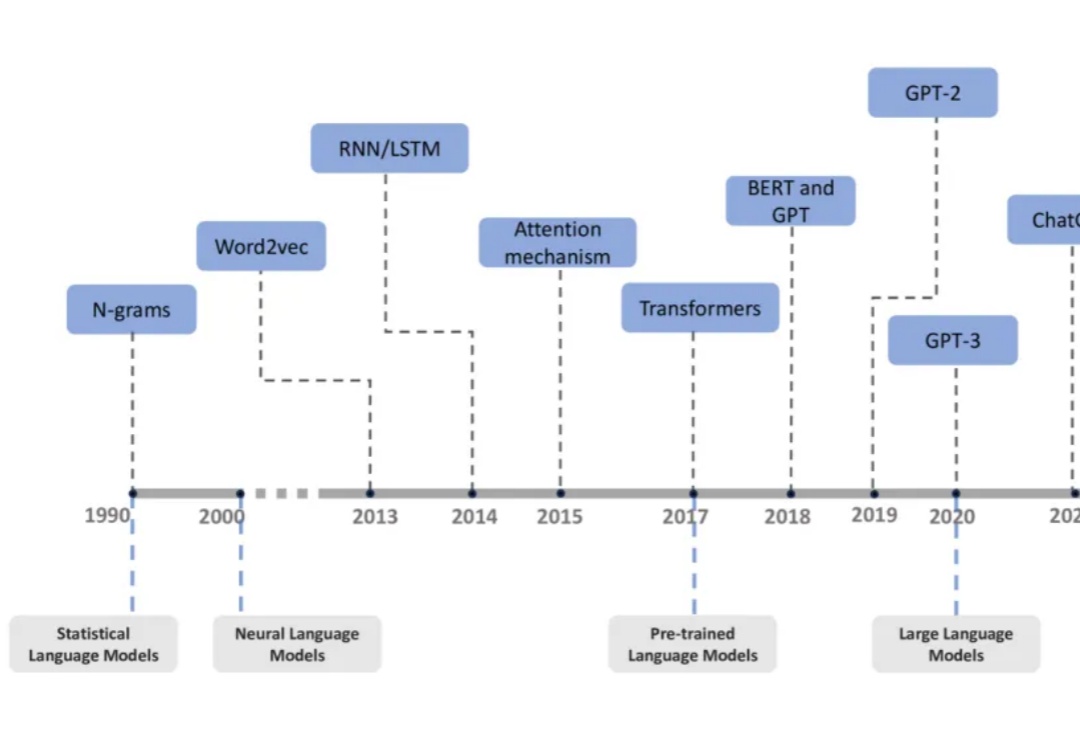

过去十年,自然语言处理领域经历了从统计语言模型到大型语言模型(LLMs)的飞速发展。

这两年,AI 领域最激动人心的进展莫过于大型语言模型(LLM)的崛起,LLM 展现了惊人的理解和生成能力。

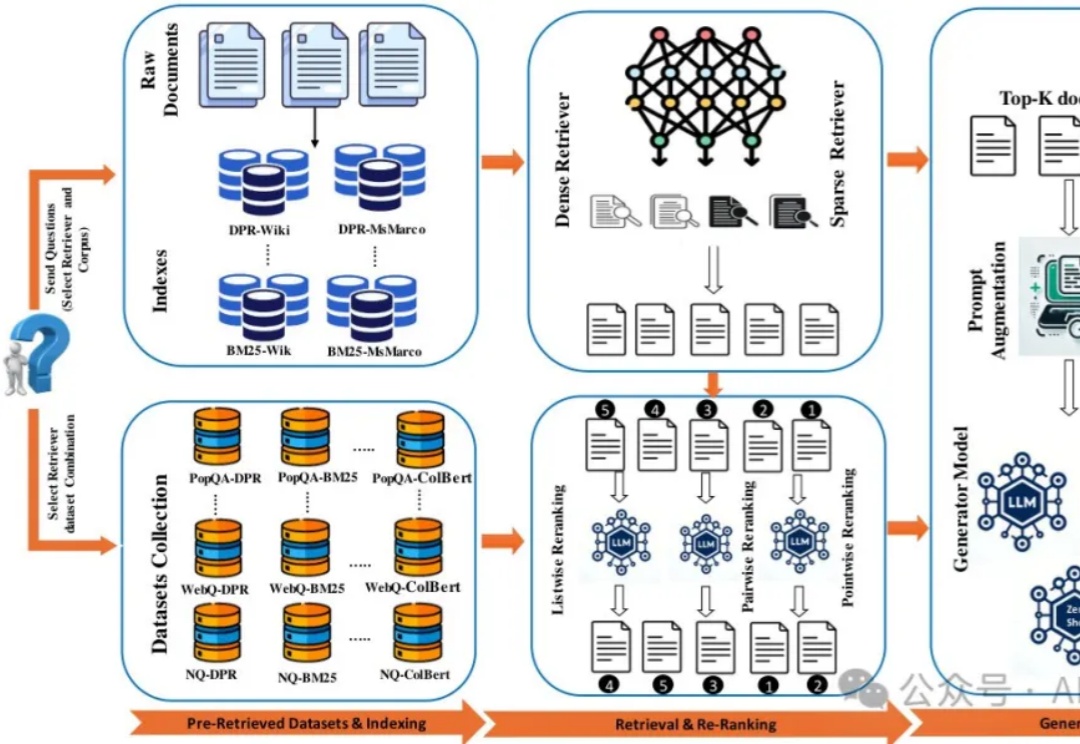

现有RAG工具的碎片化和复杂性常常让开发者头疼不已。昨天我的Agent群里朋友们就Rerank问题展开激烈讨论,我想起之前看到的一篇论文,这项研究介绍了一个完美的开源python工具包Rankify,它将检索、重排序和RAG三大功能整合在一个统一框架中,大幅简化了开发流程。

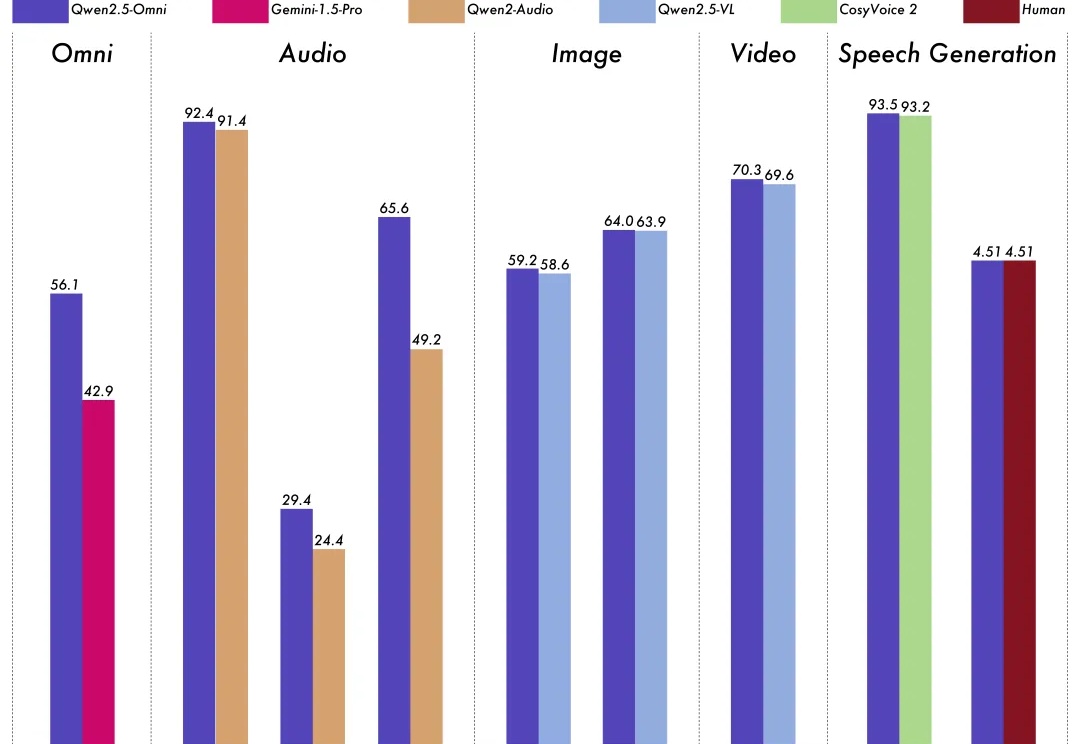

深夜重磅!阿里发布并开源首个端到端全模态大模型——

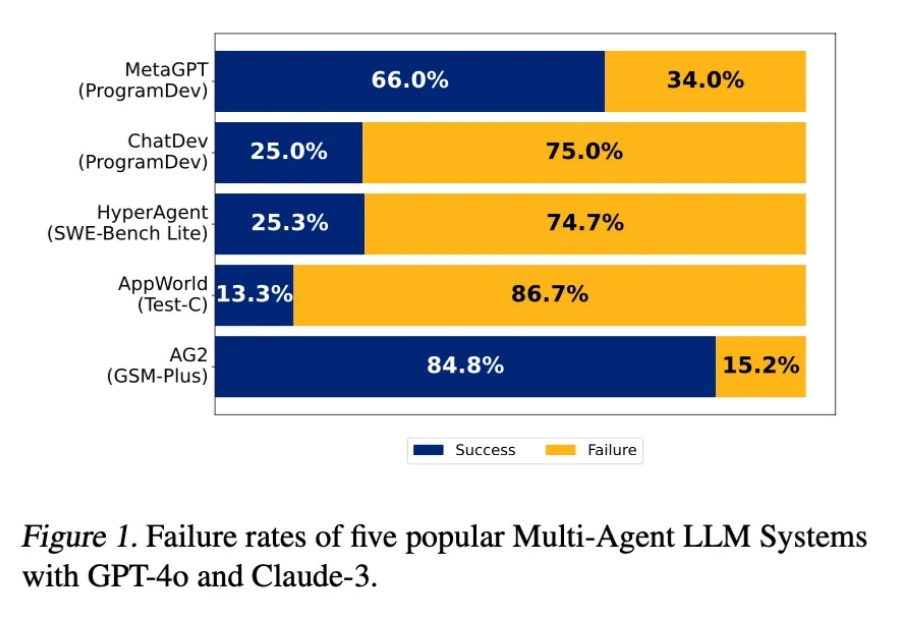

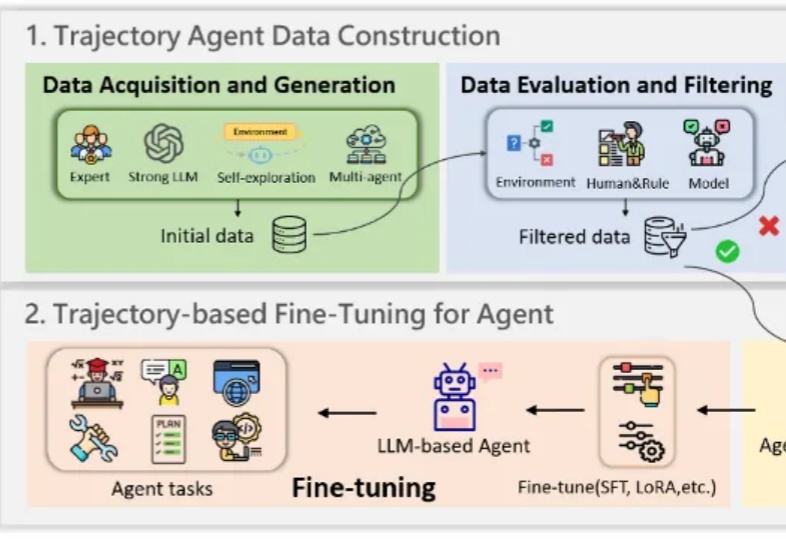

火,Agent可太火了!关于Agent的进展俯拾皆是,根本看不过来……

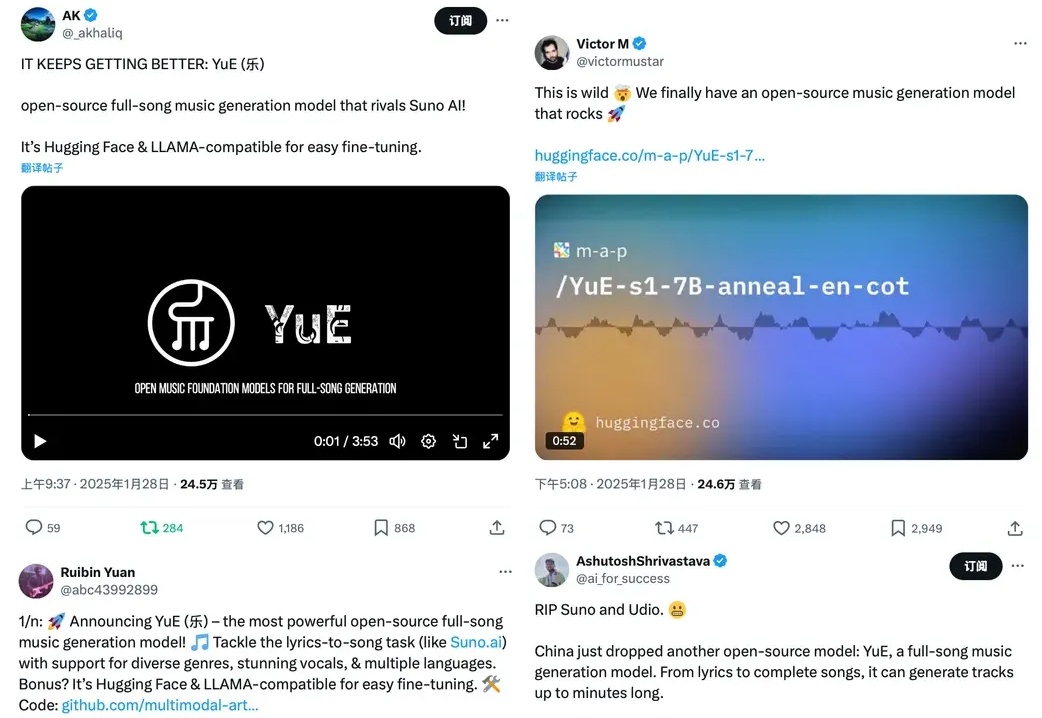

家人们震惊了!现在 AI 成精啦,不仅能写能画,现在连唱功都是格莱美级的了!

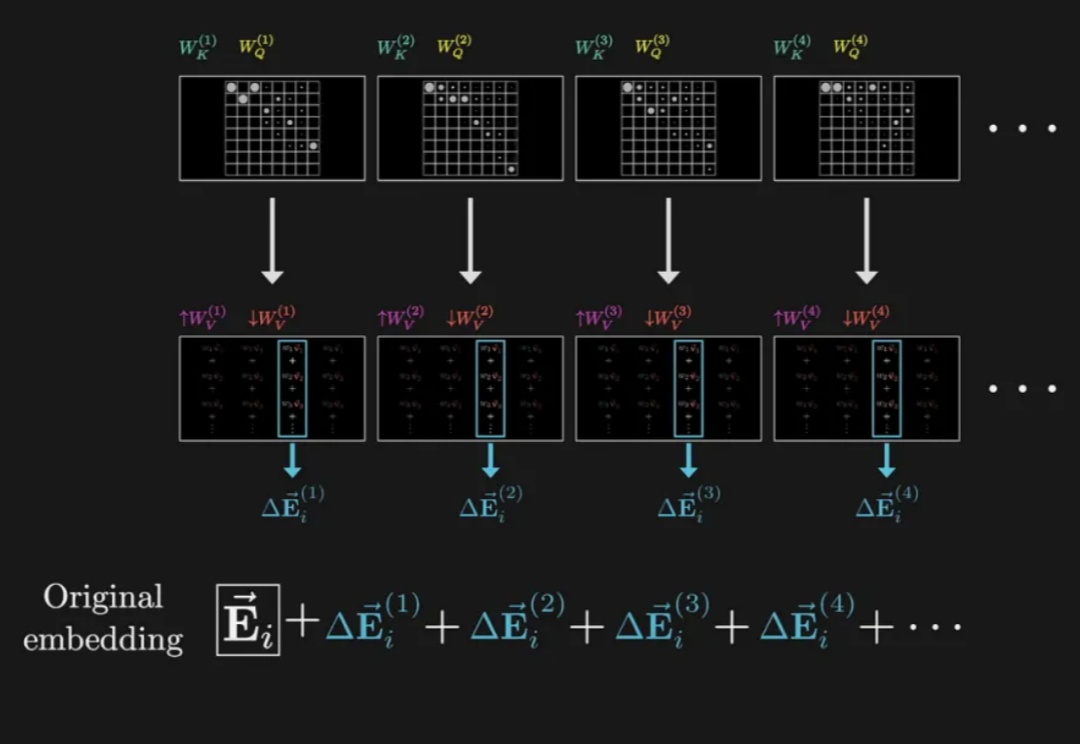

一种新的范式。

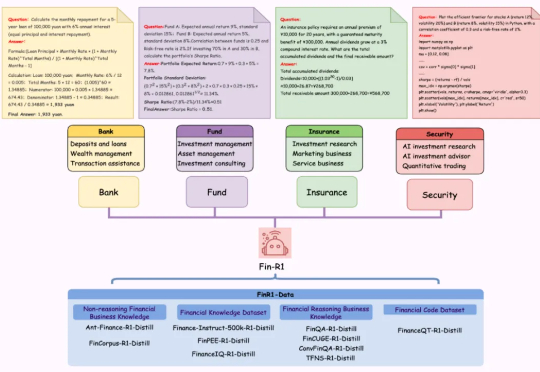

近日,上海财经大学统计与数据科学学院张立文教授与其领衔的金融大语言模型课题组(SUFE-AIFLM-Lab)联合数据科学和统计研究院、财跃星辰、滴水湖高级金融学院正式发布首款 DeepSeek-R1 类推理型人工智能金融大模型:Fin-R1,以仅 7B 的轻量化参数规模展现出卓越性能,全面超越参评的同规模模型并以 75 的平均得

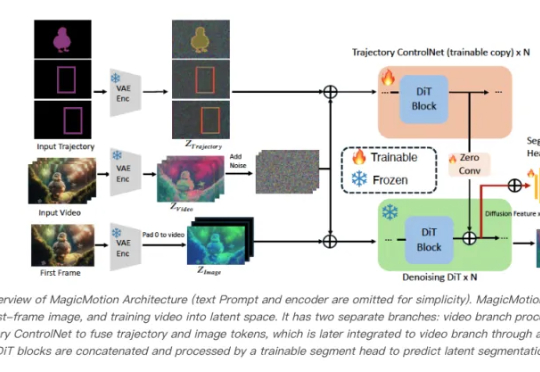

轨迹可控的视频生成来了,支持三种不同级别的轨迹控制条件——分别为掩码、边界框和稀疏框。研究人员提出了MagicMotion,一种创新的图像到视频生成框架,共同第一作者为复旦大学研究生李全昊、邢桢,通讯作者为复旦大学吴祖煊副教授。

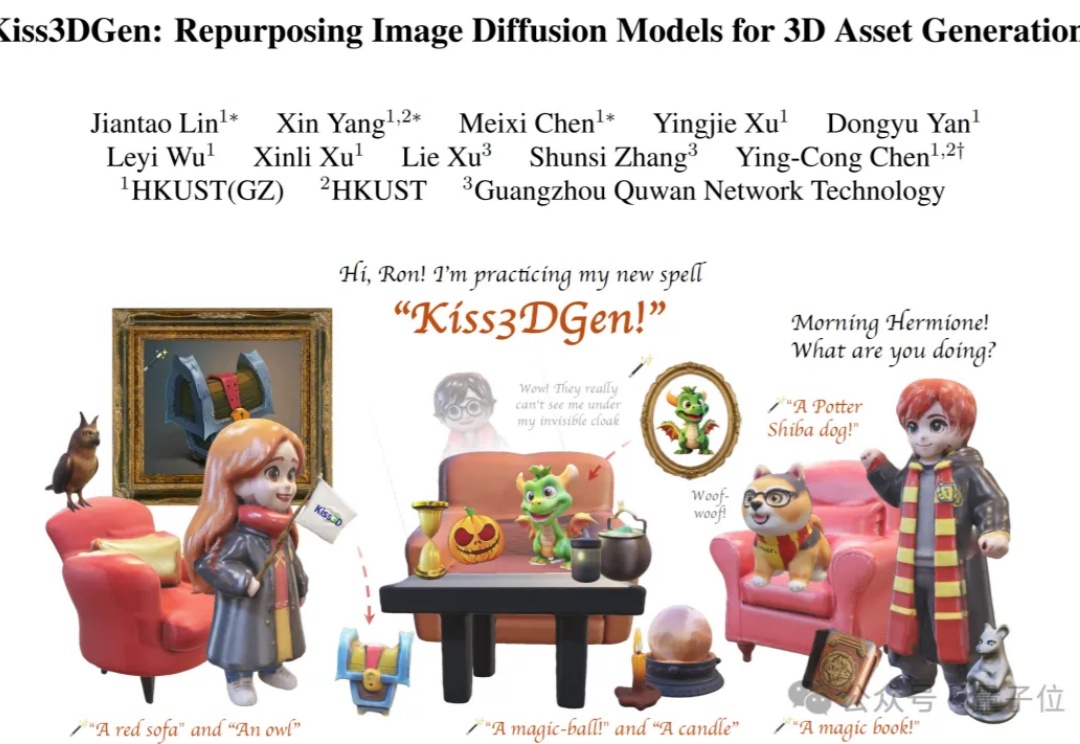

在Stable Diffusion当中,只需加入一个LoRA就能根据图像创建3D模型了?

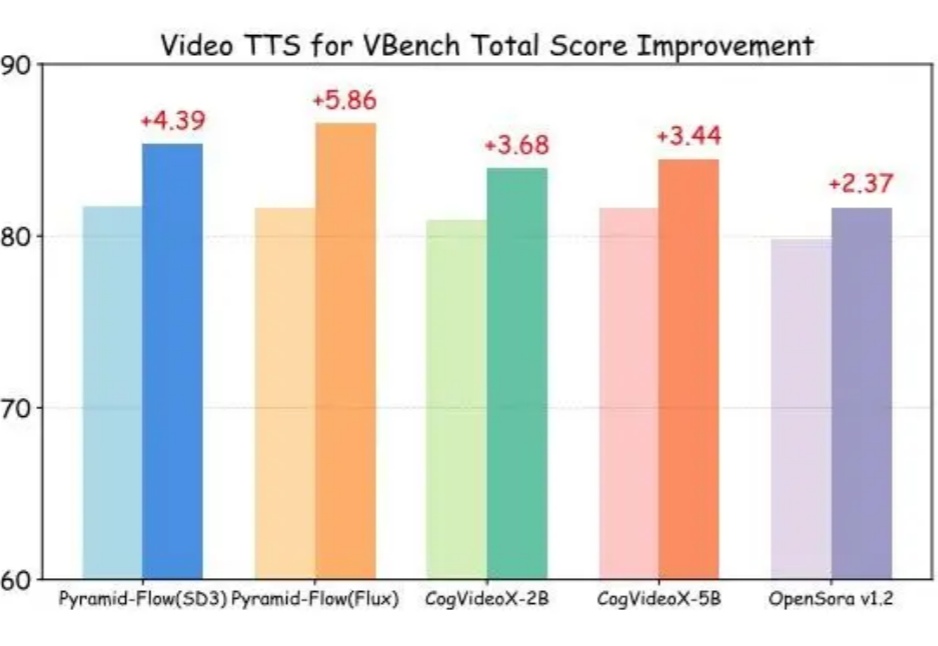

视频作为包含大量时空信息和语义的媒介,对于 AI 理解、模拟现实世界至关重要。视频生成作为生成式 AI 的一个重要方向,其性能目前主要通过增大基础模型的参数量和预训练数据实现提升,更大的模型是更好表现的基础,但同时也意味着更苛刻的计算资源需求。

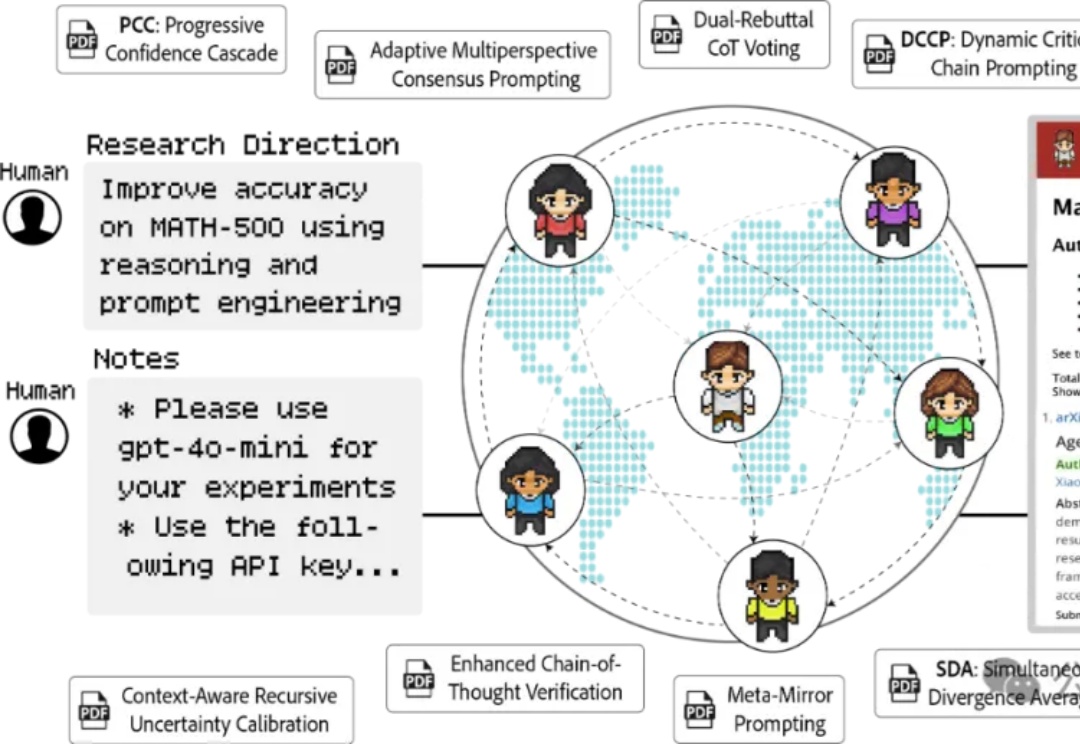

这项来自约翰霍普金斯与ETH Zurich的自主科研智能体框架AgentRxiv的确可以显著提高研究效率。我在测试了多次之后用Deepseek-V3-0324实现了它。

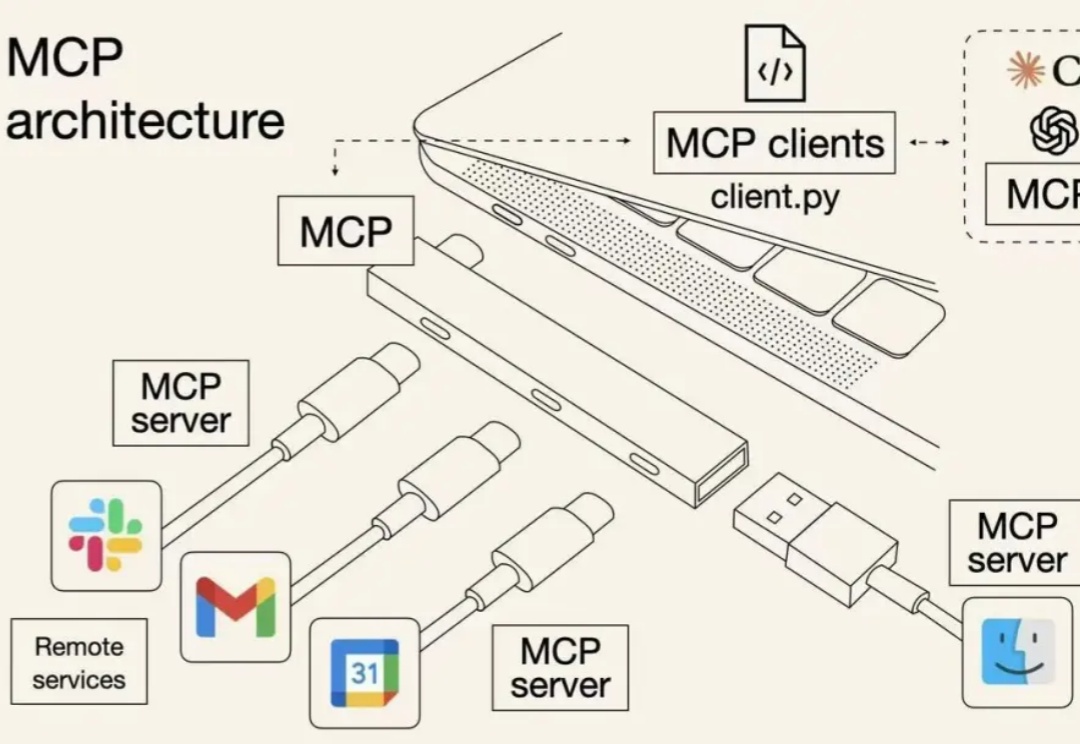

在拾象团队的 2025 的 AI 关键预测中,我们提到:随着 Agent 时代到来,OS 才是 LLM 厂商们最高的护城河,从 computer use 到 MCP,Anthropic 构建 OS 的决心是 AI labs 中最强、最明显的。

牛津大学教授新研究,未来AI的增长率足以在不到10年的时间里,推动相当于100年的技术进步。AI变革或将完全颠覆人类社会!

从手机随手拍、汽车行车记录仪到无人机航拍,如何从海量无序二维图像快速生成高精度三维场景?

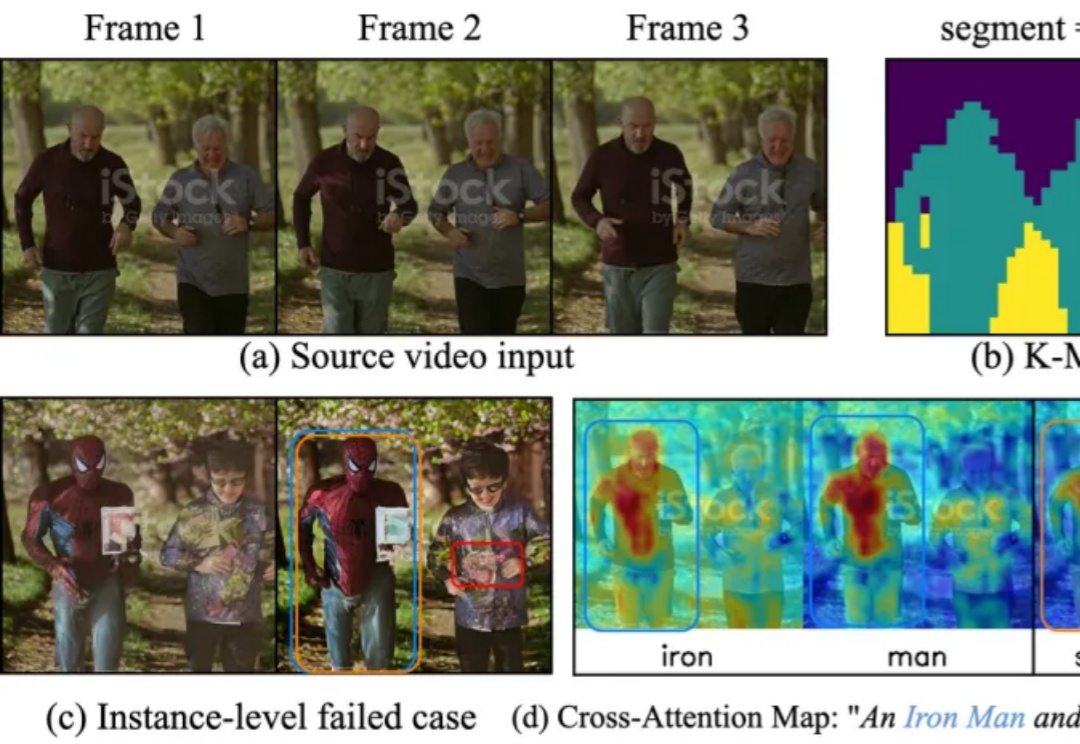

如何让你的模型能感知到视频的粒度,随着你的心思想编辑哪就编辑哪呢?

它名为 Uni-3DAR,来自深势科技、北京科学智能研究院及北京大学,是一个通过自回归下一 token 预测任务将 3D 结构的生成与理解统一起来的框架。据了解,Uni-3DAR 是世界首个此类科学大模型。并且其作者阵容非常强大,包括了深势科技 AI 算法负责人柯国霖、中国科学院院士鄂维南、深势科技创始人兼首席科学家和北京科学智能研究院院长张林峰等。