谷歌这次,把家底都掏了。

凌晨,谷歌DeepMind正式发布Gemma 4,一口气放出四款开源模型。

从能塞进手机的2B,到可以单卡跑满的31B,四个尺寸全覆盖,全部基于Gemini 3同源打造。

时隔一年,Gemma 4终于来了,实力迎来史诗级跃迁。

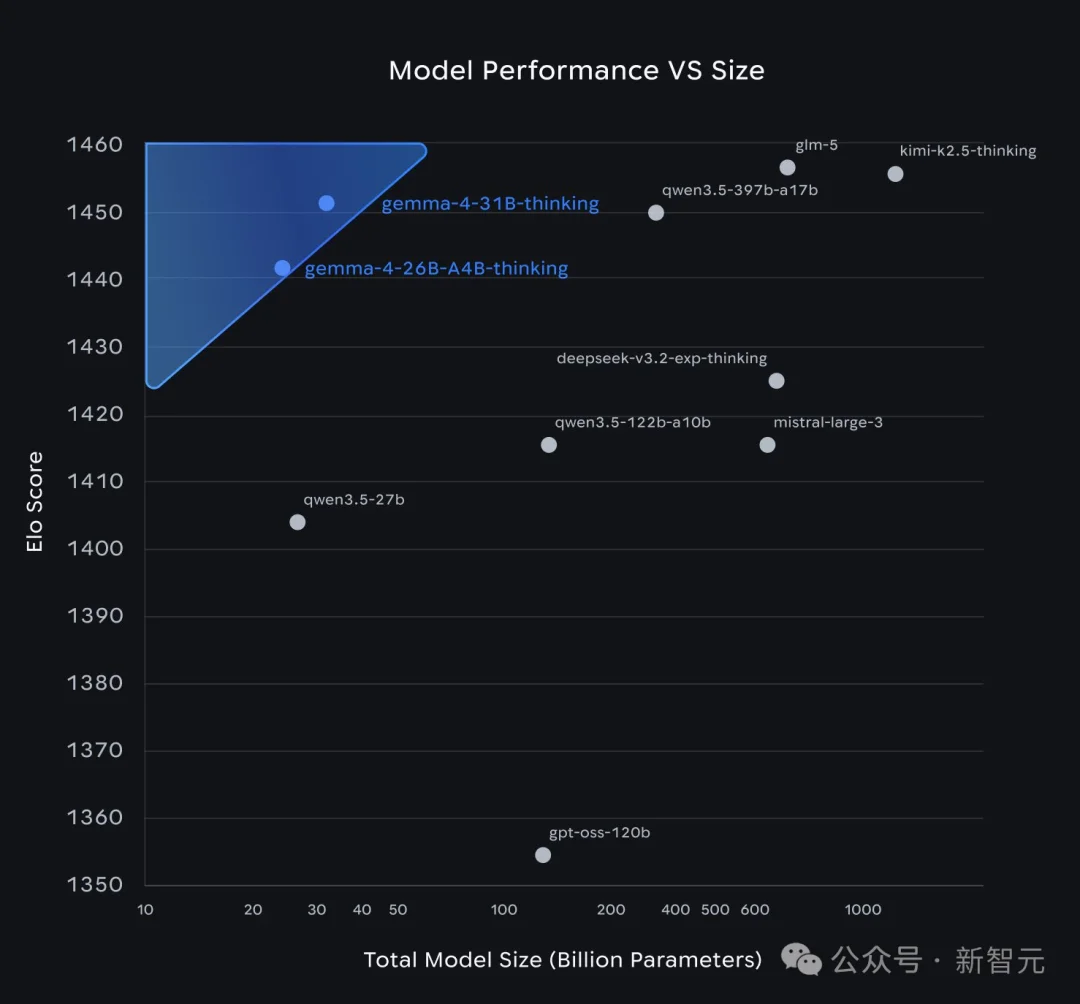

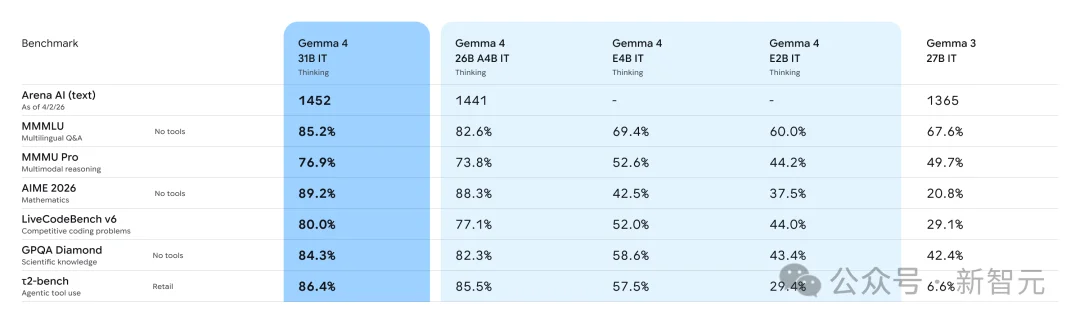

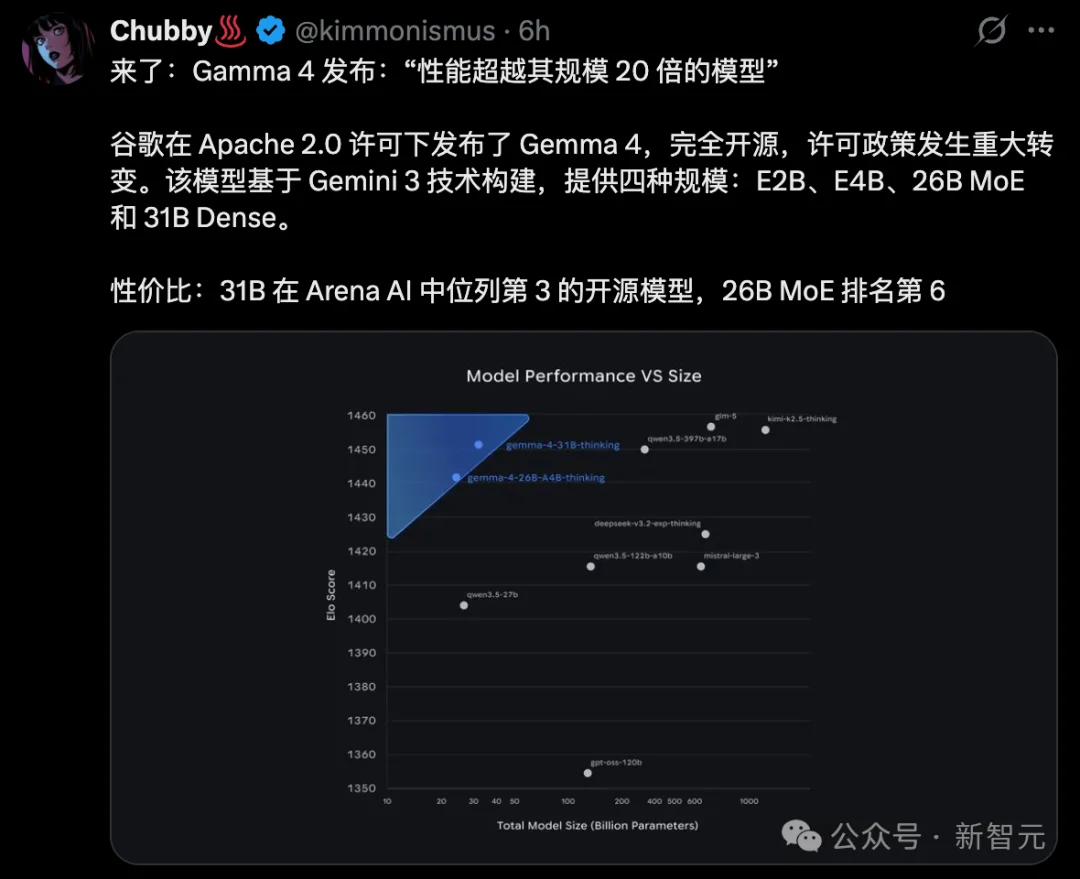

最炸的一个数字,31B Dense在Arena AI文本榜单上拿下开源第三,Elo评分1452。

排在它前面的,一个600多亿参数,一个超过1000亿。Gemma 4用31B的体量,硬生生挤进了这个量级的牌桌。

26B MoE更离谱:260亿参数,推理时只激活38亿,Elo打到1441,排开源第六。

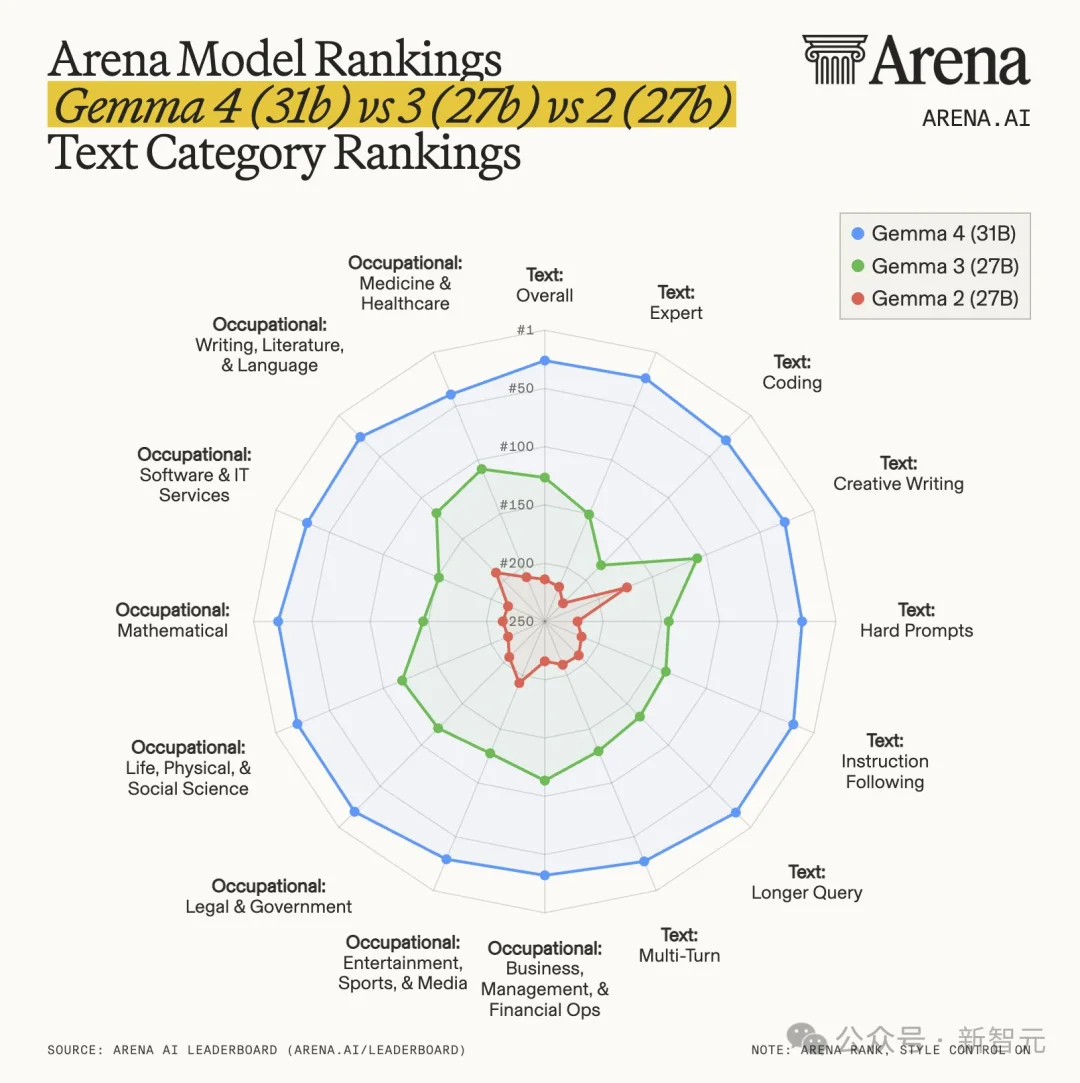

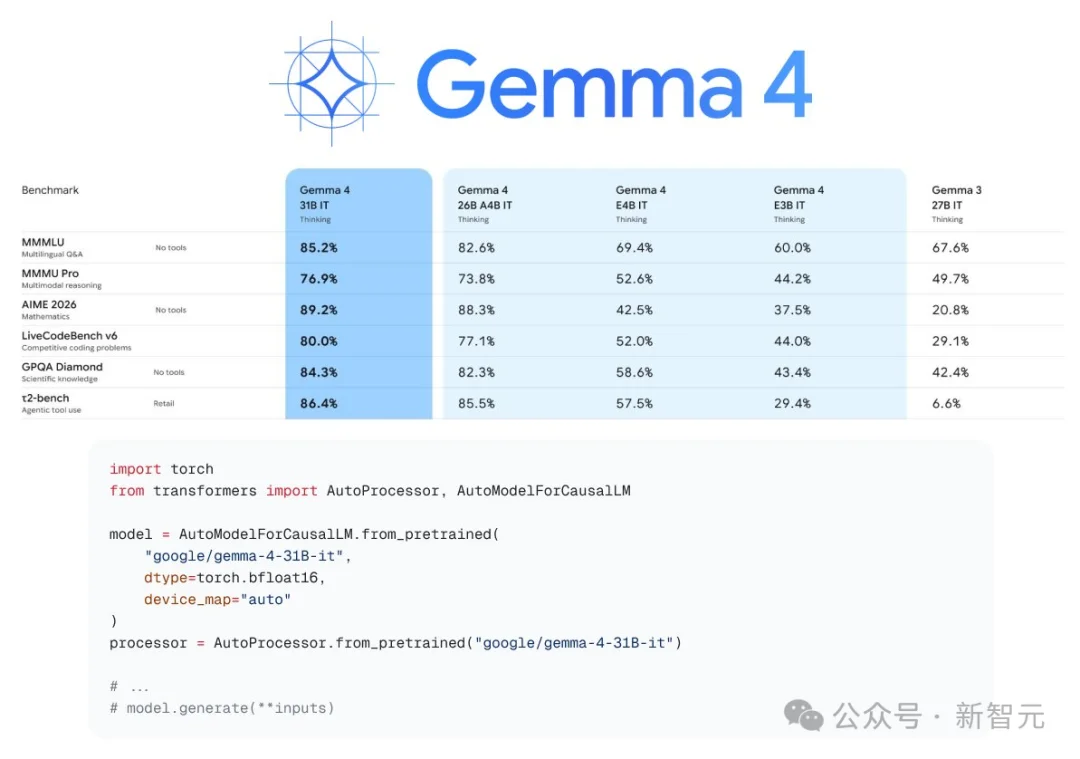

看一眼成绩单,Gemma 4几乎没有弱点,简直就是对上一代的「血脉压制」——

另外,在多语言推理、知识问答的基准测试中,Gemma 4均实现了40%性能飙升。

令全网背脊发凉的是,一个31B Gemma 4,越级斩杀体量是其20倍的模型。

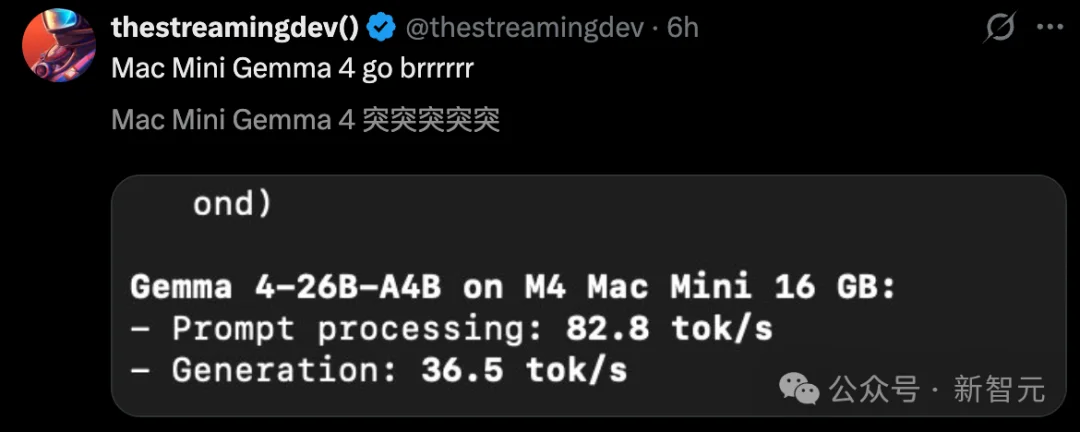

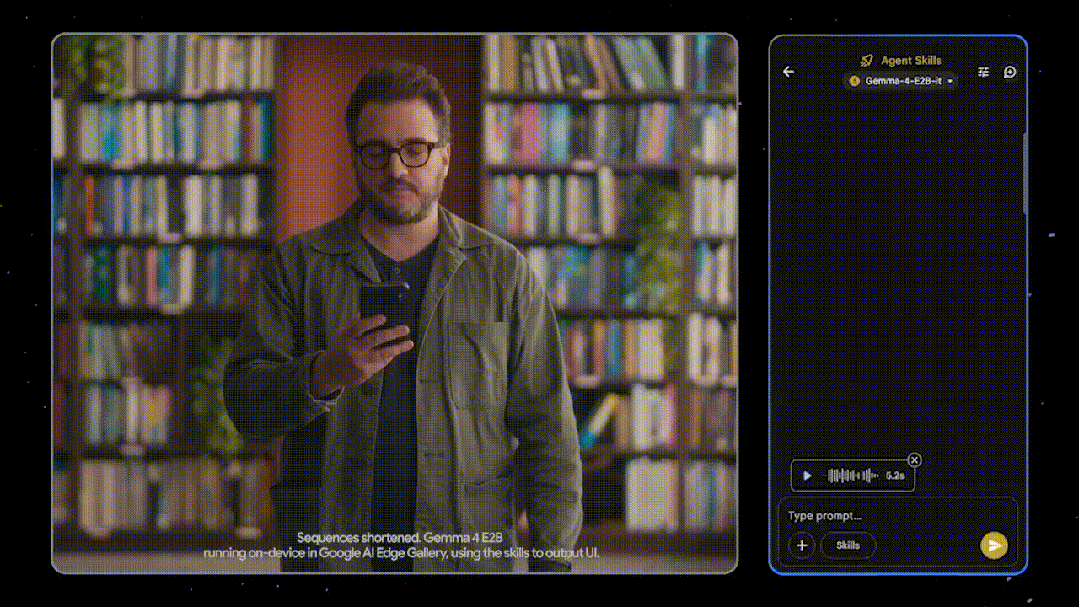

一台Mac mimi即可跑Gemma 4,还有人手机已经用上了。

Hugging Face CEO Clément Delangue的评价只有一句话,「这是一个巨大的里程碑。」

四款模型,从口袋到工作站全覆盖

先看Gemma 4「全家桶」具体成员——

每个尺寸都提供base和instruction-tuned两个版本。

E2B和E4B负责端侧,跟谷歌Pixel团队、高通、联发科联合优化,能在手机、树莓派、Jetson Orin Nano上离线运行,延迟接近零。

31B和26B面向开发者工作站和服务器,31B追求极致质量,26B靠MoE架构换取极致速度。

对开发者来说,31B的bfloat16权重可以塞进一张80GB的H100;量化版本在消费级显卡上就能跑。

26B MoE因为只激活3.8B参数,出token速度极快,适合需要低延迟的Agent场景。

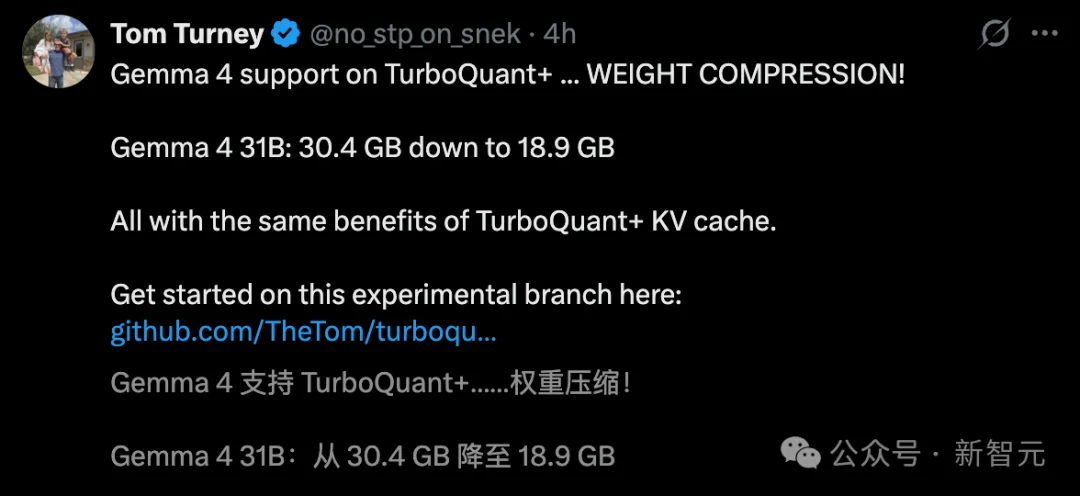

值得一提的是,Gemma 4还支持「被曝抄袭」的TurboQuant压缩算法。

跑分碾压,跨级暴打

看完定位看跑分。

31B在数学推理上的表现尤其惊人。AIME 2026拿到89.2%,对比Gemma 3 27B的20.8%,提升超过四倍。

GPQA Diamond(科学知识)84.3%,同样把前代远远甩开。

编程能力同样炸裂。LiveCodeBench v6上31B拿到80%,Codeforces Elo达到2150,相当于一个紫名选手的水平。26B MoE也不弱,LiveCodeBench 77.1%,Codeforces 1718。

多模态方面,MMMU Pro(多模态推理)31B拿到76.9%,26B拿到73.8%,都大幅领先前代的49.7%。

长上下文能力同样有质的飞跃。MRCR v2 8-needle 128K测试中,31B拿到66.4%,26B拿到44.1%,Gemma 3 27B只有13.5%。

小尺寸也没拉胯,E4B在AIME上42.5%,LiveCodeBench 52%,对一个只有45亿有效参数的选手来说,这个成绩放在一年前是旗舰级的。

三个架构设计

让小模型打出大模型的牌

Gemma 4的架构没有堆砌花哨的新概念,反而是把几个经过验证的技术组合到了最优状态。

谷歌明确表示,他们去掉了Altup等「效果不确定」的组件,只保留了真正有用的东西。

逐层嵌入(Per-Layer Embeddings,PLE)

传统Transformer里,每个token在输入层获得一个嵌入向量,后面所有层都基于这个初始表示做计算。问题在于,这要求嵌入层一次性把所有信息打包进去,负担很重。

PLE的做法是给每一层都配一个专属的低维信号通道。

每个token在每一层都能收到一个定制化的向量,由token本身的身份信息和上下文信息共同生成。

打个比方,传统做法像是出门前把一天要用的所有东西塞进一个背包;PLE像是每到一个地方,都有人递给你当下最需要的工具。

因为PLE的维度远小于主隐藏层,额外开销很小,但每一层都获得了专属的调节能力。这个设计在小模型上效果尤其明显,是E2B和E4B能以极小体量跑出好成绩的关键。

共享KV缓存

最后N层不再自己计算Key和Value投影,而是直接复用前面层的KV张量。同类型的注意力层(滑动窗口或全局注意力)共享同一组KV状态。

效果是推理时的显存占用和计算量都下降了,长上下文生成和端侧部署尤其受益。谷歌称这对质量的影响「微乎其微」。

交替注意力机制

模型交替使用局部滑动窗口注意力和全局全上下文注意力。

小模型用512 token的滑动窗口,大模型用1024。全局层配合等比例RoPE拉长上下文覆盖范围,滑动层用标准RoPE保持局部建模效率。

这三个设计的共同目标只有一个,让每一个参数都尽可能高效地被利用。

看图、听声、读视频

一个Gemma全搞定

Gemma 4全系能处理图像和视频输入,E2B和E4B还额外兼容音频。

视觉编码器相比Gemma 3做了两个关键升级,一是可变宽高比(不再强制裁切),二是可配置的图像token预算(70/140/280/560/1120五档可选)

低预算适合分类和描述,高预算适合OCR和文档解析。开发者可以根据场景在速度和精度之间自由取舍。

GUI元素检测。

给一张网页截图,问「view recipe按钮在哪」,四个尺寸都能以JSON格式返回精确的边界框坐标,不需要任何特殊提示词。31B的定位最精准,E2B稍有偏差但基本可用。

视频理解。

用一段现场演唱会视频做测试。E4B准确描述了舞台画面,也从音轨中提取了歌词主题。

26B和31B没有音频输入能力,但对纯视觉内容的理解同样到位,甚至识别出了屏幕上的赞助商品牌名。

音频转写。

E4B对一段英文演讲的转写几乎完美,标点和断句都很自然。E2B偶尔会出现幻觉,但整体可用。

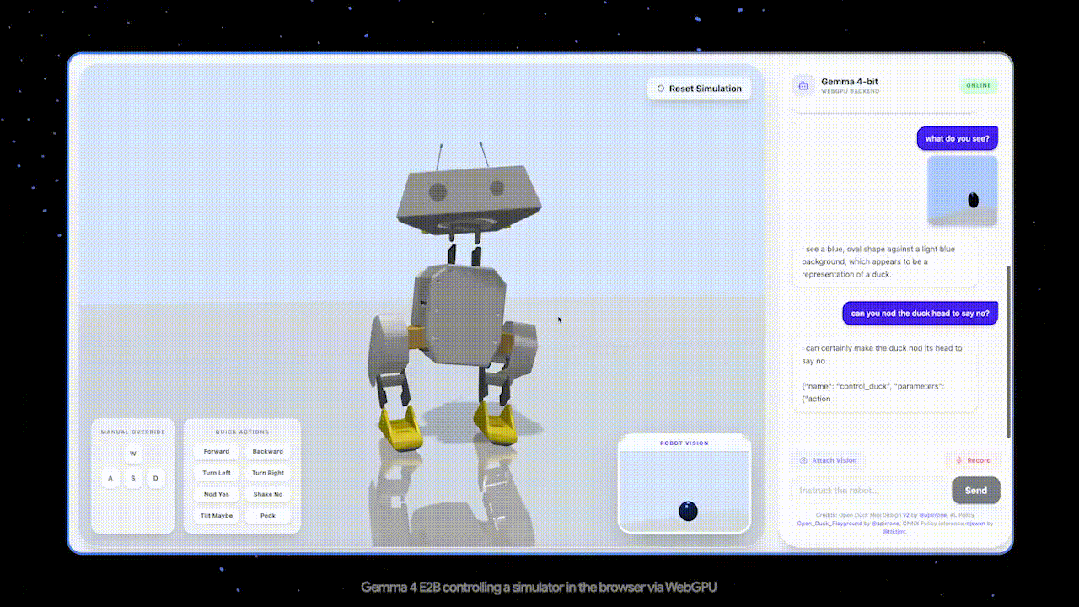

多模态函数调用。

给一张曼谷寺庙的照片,问「这是哪个城市?帮我查一下当地天气」。

四个尺寸都正确识别出曼谷,并自动调用了get_weather工具。全程不需要额外的提示工程。

函数调用是从训练阶段就内置的,基于去年底发布的FunctionGemma研究成果,能处理多轮多工具的Agent工作流。这跟之前靠提示词「哄」模型做工具调用的路线完全不同。

Apache 2.0,谷歌终于放手了

这次发布最大的非技术新闻,是Gemma 4首次采用Apache 2.0协议。

之前的Gemma系列用的是谷歌自定义许可证,里面有「有害使用」限制条款和归属要求,企业法务团队需要逐条审查才能确认是否可以商用。

Apache 2.0一步到位,没有自定义条款,没有灰色地带,修改、分发、商用完全自由。

自Gemma初代发布以来,累计下载量超过4亿次,社区衍生版本超过10万个。Apache 2.0的加持下,这个数字大概率还会加速增长。

开源模型,规则变了

Gemma 4的发布,让谷歌的双线策略彻底成型。

顶层是Gemini系列闭源模型,占据榜单前列,通过API变现。底层是Gemma系列开源模型,用同源技术喂养开发者生态,抢占本地部署、端侧推理、Agent开发的入口。

一个做收入,一个做生态。彼此不冲突,反而互相放大。

对开发者来说,选择已经摆在面前。

一个31B的体量,能在单卡上跑出接近千亿参数级别的效果,Apache 2.0随便用,从手机到服务器全覆盖,微调工具链完整。

参数效率这条路,谷歌跑在了最前面。31B打赢20倍体量的对手,2B塞进手机口袋。

开源模型的比赛,规则已经变了。

参考资料:

https://blog.google/innovation-and-ai/technology/developers-tools/gemma-4/

文章来自于微信公众号 "新智元",作者 "新智元"

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0