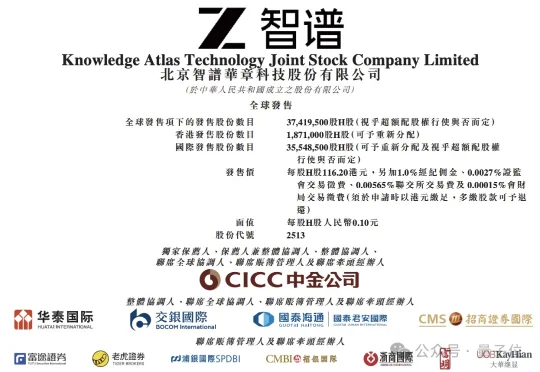

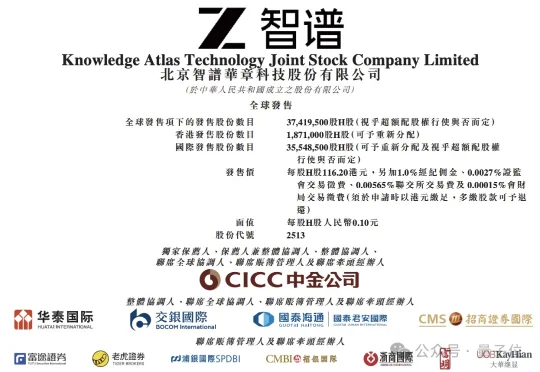

智谱定档大模型第一股,1月8日挂牌上市,IPO预募资43亿港元

智谱定档大模型第一股,1月8日挂牌上市,IPO预募资43亿港元全球大模型第一股,最后百米冲刺。刚刚,智谱正式启动招股,股票代码2513(AI我一生~)。预计将于2026年1月8日在港交所主板挂牌上市。据披露,本次IPO募资总额预计约43亿港元,上市后市值预计超过511亿港元。

全球大模型第一股,最后百米冲刺。刚刚,智谱正式启动招股,股票代码2513(AI我一生~)。预计将于2026年1月8日在港交所主板挂牌上市。据披露,本次IPO募资总额预计约43亿港元,上市后市值预计超过511亿港元。

「前几天翻出来去年 Manus 正式立项那天我们几个讨论的录音,交给 Manus 整理成了这个文件。回头看去这一年,基本上是把当时讨论的点都实现到了。算是很有价值的一次讨论了。

前两周忙着视频播客炒作,脚都没沾地。回来打开后台一看天塌了:我被人投诉了。

史上首次,ICLR成立后设立机制设计相关Workshop,全球顶流学者众神云集!

今天凌晨收到 Manus 联合创始人的微信:「鹏哥,我们今天有个新进展,之前确实不好透露太多。现在正式发布了,我第一时间给你说一声。」

第二款大厂出品的生活服务类AI原生应用来了!

如果你也相信AI的本质是一种信息媒介,那么有一个场景几乎是必然会被颠覆的:新闻客户端。

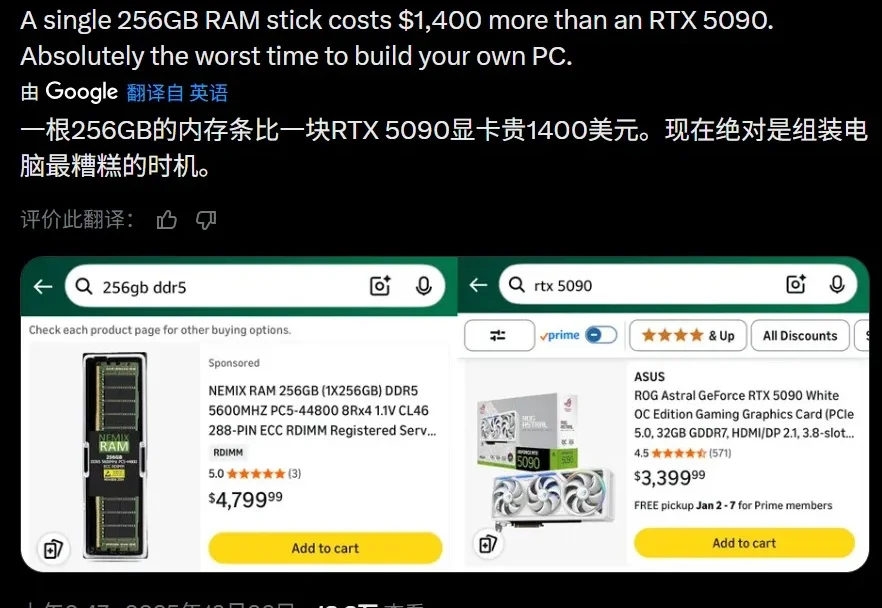

「我一直在告诉大家,如果你想买(电子)设备,现在就买。我自己要买的 iPhone 17 就已经下手了。」这是咨询公司 TrendForce 高级研究副总裁 Avril Wu 在最近接受采访时说的一句话。

大家好,我是艾逗笔。 今天我花了一天时间,招聘了 6 个 AI 员工,帮助他们走完了入职流程,给他们分配了工作权限,了解了他们各自的特点和能力,然后安排了一个工作间,让他们在一起开始干活了。

2025年,AI终于从实验室冲进你的手机、浏览器,甚至购物车——但别被热闹骗了:赢家通吃的游戏从未如此真实。在 Andreessen Horowitz(a16z)最新发布的《2025消费级AI现状》年终报告中,我们看到一场表面百花齐放、实则高度集中的军备竞赛:ChatGPT 依然稳坐王座,Gemini 凭借一张“香蕉图”狂飙突进,而大多数用户——超过90%——根本懒得切换第二款AI。

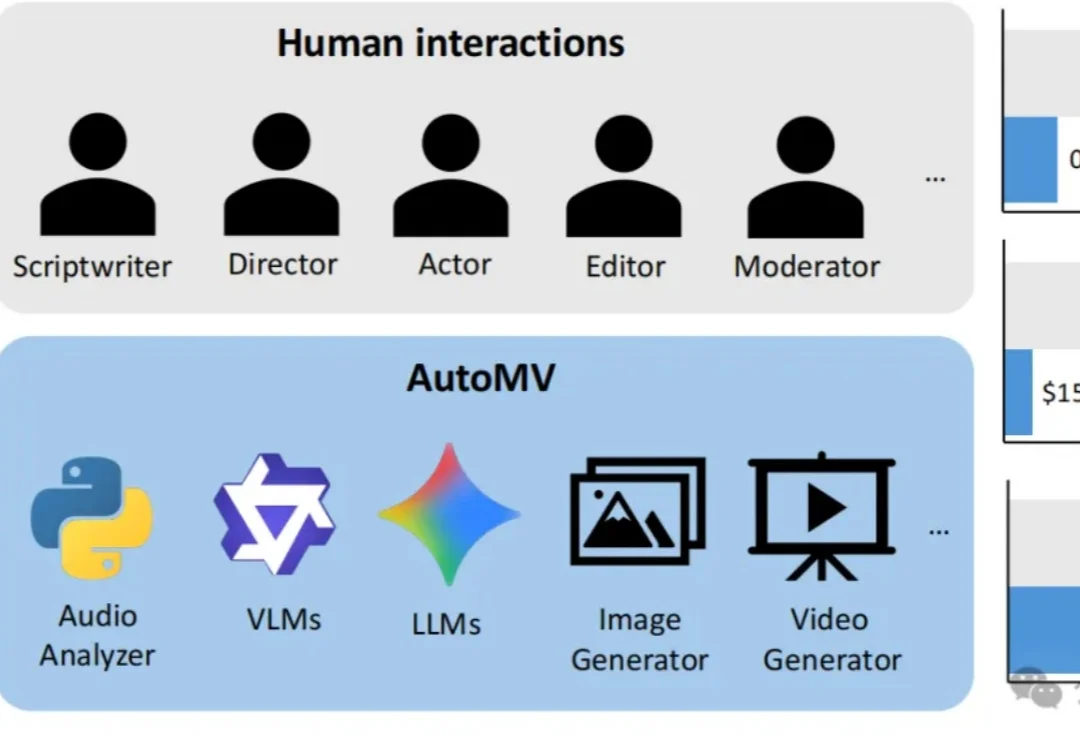

现有的AI视频生成模型虽然在短片上效果惊人,但面对一首完整的歌曲时往往束手无策——画面不连贯、人物换脸、甚至完全不理会歌词含义。

这两天,影视飓风那支《带着100万...我们去了论文代写聚集地》的视频彻底火了。大众的目光都被肯尼亚贫民窟里庞大的“论文代写产业链”所吸引,2.5美元的廉价劳动力、流水线般的学术欺诈。

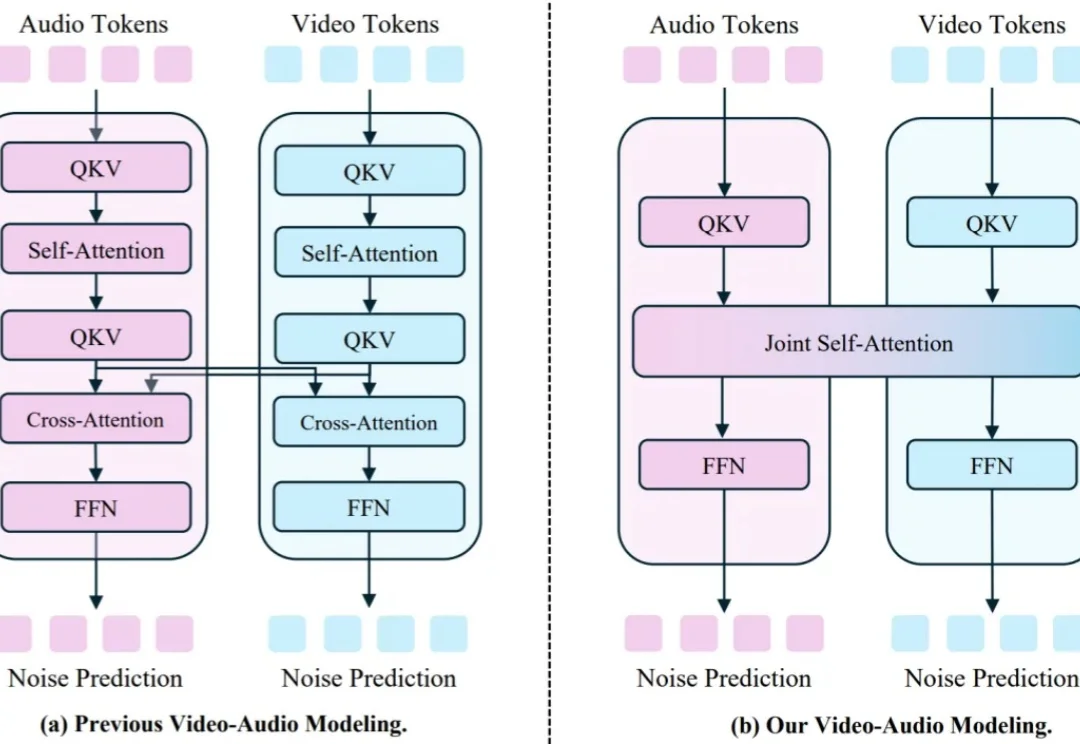

视频 - 音频联合生成的研究近期在开源与闭源社区都备受关注,其中,如何生成音视频对齐的内容是研究的重点。

在刚刚落幕的“AI 闪耀中国 2025”科技人文秀上,吴晓波带来了一场不同于往年的“硬核”演讲。这一年,他深入 65 家企业的产业现场,勾勒出了一幅 AI 从“云端落地”的中国图景。

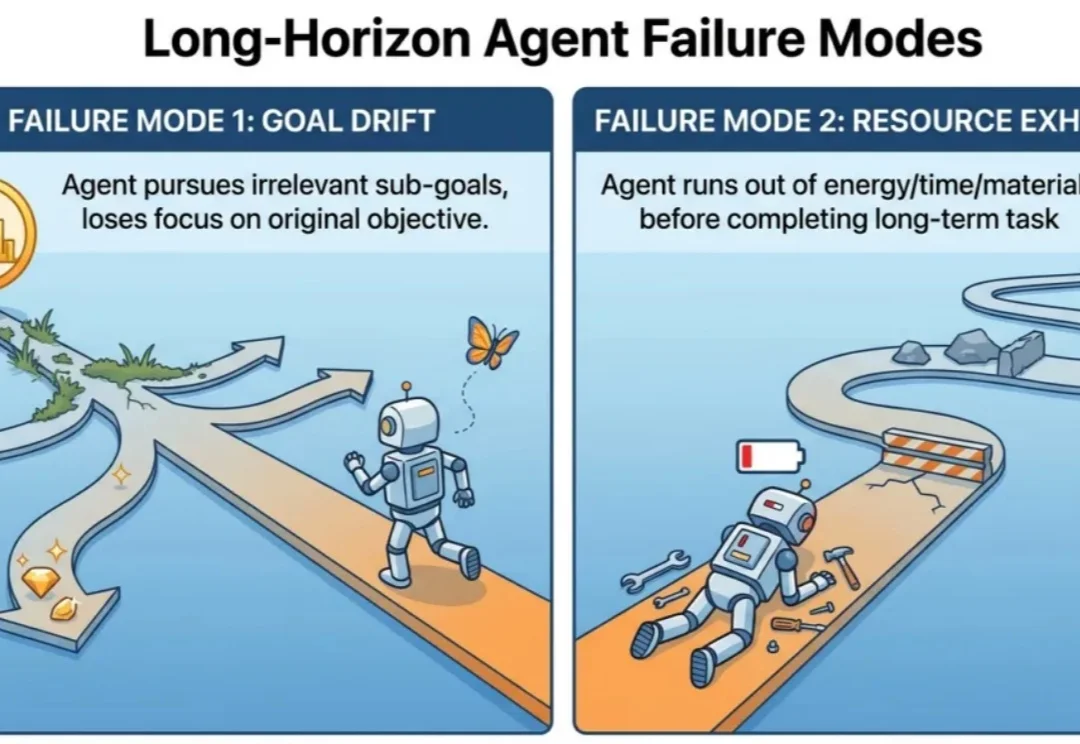

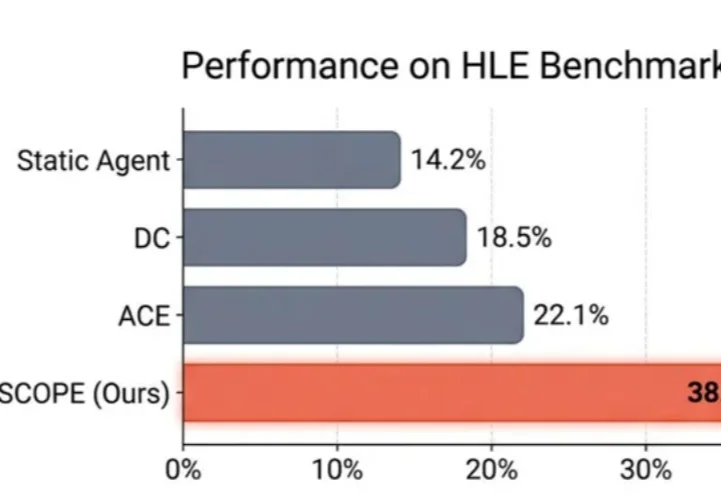

做agent简单,但是做能落地的agent难,做能落地的长周期agent更是难上加难!

在空间智能(Spatial Intelligence)飞速发展的今天,全景视角因其 360° 的环绕覆盖能力,成为了机器人导航、自动驾驶及虚拟现实的核心基石。然而,全景深度估计长期面临 “数据荒” 与 “模型泛化差” 的瓶颈。

一套 WPS 的 AIPPT 工作流长什么样?

在 LLM Agent 领域,有一个常见的问题:Agent 明明 "看到了" 错误信息,却总是重蹈覆辙。

在电影与虚拟制作中,「看清一个人」从来不是看清某一帧。导演通过镜头运动与光线变化,让观众在不同视角、不同光照条件下逐步建立对一个角色的完整认知。然而,在当前大量 customizing video generation model 的研究中,这个最基本的事实,却往往被忽视。

WHAAAT,一睁眼,Manus被Meta收购了!Meta和Manus官网同时发布最新消息,“Manus将加入Meta”。Manus官网文章显示,Manus将继续通过app和网站为用户提供产品和订阅服务,同时公司将继续在新加坡运营。

世界模型的场景,不止在自动驾驶方面。 极客公园近期接触到的 Deep Optica,刚刚完成由 BV 百度风投、零以创投参与的种子轮融资,正试图从「判断方式」本身入手,为这一高度不确定的过程提供一种更加结构化的路径。

在 Gambo 里,你不需要敲代码、不需要学美术、不需要处理角色、动画、地图、音效之间的复杂关系。你只需要不断地告诉它:你要做什么类型的游戏、希望有什么机制、哪里需要改得更好玩一点。

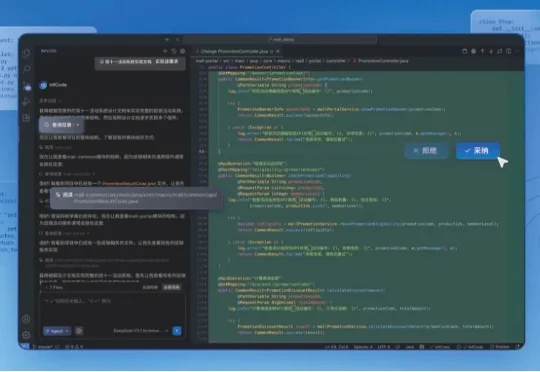

企业级场景和Vibe Coding,很大程度是相悖的。 文|邓咏仪 编辑|苏建勋 仅用半年时间,杨萍就目睹了AI Coding赛道有多疯狂。 2024年,Vibe Coding赛道发展如火如荼。Cur

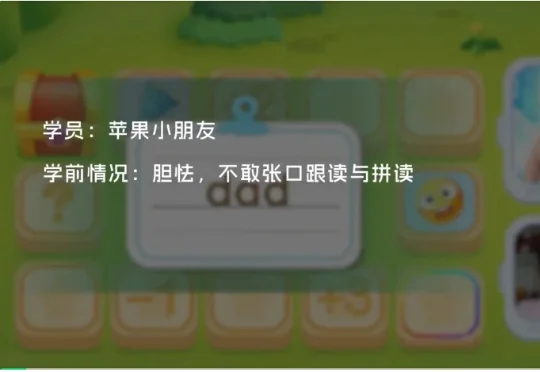

2025 年初,成立不到两年的首批 AI 原生应用企业与爱为舞率先落地了国内首个真人级 AI 一对一导师产品「爱学」。App 上线不到一年,已经被超过百万名学员真实使用。

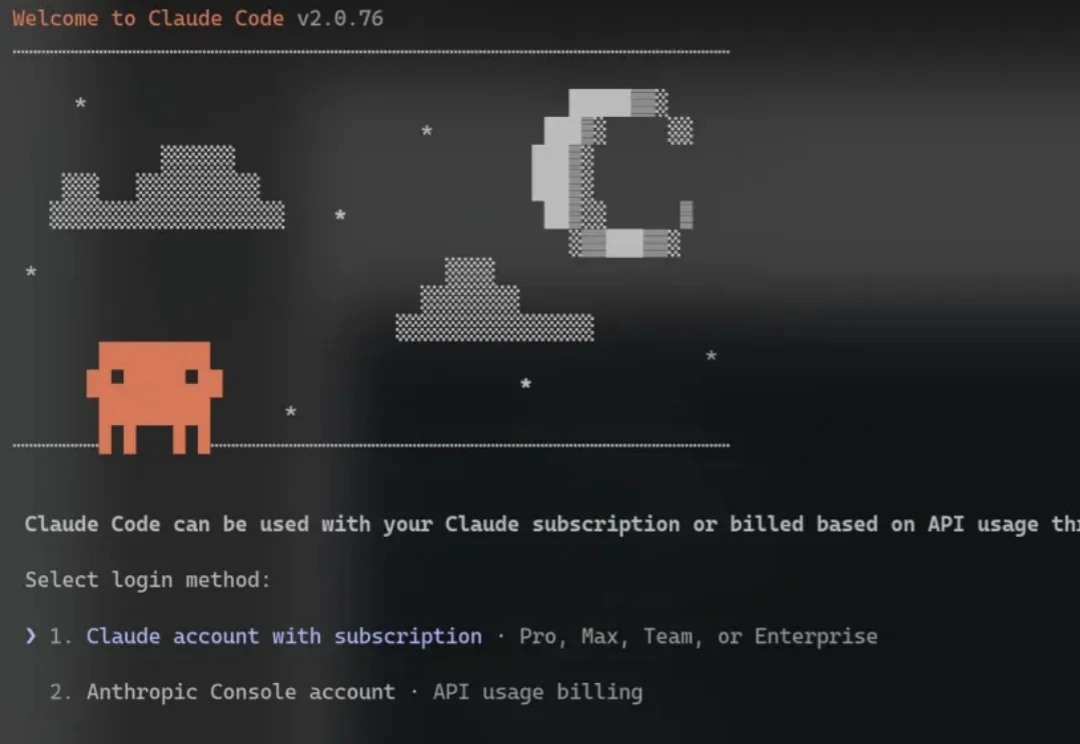

惊到了!Claude Code之父 Boris Cherny 刚跟大神卡帕西友好互动了“9级大地震”的帖子,后脚就在X上放出自己过去一个月使用CC的真实生产数据:

百万年薪急招一名高管!

更多英伟达收购「TPU之父」创业公司Groq的细节曝光了—— 主打一个黄仁勋BOSS直聘。

Metronome成立于2019年的旧金山,专注于为AI与软件公司提供实时计费基础设施,解决从传统按Seat收费转向按用量、Token等复杂定价的工程难题。目前其融资总额达1.28亿美元,已服务OpenAI、NVIDIA、Databricks等头部企业,终端用户超1.5亿,成为AI时代“按价值收费”的关键基础设施。

行业最新AI陪伴产品,玩起来简直太上头了,这波是真的爱了。不卖关子,这正是国内漫画头部玩家快看,在快看漫画2.0版本中推出的AI陪伴互动漫画,也是一次关于叙事型陪伴的全新尝试。

组织调整后的模型答卷,将对腾讯至关重要。《智能涌现》从多名独立信源处获悉,近日,出于个人发展原因,原腾讯 AI Lab副主任俞栋将从腾讯离职。截至发稿前,腾讯官方暂未回复。