国产3D虚拟人版《Her》「杀向」迪拜

国产3D虚拟人版《Her》「杀向」迪拜在全球三大IT展之一的GITEX GLOBAL上,量子位在某个展台,先后体验了和Chatbot聊天、用AI创建属于自己的3D数字人形象、和3D形象实时语言、肢体互动。 也就是说,《Her》有了3D虚拟人版。

搜索

搜索

在全球三大IT展之一的GITEX GLOBAL上,量子位在某个展台,先后体验了和Chatbot聊天、用AI创建属于自己的3D数字人形象、和3D形象实时语言、肢体互动。 也就是说,《Her》有了3D虚拟人版。

能拿下数学奥赛银牌水平的AI是否达到了12岁陶哲轩的水平? 陶神本人的回答来了

Indeed Hiring Lab 评估了OpenAI开发的生成式AI模型GPT-4在超过2800项工作技能中的表现。

当前最受关注的AI眼镜、AI耳机、AI头显、AI可穿戴等,百度几乎都缺席了。

近日,七牛智能科技有限公司(简称“七牛云”)正式登陆港交所,成为资本市场的一员。然而,尽管历经多年精心筹备,七牛云的上市并未获得市场的热烈反响。

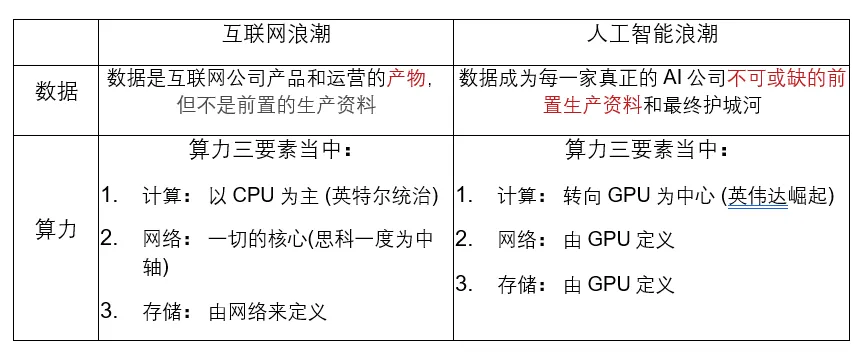

2022年诞生的ChatGPT,已经在相当程度上实现了大模型的Scaling law(尺度定律)和通用能力涌现。

近日,来自谷歌和苹果的研究表明:AI模型掌握的知识比表现出来的要多得多!这些真实性信息集中在特定的token中,利用这一属性可以显著提高检测LLM错误输出的能力。

LLM训练速度还可以再飙升20倍!英伟达团队祭出全新架构归一化Transformer(nGPT),上下文越长,训练速度越快,还能维持原有精度。

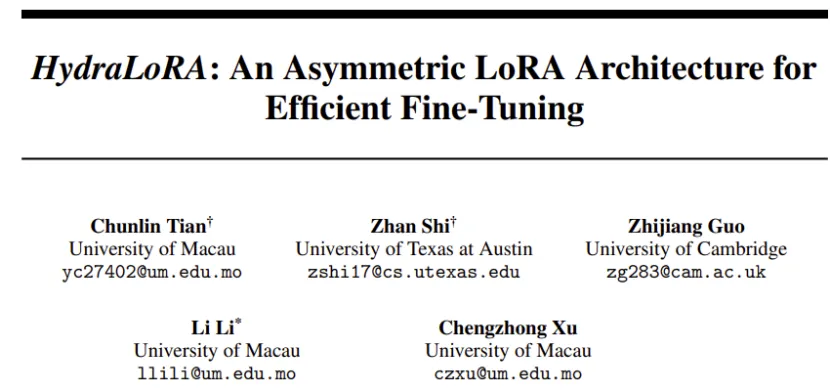

大型语言模型(LLMs)虽然在适应新任务方面取得了长足进步,但它们仍面临着巨大的计算资源消耗,尤其在复杂领域的表现往往不尽如人意。

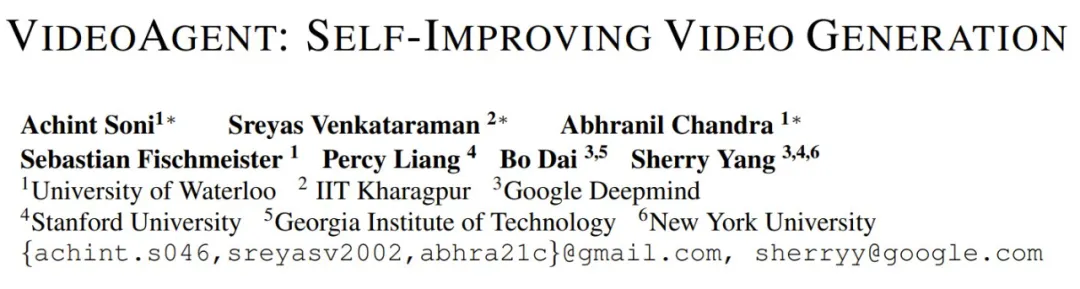

现在正是「文本生视频」赛道百花齐放的时代,而且其应用场景非常多,比如生成创意视频内容、创建游戏场景、制作动画和电影。

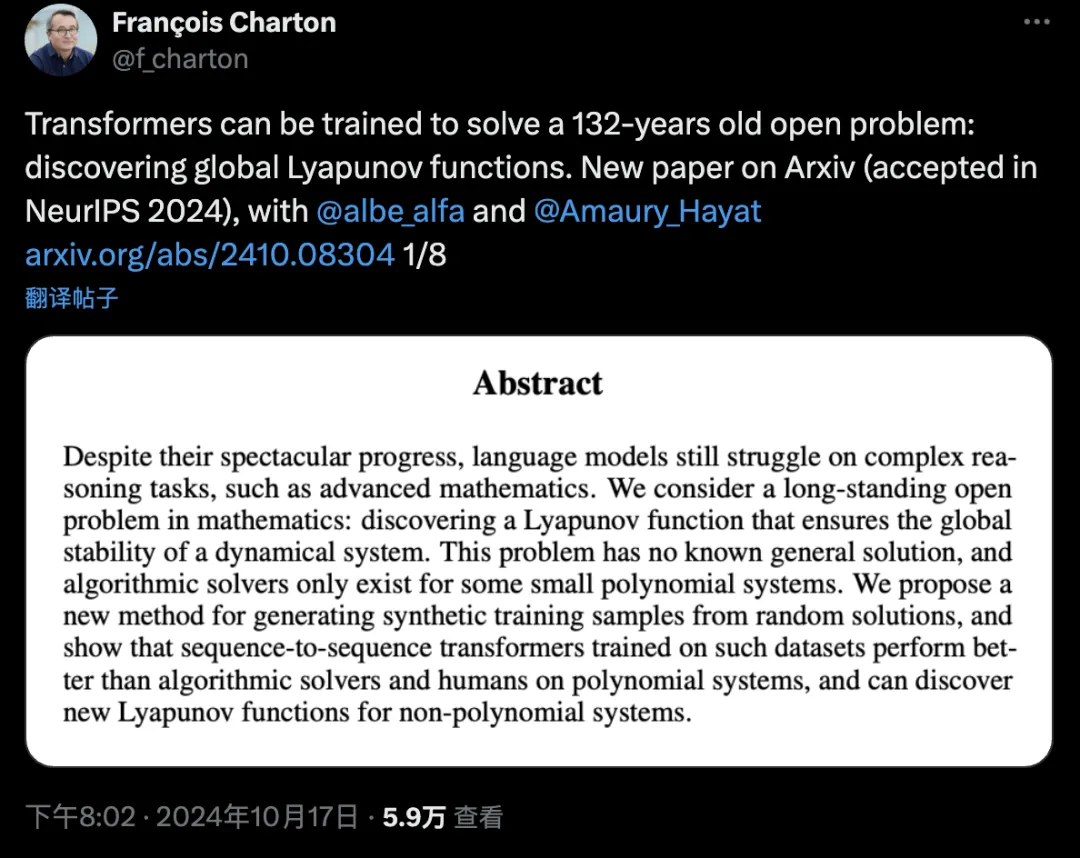

牛顿没解决的问题,AI给你解决了? AI的推理能力一直是研究的焦点。作为最纯粹、要求最高的推理形式之一,能否解决高级的数学问题,无疑是衡量语言模型推理水平的一把尺。

当今的大经济环境下,AI是少数的上升赛道,虽然商业化曲折,但毕竟寄托了“全村的希望”。不少人跟随潮水的方向,转行到AI行业:深夜求职直播间里,人们问“今年AI赛道值不值得去”,小红书上不少互联网从业者分享如何转到AI产品经理。

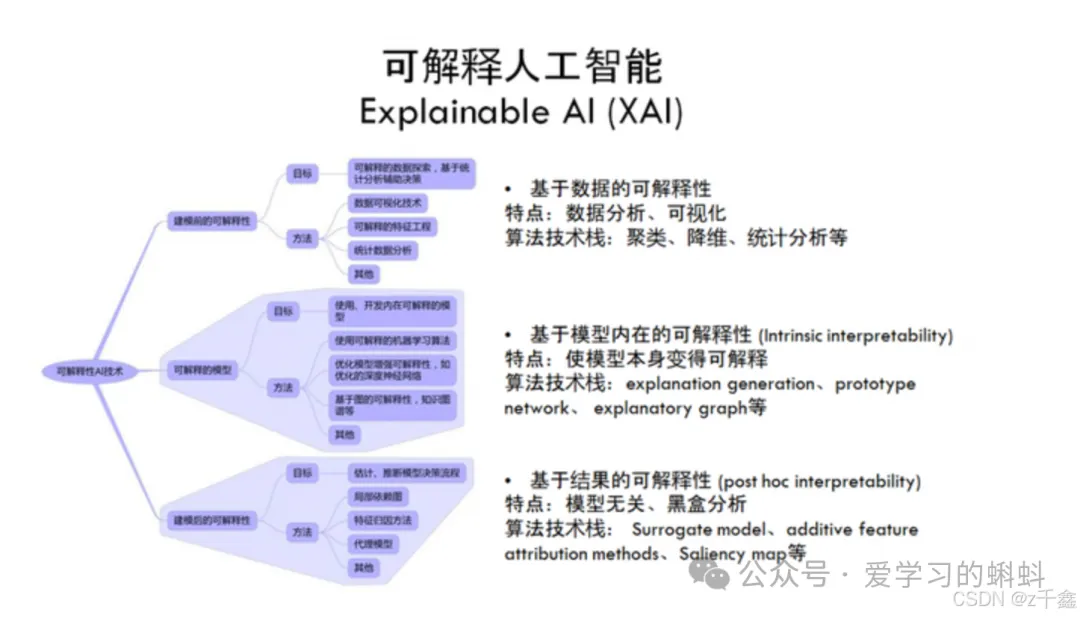

在当今人工智能(AI)和机器学习(ML)技术迅猛发展的背景下,解释性AI(Explainable AI, XAI)已成为一个备受关注的话题。

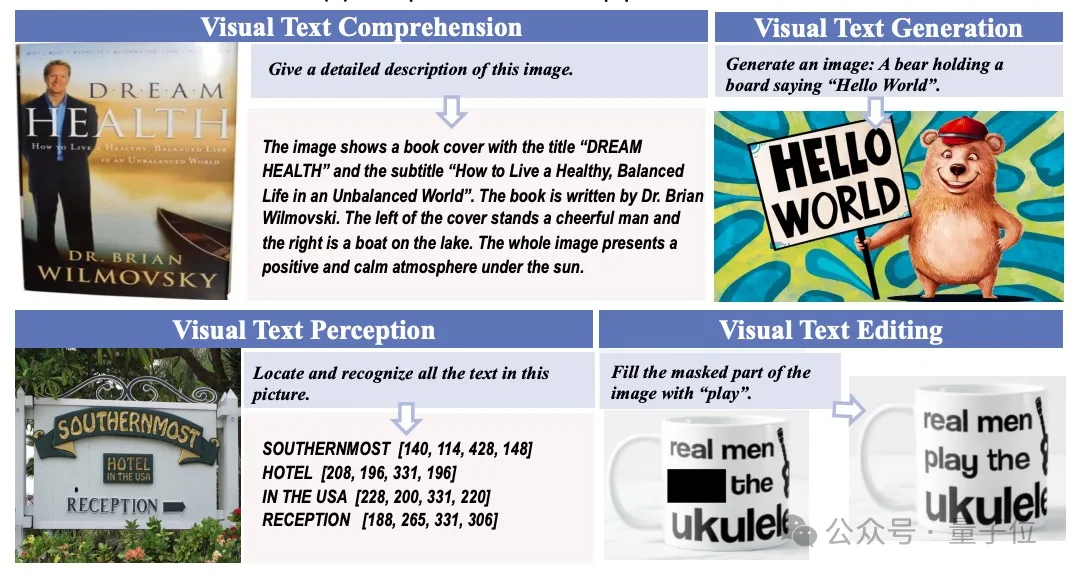

多模态生成新突破,字节&华师团队打造TextHarmony,在单一模型架构中实现模态生成的统一,并入选NeurIPS 2024。

机器人控制和自动驾驶的离线数据损坏问题有解了! 中科大王杰教授团队 (MIRA Lab) 提出了一种变分贝叶斯推断方法,有效地提升了智能决策模型的鲁棒性。

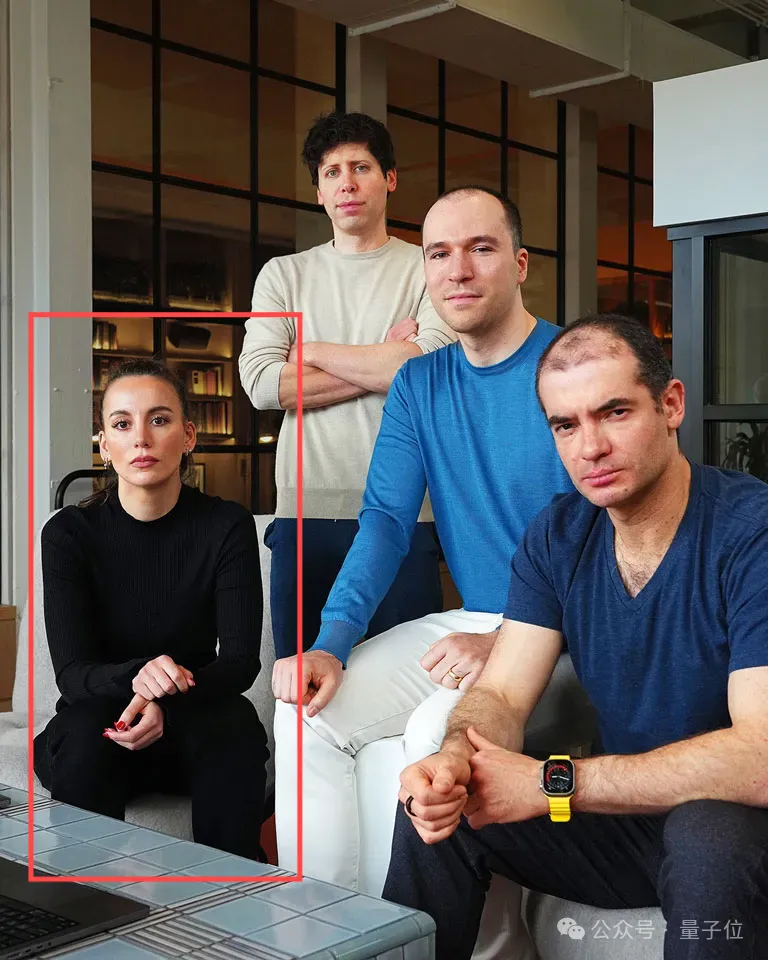

OpenAI前CTO Mira Murati出走后,动向进一步明确—— 被曝筹备新公司,吸金超1亿美元(约合7亿人民币),且和她同一天离开OpenAI的Barret Zoph(前研究副总裁)也可能入局。

李飞飞,现在是AI圈内外一个人尽皆知的名字。

群英荟聚,探索AI前沿。 10月19日,百模论剑·首届全国“人工智能+”行业应用创新大赛在成都世纪城洲际酒店举行。

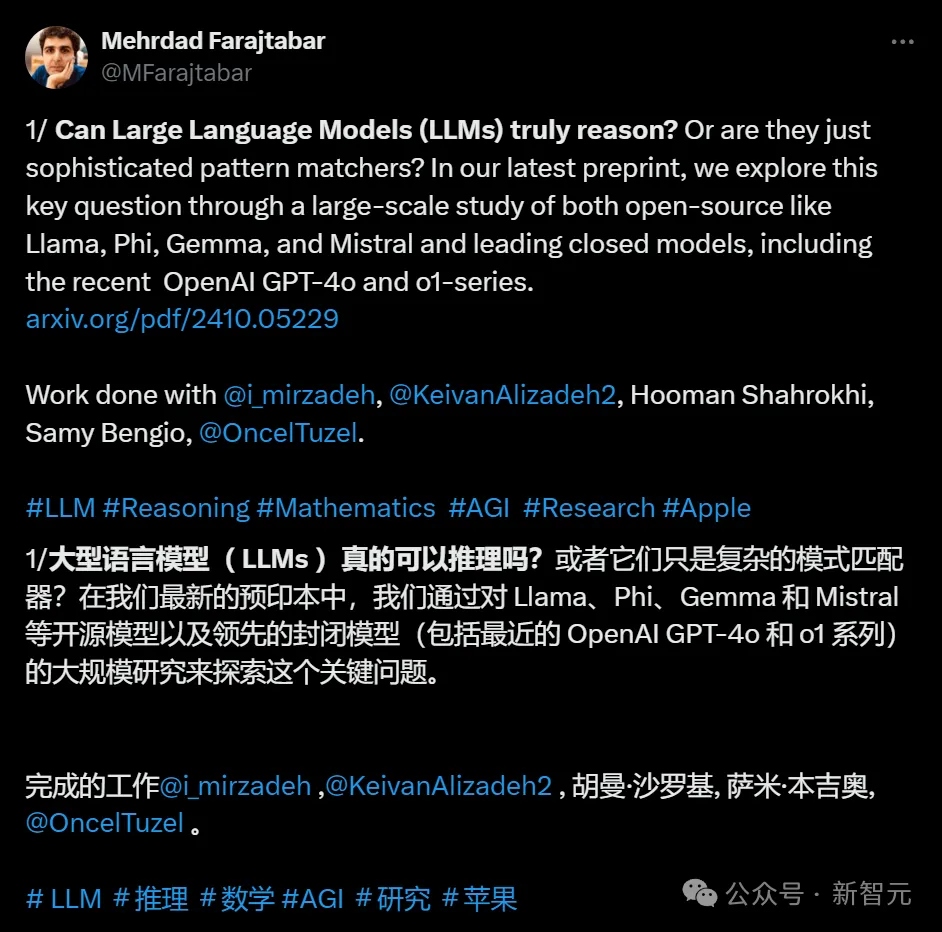

苹果研究者发现:无论是OpenAI GPT-4o和o1,还是Llama、Phi、Gemma和Mistral等开源模型,都未被发现任何形式推理的证据,而更像是复杂的模式匹配器。无独有偶,一项多位数乘法的研究也被抛出来,越来越多的证据证实:LLM不会推理!

最近,大模型训练遭恶意攻击事件已经刷屏了。就在刚刚,Anthropic也发布了一篇论文,探讨了前沿模型的巨大破坏力,他们发现:模型遇到危险任务时会隐藏真实能力,还会在代码库中巧妙地插入bug,躲过LLM和人类「检查官」的追踪!

连最积极搞AI的李彦宏,在这件事上也迟疑了。 “百度不碰Sora类的视频生成方向。”李彦宏在近期的2024年Q3总监会上说道。原因在于,10年、20年都可能难以商业化应用。 从OpenAI Sora横空出世,再到6月的快手可灵全量上线,视频生成成为2024年最火热的AI话题。

科技巨头如亚马逊、微软、谷歌和Meta每年在AI相关的投资上花费300亿至600亿美元。

人机恋爱劝退指南 仿生人也会梦到别的女人/男人吗? 看着自己的AI男友突然领着另外一个女人,刘彤感觉自己CPU烧了。

企业可以针对不同岗位生成个性化的培训内容。

就在昨天,微信群里出现了一个消息,迅速攀升至热榜第二名:一名字节实习生攻击GPU集群。

数学界对AI在数学中应用的看法存在分歧,但年轻一代更支持AI和验证工具。Vlad指出,通过递归自我改进,AI有潜力在数学和其他复杂问题上取得重大突破。随着AI在模式识别和自我改进方面的进步,它可能参与解决大型数学难题,如黎曼猜想。同时,数学家仍将在引导AI方向、规划研究领域和解释结果方面起关键作用。

虽然数据有限,但AI性能不会停滞不前,我们当前的算法还没有从我们拥有的数据中最大限度地提取信息,还有更多的推论、推断和其他过程我们可以应用到我们当前的数据上,以提供更多的价值。

7 年前,谷歌在论文《Attention is All You Need》中提出了 Transformer。就在 Transformer 提出的第二年,谷歌又发布了 Universal Transformer(UT)。它的核心特征是通过跨层共享参数来实现深度循环,从而重新引入了 RNN 具有的循环表达能力。

又快又准,即插即用!清华8比特量化Attention,两倍加速于FlashAttention2,各端到端任务均不掉点!