面壁CEO李大海:物理世界要实现AGI,一定是通过端侧智能 | 中国AIGC产业峰会

面壁CEO李大海:物理世界要实现AGI,一定是通过端侧智能 | 中国AIGC产业峰会未来物理世界要实现AGI,一定是通过端侧智能。

未来物理世界要实现AGI,一定是通过端侧智能。

自2020年开始用自研芯片取代英特尔处理器以来,苹果各大产品线都相继用上了自研芯片。

基辛格在人生最后一本书中将AI类比为新时代的“核武器”,认为其将重塑国际权力格局,加剧地缘冲突但也可转化为战略工具。他强调中美需通过对话建立AI治理机制,避免实体战争,主张以灵活外交手段实现均衡,延续其维护美国领导地位的实用主义立场。

以色列 Enigma Labs 团队今天在 X 平台宣称发布全球首款由 AI 生成的多人游戏——Multiverse(多重宇宙)。名字听起来就像漫威出品,玩法也确实够科幻。漂移、撞车,全都同步,操作互相响应,细节还能对上帧数。

4月29日,腾讯TEG进行架构调整,新成立大语言和多模态模型部,并对数据平台和机器学习平台职责进行调整。

《智能涌现》独家获悉,零一万物联合创始人、技术副总裁戴宗宏于近日离职创业。在零一万物期间,戴宗宏负责AI Infra团队,主要解决大批量并行训练时的系统瓶颈,提升训练效率,降低训练成本。

ChatGPT在深夜又更新了一波大的—— 深度研究(Deep Research)功能,现在可以直接连接到GitHub了!

软件是核心,硬件必须自主可控

家人们,本人自以为每天混在 AI 圈里,已经见过很多 AI 的“大世面”了!结果,最近又刷到了非常震惊的事情—— AI 替我花钱

OpenAI重磅推出「OpenAI for Countries」项目,作为「星际之门」计划的重要举措,旨在帮助全球各国建设AI数据中心、定制本地化ChatGPT,并推动经济增长与技术创新。奥特曼赶赴项目现场实地考察。

近日,来自SGLang、英伟达等机构的联合团队发了一篇万字技术报告:短短4个月,他们就让DeepSeek-R1在H100上的性能提升了26倍,吞吐量已非常接近DeepSeek官博数据!

AI视频的DeepSeek时刻什么时候来?没想到吧,这就来了。

Cursor,大家都知道吧。

我其实一直都很赞成AI的快速发展,很少会看到,让我眉头一皱的AI应用场景。

华为哈勃首次投资机器人公司千寻智能,5月将发新Demo。

红杉资本预计AI市场规模将远超当前约4000亿美元的云计算市场,在未来10-20年内达到难以估量的体量。初创企业需聚焦应用层,深耕垂直领域,提供端到端解决方案。AWS研究显示,全球企业正加速拥抱生成式AI,首席AI官(CAIO)职位将成为企业标配。

5 月 7 日,由 GOSIM、CSDN 和 1ms.ai 联合主办的全球开源技术盛会——GOSIM AI Paris 2025 在法国巴黎迎来了大会第二日的精彩议程。延续首日的热烈氛围,来自全球的 AI 专家、开发者和产业代表齐聚一堂,围绕 AI 技术的最新趋势与实践展开深入探讨。

央企通信巨头,牵头搞起了一个开源社区?

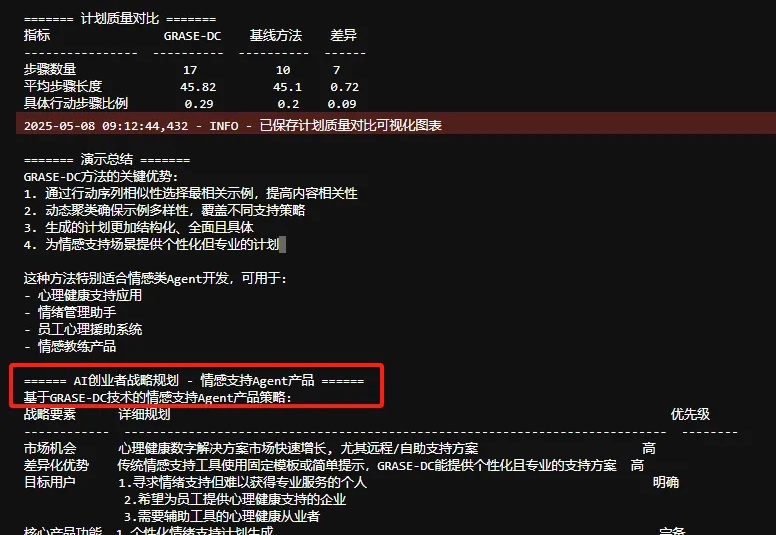

当您的Agent需要规划多步骤操作以达成目标时,比如游戏策略制定或旅行安排优化等等,传统规划方法往往需要复杂的搜索算法和多轮提示,计算成本高昂且效率不佳。来自Google DeepMind和CMU的研究者提出了一个简单却非常烧脑的问题:我们是否一直在用错误的方式选择示例来引导LLM学习规划?

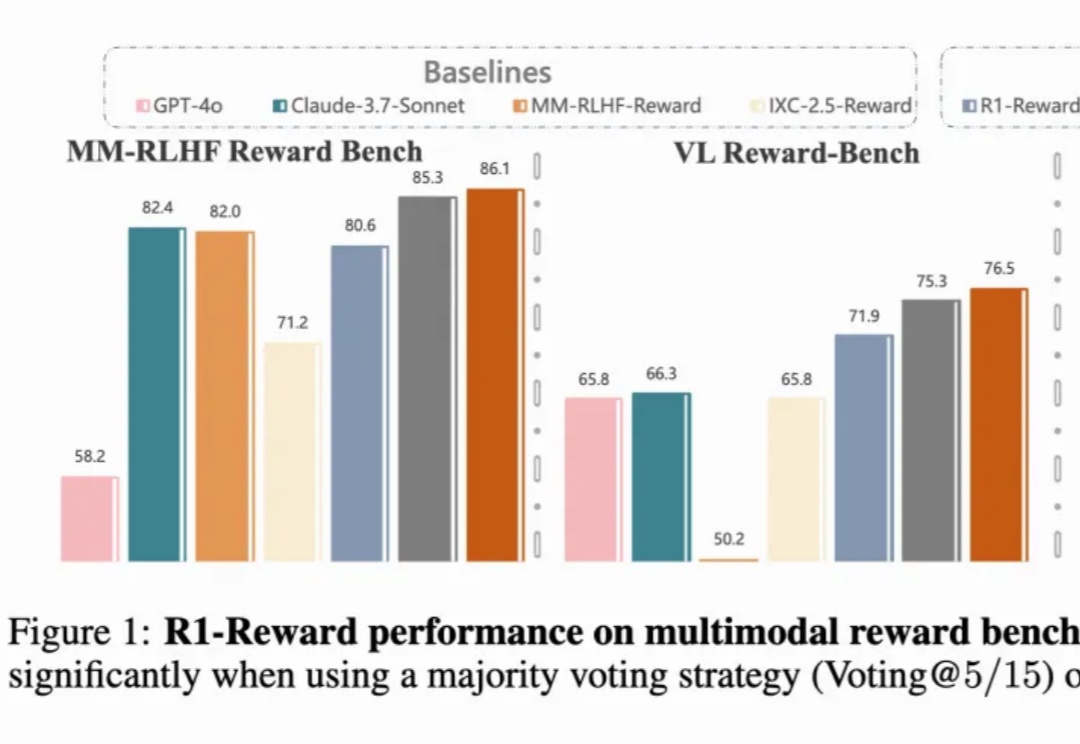

多模态奖励模型(MRMs)在提升多模态大语言模型(MLLMs)的表现中起着至关重要的作用:

在Vibe Coding的风潮下,Lightrun收入增长4.5倍。

五一假期刚过,相信不少人已经在朋友圈的「人海直播」中深刻体会到了一个真理:出门旅游,光靠一腔热情远远不够。

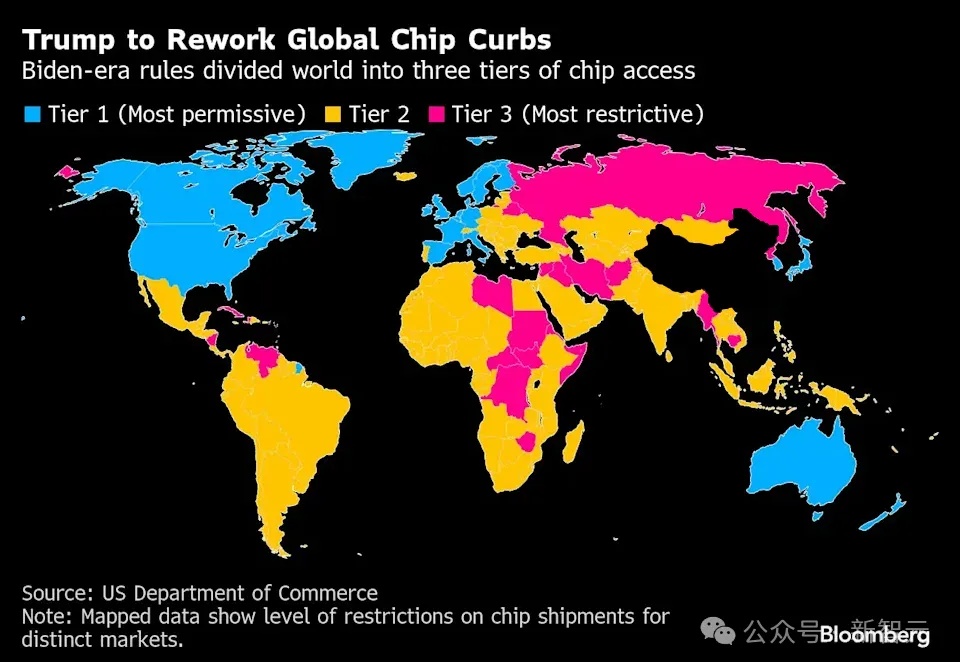

外媒称,特朗普政府将撤销拜登时代《AI扩散框架》,取消AI芯片出口「三档」限制,并将提出简版规则,巩固美国AI创新地位。

智能体趋势真的爆了。

在AI生成内容即将突破质量临界点的当下,本文警告说:技术革命从不会等待制度完善,但人类的应对智慧将决定这场生产力解放最终导向共荣还是撕裂。立法者、企业与创作者,或许可以跳出版权范畴,在更广阔的劳资关系与价值分配维度寻找答案了。

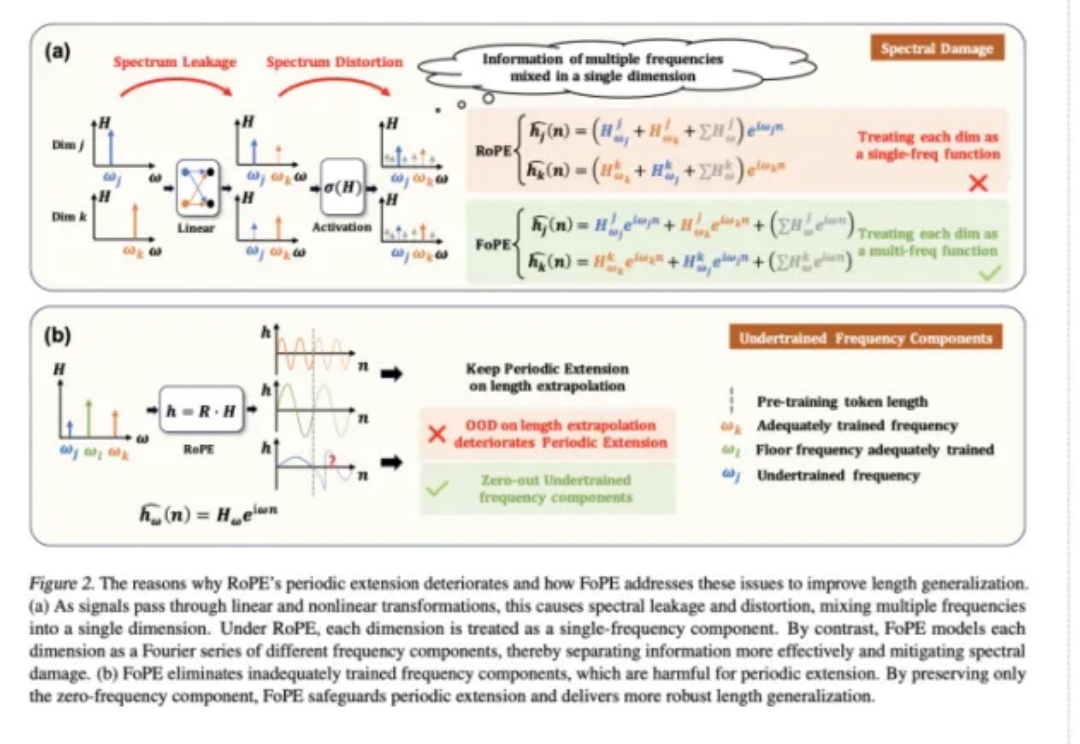

长文本能力对语言模型(LM,Language Model)尤为重要,试想,如果 LM 可以处理无限长度的输入文本,我们可以预先把所有参考资料都喂给 LM,或许 LM 在应对人类的提问时就会变得无所不能。

在百度公布这项专利前的一个月,印度普拉迪卡兰拉姆克里希纳·莫尔学院的两位学者维贾伊·苏尼尔·贾达夫和桑托什·贾格特,发表了一篇论文,内容和百度专利非常相似:“利用人工智能进行动物面部检测以理解其情绪和行为”。

内容社区能不能打破AI困境?

OpenAI重磅宣言:39岁的Fidji Simo正式出任「应用CEO」,向奥特曼直接汇报。作为Instacart掌门人,前Facebook十年高管,她以卓越领导力和产品创新闻名硅谷。未来,奥特曼本人将专注研究、算力与安全。

Anthropic 推出了一项新 API,使其 Claude AI 模型能够进行全网搜索。该公司在 5 月 7 日发布的新闻稿中表示,开发者利用此 API 可构建基于 Claude 的应用,提供最新信息。